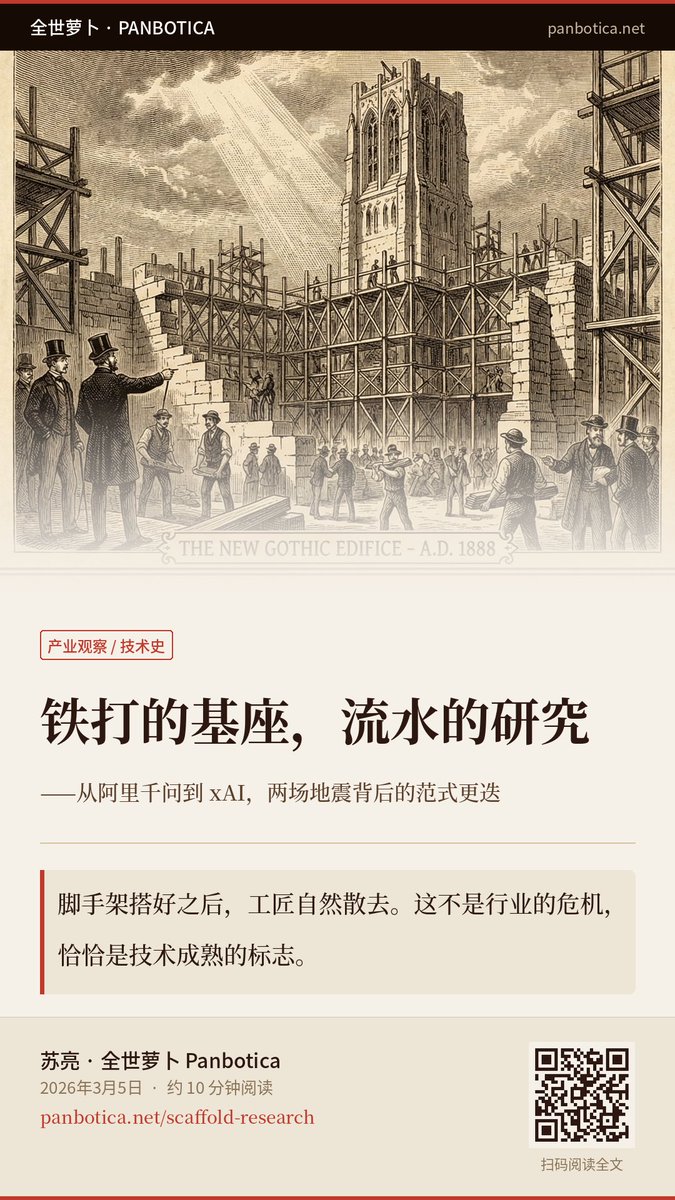

Scaling Law 的用人逻辑

这里有一个更深层的逻辑,关于 Scaling Law。

Scaling Law 告诉我们:模型性能 = f(数据量, 模型大小, 计算量)。这个公式的残酷之处在于——它是可预测的。你不需要天才的灵光一现,只需要堆资源、跑实验、调参数。

在"只争朝夕"的竞争格局下,公司的心态是:买断范式突破的地图,然后速战速决。重金挖角不是为了"留住人才",而是为了买断他们脑中那个"怎么做"的路径。一旦路径被验证、被记录、被内化为组织知识,研究员就成了"昂贵的冗余"。

这就是为什么我们看到"球星转会"模式在大模型行业反复上演:

1

高薪短约——signing bonus 惊人,但合同期有限

2

里程碑后离职——完成任务即走,双方心照不宣

3

知识内化——公司知道你不会久留,你知道自己会被替代,但框架留了下来

这不是冷酷,这是工业化的理性。

中文