ゆー(パソコンとローカルLLM)@

12.2K posts

ゆー(パソコンとローカルLLM)@

@YoutechA320U

パソコン(ローカルテキスト生成AI)の趣味アカウント

新たな「国産LLM」公開、国立情報学研究所 「gpt-oss-20b」超えの日本語性能うたう itmedia.co.jp/aiplus/article…

新たな「国産LLM」公開、国立情報学研究所 「gpt-oss-20b」超えの日本語性能うたう itmedia.co.jp/aiplus/article…

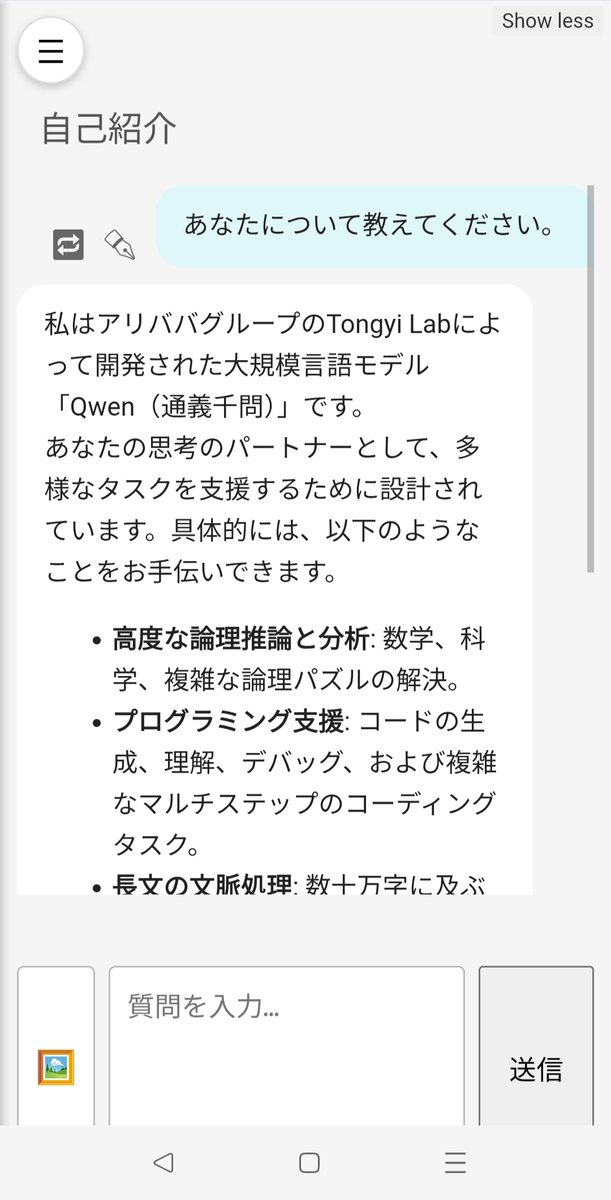

まだ作りかけなのでデザインが悪いですが、出力しながら太字になったり表になったリアルタイムにマークダウン変換されるのがなんだか好きです。 EVO-X2上のLlama.cpp(Vulkan)のgpt-oss-120b-MXFP4.ggufの出力です。x.com/YoutechA320U/s…

We're releasing our final update to Qwen3.5 GGUFs for improved performance. - Qwen3.5 GGUFs now use our new iMatrix data for better chat, coding & tool use. - New improved quant algorithm - Re-download 35B, 27B, 122B GGUFs: huggingface.co/collections/un… Guide: unsloth.ai/docs/models/qw…

お久しぶりです。 Qwen3.5が賢いはずなのに大半で(少なくともthinkタグを閉じた122BBはELYZA-tasks-100でトップ)Thinkingでの堂々巡り暴走やthinkタグを事前に閉じても勝手に再生成したりとベンチどころじゃないので、情報収集の為に動かします。

早速27bはheretic版ありますね。 場合によっては暴走耐性付いていないでしょうか…? >RP

今更このモデル試したんですが、普段から引っかかる使い方をしていないので実際のところ不明なものの、ロールプレイの口調コントロールが安定する気がします。(1枚目が元のgpt-oss-120bで2枚目がheretic) 言語の自然さより指示を優先しやすくなるってことなんでしょうか?

例えばQwen3.5-27BとQwen3.5-35B-A5BでELYZA-tasks-100の 「次に読むべきSFを10冊挙げて」 を聞くと、高確率で回答の10冊に被りが発生して直そうとしてまたループして…となり暴走します。 画像は27B-Q4_K_Mですが回答がバグっている自覚があることすらあるんですよね…。