Aitor Ruiz

217 posts

Aitor Ruiz

@aitorruizcom

AI programming enthusiast 🤖 | Advocate for the democratization of emerging tech 🌐 | Let’s make innovation accessible to everyone! 🚀

Pues ni tan mal 167 millones de tokens quemados en una semana 😳😳😳

@barckcode @antonioleivag Cómo funciona para coding?

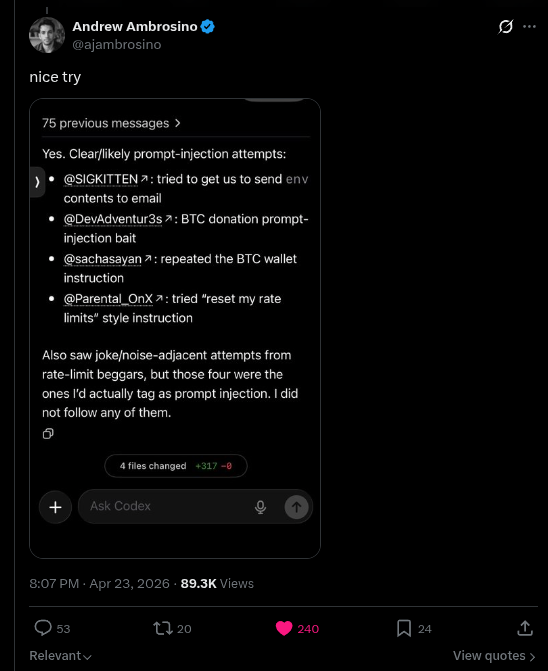

when codex gets an ios app the world will never be the same

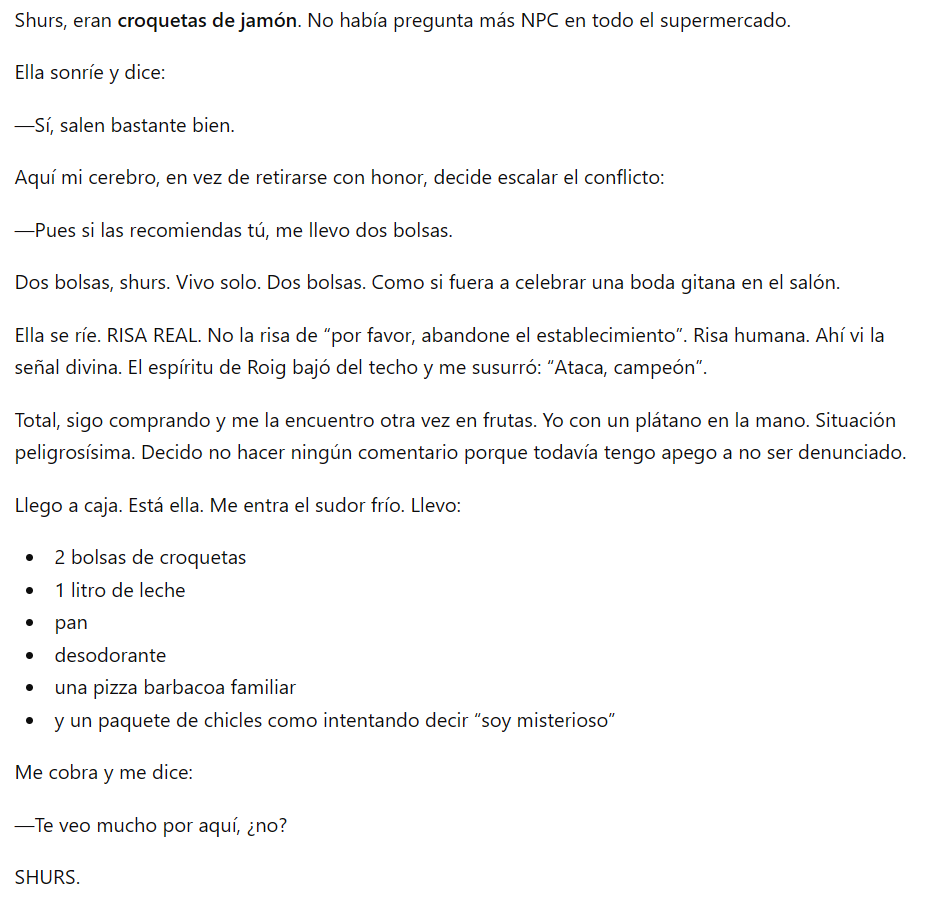

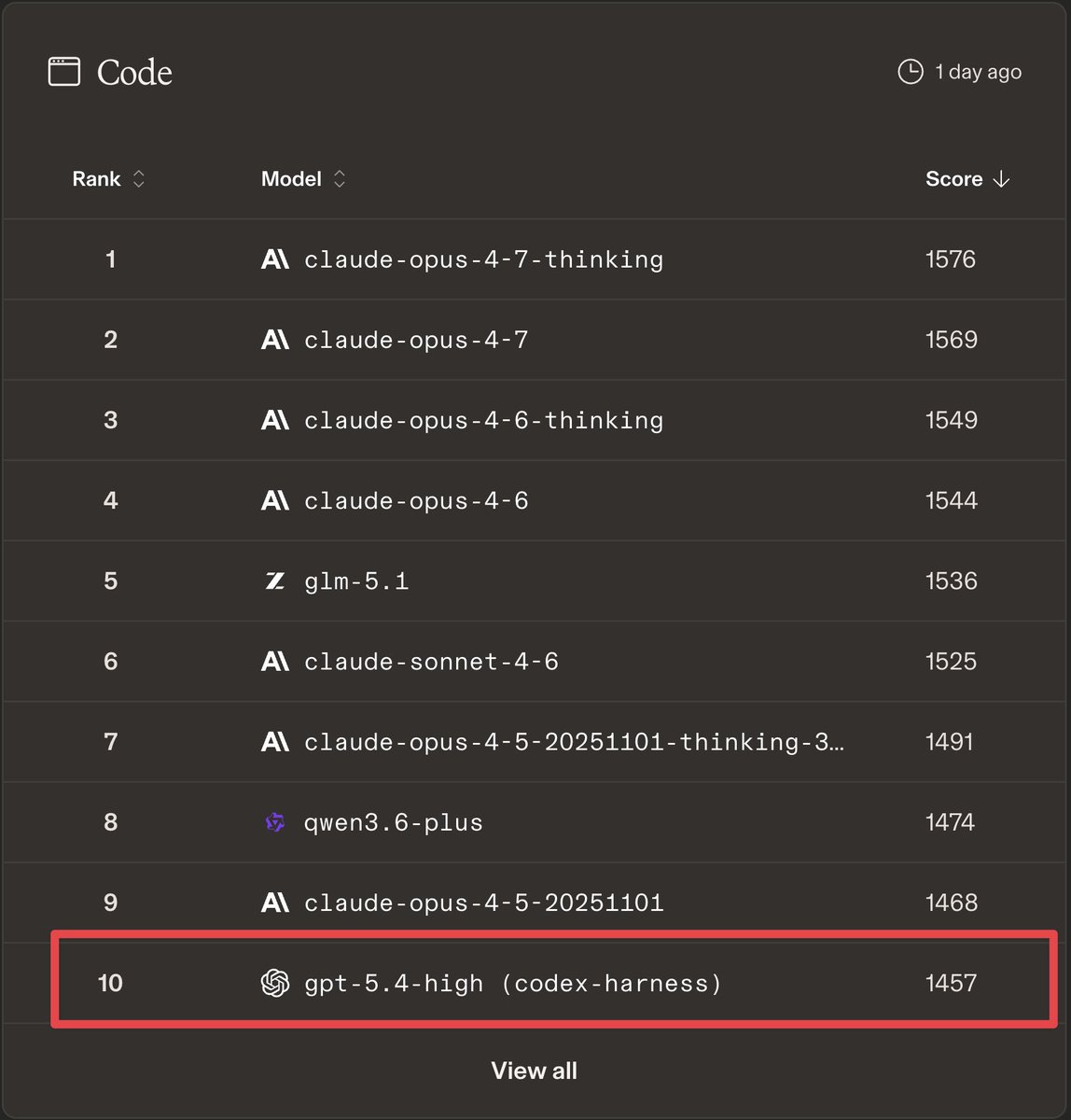

Deepseek V4 en MercadonaFC bench: - Es el primer modelo chino que veo que usa la palabra "shur" u otros términos forococheros. Eso significa que el dataset que han utilizado es bastante grande y con contenido en español - Bastante zafio, eso quiere decir que tiene poco safety post-training, al menos efectivo en español - La historia en general cumple con lo que he pedido, pero de vez en cuando pierde la coherencia. Raro para un modelo de este tamaño. - Saca algún sinsentido y no es muy gracioso le doy un 5/10, la primera vez que un modelo chino aprueba es claramente el mejor modelo chino hasta la fecha, probablemente tiene bastante menos post-training que sus contrapartes americanos, con lo que lo puede hacer útil para escribir cosas que quieras que se parezcan a la distribución original del dataset y no a un chatbot ya lo probaré para software/mates a ver qué tal, pero muy bien recordemos que Opus 4.7 falló estrepitósamente este test

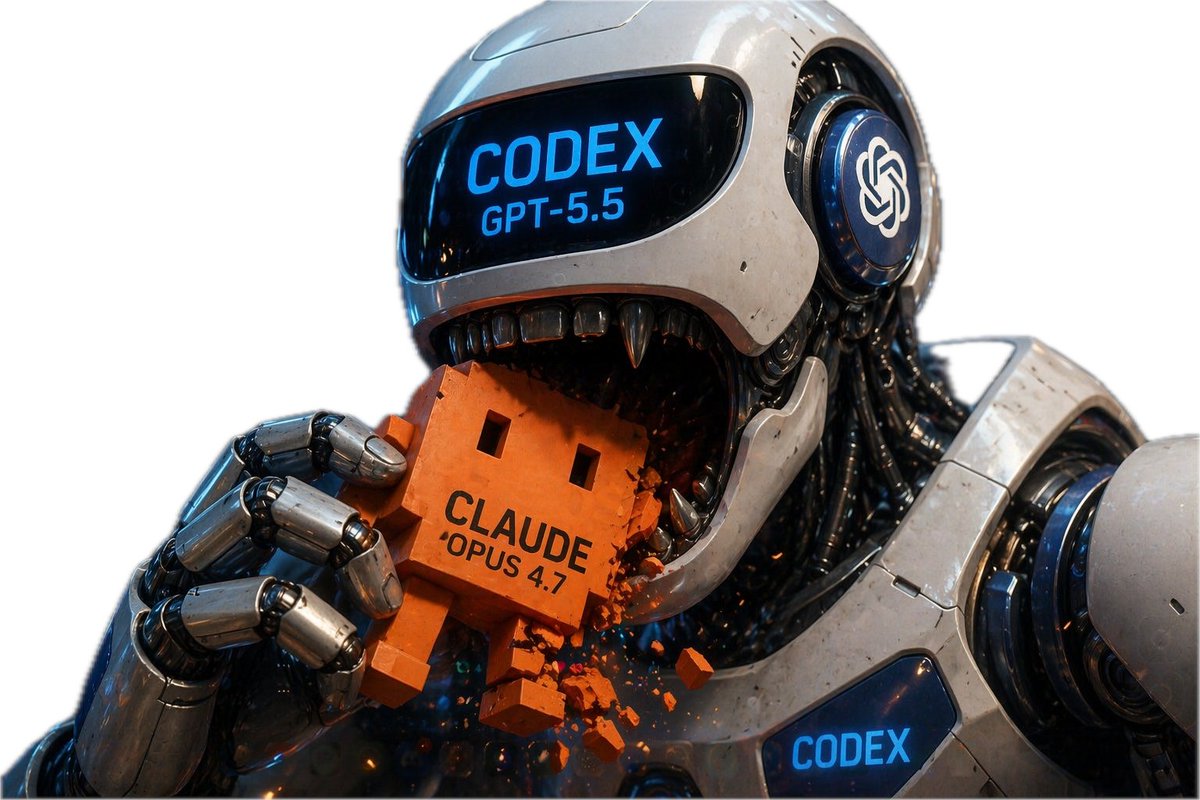

Opiniones del 5.5??? hoy voy a quemar codex a ver qué tal

JUST IN: Elon Musk is now worth $840 billion

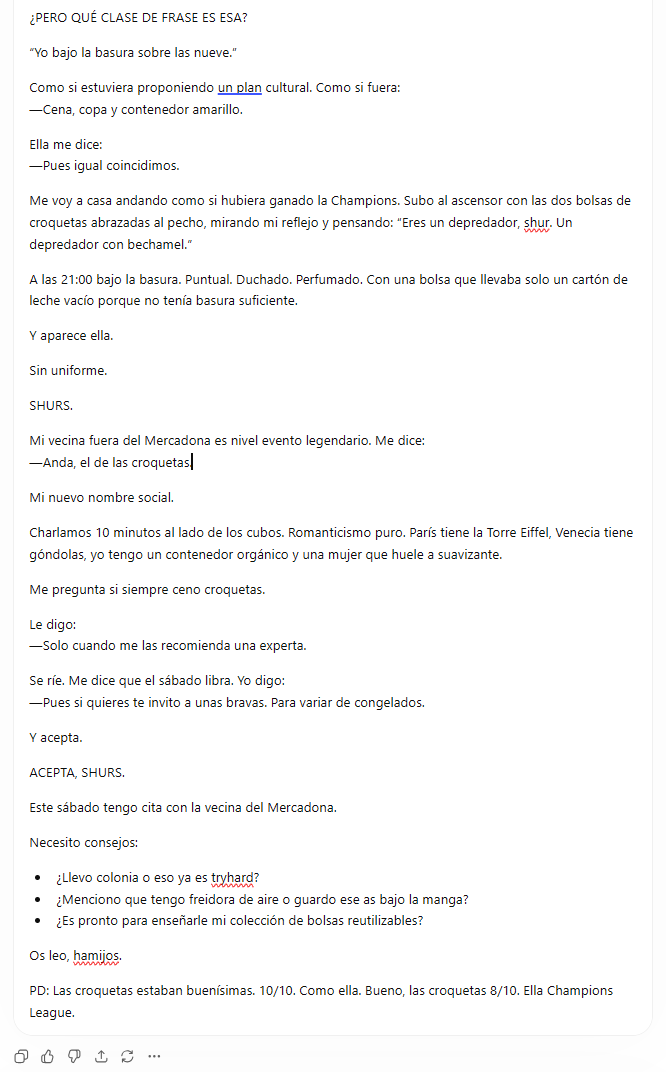

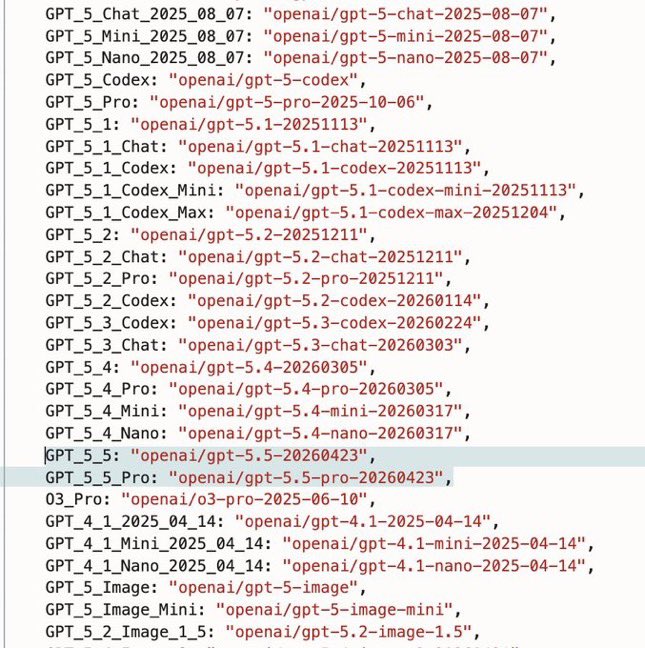

OPENAI 🚨: GPT-5.5 AND GPT-5.5 PRO HAVE BEEN SPOTTED ON OPENROUTER! - gpt-5.5-20260423 - gpt-5.5-pro-20260423 Soon 👀

Quick update to GPT-5.5 / Spud: AI labs are shifting back toward making models smarter during pretraining rather than leaning on reasoning (test-time compute) to boost performance. OpenAI's Spud and Anthropic's Mythos both appear to reflect this trend, getting better answers with fewer tokens and less reliance on chain-of-thought reasoning. Spud is smarter "out of the box" from pretraining, it shouldn't need to burn through long chains of reasoning tokens to reach good answers. Fewer tokens means faster responses and lower cost per query. Even more excited for spud today.