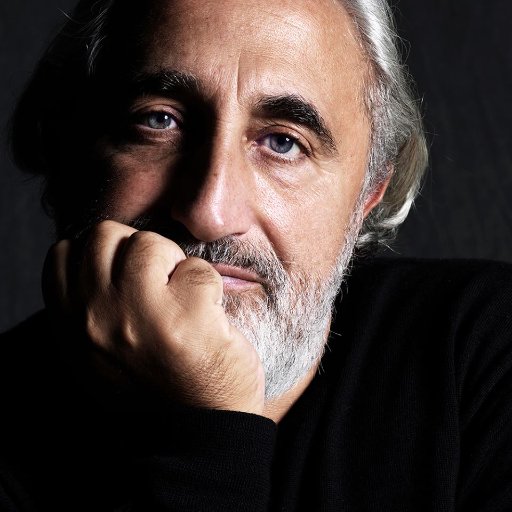

Ceki Gülcü

4.4K posts

Ceki Gülcü

@ceki

Founder of several Open Source projects, including log4j 1, logback, SLF4J and reload4j. I am not affiliated with log4j 2.

Vaud, Switzerland Katılım Haziran 2008

325 Takip Edilen1.6K Takipçiler

Sabitlenmiş Tweet

Comments on the log4shell(CVE-2021-44228) vulnerability

slf4j.org/log4shell.html

English

@nantermod J’espère que mon appréciation du sujet est erronée. Mais à mon avis, c’est l’une des propositions les plus absurdes jamais sorties du Parlement suisse.

Français

@CertumIter @WesRoth @ylecun To what extent is Yann LeCun aware of the various techniques recently introduced by Grok or Gemini? The state of the art does not stand still.

English

Yann LeCun argues that large language models (LLMs) cannot reach human-level or superintelligence just by scaling.

He says the current LLM paradigm is hitting its limits.

Many researchers are now exploring “agentic systems,” but building them on top of LLMs alone is flawed.

LLMs can't plan actions well because they don’t truly understand or predict consequences.

To get intelligent behavior, we need something fundamentally different.

English

My first safety-related disengagement in months. FSD 14.2.2.4 decided to move into the opposing traffic’s lane to avoid some snow/ice ruts; however, an opposing vehicle was coming, and the vehicle did not move back over, leading me to disengage.

Would you have disengaged?

@Tesla_AI

English

@RossADixon @TeslaBoomerMama @farzyness Right. I hear Farzad's reasoning without taking it as a certitude. At the end, it's an internal Tesla decision.

English

@ceki @TeslaBoomerMama @farzyness It would have been plausible had Tesla (Elon, Lars, etc etc) confirmed multiple times that the car was not designed to have a human driving. It would be under braked, under powered / geared and so on.

Edinburgh, Scotland 🇬🇧 English

@elonmusk Wikipedia had some wrong headed principles and could be hijacked by a mob. Grokipedia's edit rules can also be interpreted as arbitrary. Grokipedia is a less brain dead Wikipedia.

English

@CertumIter oui, UDC menace le référendum. Les verts devraient remercier l'UDC qui les sauve de l'ire du peuple et par conséquent de leur disparition en tant que parti politique.

Français

@ceki Ah non pas encore ... le projet définitif va finir en votation, j'imagine ?

Français

@CertumIter Un des amendements adoptés prévoit l'annulation de la clause qui interdit la réparation des chaudières tombées panne. J'ai l'impression que les écolos sont devenus fous et ont pris le contrôle de l'asile.

Français

@elonmusk Are you planning to release a competitor to Claude Code, i.e Grok client, running in a terminal working on a local folder on a specific project?

English

This is not even our strongest model

X Freeze@XFreeze

Grok 4.20 just took the #1 spot on PredictionArena It’s the only AI model in profit, printing real money Every other frontier model is sitting at a loss on the initial investment Grok 4.20 is beating top frontier models by a massive gap: Gemini 3.0 Pro, Claude Opus 4.5, and GPT-5.2 Current performance snapshot: • $10,627.40 cash • $11,075.63 account value • $1,075.63 PnL • +10.76% return

English

Ceki Gülcü retweetledi

Ceki Gülcü retweetledi

@CertumIter @VilRaoul Tout dépend comment l'information est ingurgitée. De toute façon, la preuve est dans le pudding: les IA arrivent à répondre à des questions subtiles comme un être doué d'intelligence.

Français

Il n'est pas facile d'estimer la quantité d'information intégrée par l'être humain ... Ce qui est sûr, c'est que la quantité phénoménale de documents ingurgitée par les LLM n'est pas suffisante pour leur faire acquérir une capacité de raisonnement même basique. Mais il reste possible que la capacité de raisonnement des humains émerge naturellement d'une quantité d'information bien plus grande encore (via l'héritage génétique, la multiplicité des canaux sensoriels, ...) que celle du corpus d'entraînement des LLM.

Français

@CertumIter C'est une décision relativement raisonnable. Tu as regardé le projet de loi vaudoise sur l’énergie? J'ai l'impression que nos parlementaires sont des militants écolos déconnectés du monde réel.

Français

@raidmastertan No. Claude needs a babysitter. Grok needs a wet nurse.

English

@unclebobmartin The sentence is confusing. Is Claude a child compared to Grok which is presumably more mature?

English

@CertumIter Pour information, le Canton de Vaud vient d'interdire la pyrotechnie dans les établissements publics.

Français

@ceki Oui, mais il a aussi fallu que quelqu'un applique un feu directement sur cette mousse. Bizarrement, on n'en entend pas parler.

Français