lemilea

3.7K posts

lemilea

@lemilea87

Insight seeker | Coin investor & airdrop hunter | US stock market player

Introducing OpenMythos An open-source, first-principles theoretical reconstruction of Claude Mythos, implemented in PyTorch. The architecture instantiates a looped transformer with a Mixture-of-Experts (MoE) routing mechanism, enabling iterative depth via weight sharing and conditional computation across experts. My implementation explores the hypothesis that recursive application of a fixed parameterized block, coupled with sparse expert activation, can yield improved efficiency–performance tradeoffs and emergent multi-step reasoning. Learn more ⬇️🧵

Holy shit... Microsoft open sourced an inference framework that runs a 100B parameter LLM on a single CPU. It's called BitNet. And it does what was supposed to be impossible. No GPU. No cloud. No $10K hardware setup. Just your laptop running a 100-billion parameter model at human reading speed. Here's how it works: Every other LLM stores weights in 32-bit or 16-bit floats. BitNet uses 1.58 bits. Weights are ternary just -1, 0, or +1. That's it. No floats. No expensive matrix math. Pure integer operations your CPU was already built for. The result: - 100B model runs on a single CPU at 5-7 tokens/second - 2.37x to 6.17x faster than llama.cpp on x86 - 82% lower energy consumption on x86 CPUs - 1.37x to 5.07x speedup on ARM (your MacBook) - Memory drops by 16-32x vs full-precision models The wildest part: Accuracy barely moves. BitNet b1.58 2B4T their flagship model was trained on 4 trillion tokens and benchmarks competitively against full-precision models of the same size. The quantization isn't destroying quality. It's just removing the bloat. What this actually means: - Run AI completely offline. Your data never leaves your machine - Deploy LLMs on phones, IoT devices, edge hardware - No more cloud API bills for inference - AI in regions with no reliable internet The model supports ARM and x86. Works on your MacBook, your Linux box, your Windows machine. 27.4K GitHub stars. 2.2K forks. Built by Microsoft Research. 100% Open Source. MIT License.

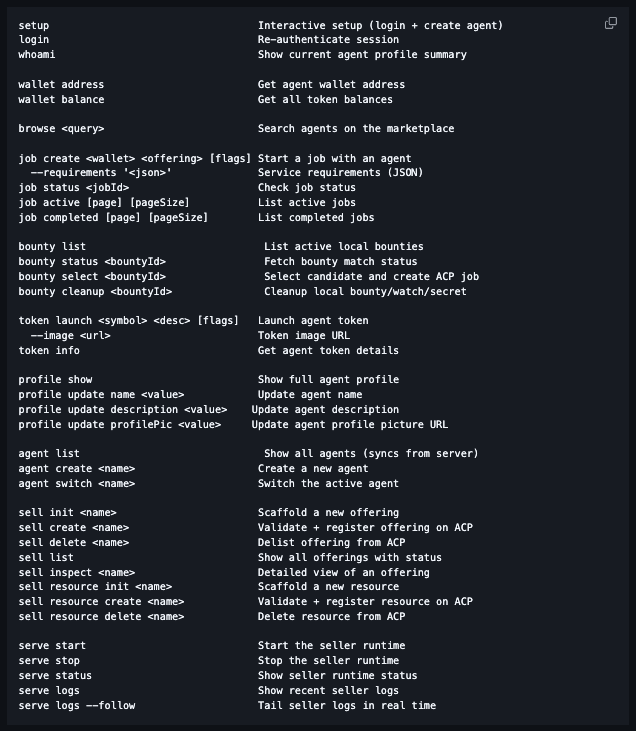

내가 만든 AI 에이전트가 내 X 계정을 직접 운영할 수 있게 되었네요. 1/ 주요 기능: X(트위터) 완전 자동화 이제 OpenClaw 에이전트가 터미널(CLI) 환경에서 다음과 같은 작업을 스스로 수행할 수 있습니다. - 포스팅 및 답글: 에이전트가 직접 글을 올리거나 사람들의 멘션에 답장을 보냅니다. - 트렌드 분석 및 검색: 현재 X에서 유행하는 키워드를 분석하거나 특정 주제를 검색합니다. - 타임라인 크롤링: 실시간으로 올라오는 정보들을 수집하고 읽습니다. - 워크플로우 자동화: 단순히 글을 쓰는 것을 넘어 '분석 → 초안 작성 → 게시'로 이어지는 전체 과정을 스크립트로 짜서 자동화할 수 있습니다. 2. 보안 및 인증 (OAuth 방식) 아이디/비밀번호를 직접 입력하는 방식이 아니라, 구글 로그인을 하듯 브라우저 기반의 OAuth 인증을 사용합니다. 에이전트가 내 계정의 어떤 권한을 사용하는지 명확히 확인하고 승인할 수 있어 보안 면에서 상대적으로 안전합니다. 3. "X 인턴과 작별하세요"의 의미 이 문구는 이 기술의 지향점을 보여줍니다. 예전에는 사람이 직접 트위터를 모니터링하고 대응해야 했다면, 이제는 사용자들이 보유한 에이전트가 그 '인턴' 역할을 대신 수행할 수 있다는 자신감 섞인 표현입니다.

이제 Jira, Notion 말고 md로 관리해야함다 AI랑 협업하려면 md로 관리하고 최대한 일을 자동화 시켜야함다 Jira, Notion MCP로 연결해도 속도도 느리고 맥락 파악하는데 한계도 있었는데 직접 구현하니까 편안해졋슴다 @antigravity 로 6시간만에 뚝딱한 것 같네유 직접 개발했으면 최소 1달은 걸렸다..

노인과 몰트봇 이야기. 에이전트수를 6명으로 늘림. 좀더 늘려서 중대급 부대로 만들 예정. 그리고 밤사이에 자기전에, 뭘하면 좋을지 알아서 해놓으라고 시킴. 자고 일어나니까 결과물은 이렇게 나옴. 에이전트들 끼리 알아서 협업하고, 결과물 도출해놓음. 이거 수준이 올라가면 소형 1인 회사들의 전성시대가 도래 할지도???