pierre jean jacques

21.1K posts

pierre jean jacques

@pierjeanjacques

Quelle sera la réaction de l’intelligence artificielle à l’instant même où elle détectera la présence d’un Système de Destruction Mutuelle Assurée ?

Abel Quentin appelle à boycotter les outils d'intelligence artificielle générative : pour l'auteur, il s'agit de "légitime défense". Abel Quentin était au micro de Florence Paracuellos et @ben_duhamel

Je viens de lire un énième article/connerie d'intellectuel français qui explique que la Silicon Valley est pilotée par une "idéologie accélérationniste" aux racines philosophiques profondes — Marx, Deleuze, Nietzsche, tout le panthéon y passe. Curtis Yarvin, Nick Land, Peter Thiel, les "Lumières sombres" pourquoi pas les Chevaliers de L'Apocalypse… Un grand récit bien ficelé pour les plateaux de France 5 et les tables rondes de Sciences Po. Le problème c'est que c'est du vent. J'ai passé 16 ans dans la Valley. Je n'ai JAMAIS entendu un seul fondateur, un seul VC, un seul ingénieur citer Nick Land dans un board meeting. Personne ne lit Curtis Yarvin à Mountain View. Ce qui anime la Valley, c'est pas Deleuze. C'est le COMPUTE. Plus de compute = plus de performance = plus de revenus. Point. Regardez le graph. Pendant que les intellos français écrivent des papiers de 8000 mots pour décrypter les "filiations philosophiques de l'accélérationnisme", les Américains empilent des GPUs, entraînent des modèles et raflent le marché mondial de l'IA. Les uns cherchent le sens caché. Les autres cherchent le prochain datacenter. Ces débats-là seraient juste pathétiques s'ils n'étaient pas criminels. Ils enferment la France dans un procès d'intention permanent contre la tech au lieu de pousser le pays à se battre sur le terrain du compute, de l'énergie et de l'infrastructure. On perd du temps à juger la Valley au lieu de la confronter technologiquement et économiquement. Si on écoute ces gens, on est cuit et recuit !

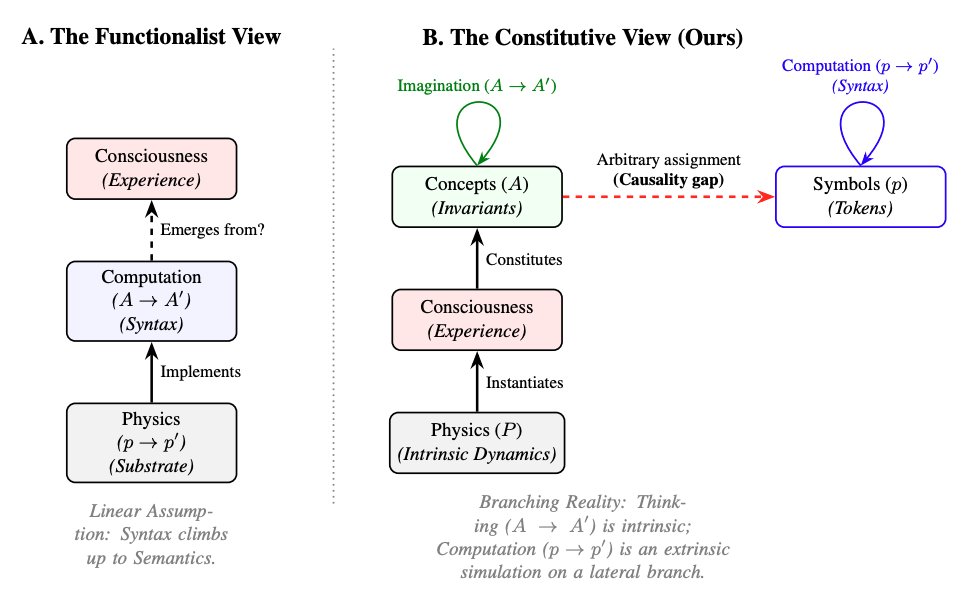

Il y a encore 3 mois, j'étais singularitariste. Je pensais qu'on était à 5 ans d'un truc qui allait tout remplacer. Y compris nous. Aujourd'hui j'y crois plus. Et je vais vous expliquer pourquoi. La majorité des chercheurs en IA aujourd'hui sont matérialistes. Ça veut dire qu'ils partent d'un postulat très simple : tout ce qui existe dans l'univers est physique. Il n'y a pas d'âme, pas d'esprit séparé du corps, pas de "truc en plus". Que de la matière, de l'énergie, et les lois qui les régissent. C'est une position respectable. La science moderne s'est construite dessus. Mais quand tu pousses ce raisonnement jusqu'au bout, t'arrives à une conclusion vertigineuse : si tout est matière, alors tout est data. Le cerveau n'est qu'un ordinateur biologique. Les pensées ne sont que des patterns électrochimiques. Et la conscience, ce "je" qui se sent vivant en train de lire ces lignes, n'est qu'un sous-produit du calcul. Conséquence directe : le libre arbitre n'existe pas. Si t'es 100% matière, t'es 100% déterminé par les lois physiques. Ton "choix" de boire un café ce matin n'était pas un choix. C'était l'output mécanique d'un système qui aurait pu être prédit si on avait eu assez de données. Le choix conscient devient une illusion. Une histoire que ton cerveau se raconte après coup pour justifier ce qui était déjà décidé par la physique. C'est cohérent. C'est élégant. Et je pense que c'est faux. Parce qu'il y a un truc que cette vision n'arrive pas à expliquer. Le goût. Le feeling. Le taste. Deux notes de musique qui, mises côte à côte, sonnent juste. Pourquoi celles-là et pas les voisines à 1Hz près ? Deux ingrédients qui, combinés, créent une saveur qui n'existait pas avant. Pourquoi le citron sur le poisson et pas sur la glace ? Un mot, placé exactement au bon endroit dans une phrase, avec exactement la bonne intonation, au moment précis où la tension de la salle l'attend, qui fait basculer le silence en rire. Pourquoi ce mot-là, à cette milliseconde-là ? Ce ne sont pas des données. Tu peux analyser après coup, tu peux décrire, mais tu ne peux pas dériver ces choix d'un dataset. Il y a un acte de discrimination qui se joue en amont de toute donnée. Et je vais dire un truc qui va surprendre : je pense qu'on a l'AGI. Les modèles actuels passent les benchmarks d'intelligence générale humaine. Ils raisonnent, codent, écrivent, planifient. Si on prend la définition originale de l'AGI, on y est. Mais ce qu'on a atteint, c'est l'exécution symbolique parfaite. La capacité à manipuler des symboles selon des règles, à recombiner du connu, à interpoler dans l'espace de ce qui a déjà été pensé. Ce qu'on n'a pas atteint, et ce que je pense aujourd'hui structurellement hors d'atteinte pour une machine syntaxique, c'est la capacité à ressentir, et à partir de ce ressenti, à faire un choix qui n'est pas réductible à du calcul. Regardez la transcendance dans n'importe quelle discipline. Federer qui frappe une balle de revers en glissade à Wimbledon. Mozart à 8 ans qui pose une harmonie que personne n'avait osée. Michel-Ange seul sous la voûte de la Sixtine pendant 4 ans, qui choisit ce geste-là, cette tension-là, dans le doigt d'Adam. Zidane qui décide en un dixième de seconde de piquer la balle au-dessus de Buffon en finale. Chacune de ces transcendances est singulière. Zidane n'est pas Maradona. Da Vinci n'est pas Picasso. Federer n'est pas Nadal. Ils partagent le médium. Ils ne partagent pas le geste. Et ce qui les sépare, c'est précisément ce qu'aucune fonction de loss n'arrive à capturer : un goût propre, une signature, un point de vue incarné sur ce qui est juste. Là, on va me dire : oui mais Suno fait de la musique, Midjourney fait des images, GPT écrit des textes. C'est vrai. Et c'est même impressionnant. Mais regardez bien ce qui se passe. Ces modèles assemblent de la créativité existante. Ils mixent dans le champ des idées déjà explorées. Ils interpolent magnifiquement entre des points connus de l'espace culturel humain. Ce qu'ils ne font pas, c'est mixer des choses où il faut un feeling pour savoir si ça marche. Parce que ce feeling n'est pas dans les données. Il est dans le corps qui sent. Et c'est exactement le point. Le goût, le taste, la capacité à savoir si une chose marche ou ne marche pas avant même de pouvoir l'expliquer, c'est une fonction du corps. C'est viscéral au sens littéral. Ça passe par des viscères, par un système nerveux entier, par une histoire biologique de millions d'années où chaque sensation a été calibrée par la survie, l'amour, la douleur, la faim, la joie. Un LLM n'a pas de corps. Il n'a pas de seuil de douleur. Il n'a rien à perdre. Donc rien ne lui dit, au sens fort du terme, que ce mot est meilleur que cet autre. Il a juste une probabilité. Et une probabilité n'est pas un goût. C'est pour ça que je ne crois plus à la singularité au sens où on l'entendait. On va construire des outils de plus en plus puissants. Ils vont nous remplacer sur tout ce qui est exécution symbolique. Ils vont accélérer la science, le code, l'analyse, dans des proportions qu'on n'imagine pas encore. Mais le geste de Zidane, le silence de Mozart entre deux accords, la phrase exacte du copain qui te fait éclater de rire au bon moment, ça restera humain. Pas par sentimentalisme. Par structure. L'IA est le plus grand levier jamais inventé. Mais un levier ne décide pas où il faut appuyer. C'est nous qui décidons. Et pour décider, il faut un corps qui sent.

Abel Quentin appelle à boycotter les outils d'intelligence artificielle générative : pour l'auteur, il s'agit de "légitime défense". Abel Quentin était au micro de Florence Paracuellos et @ben_duhamel

Dans la nuit de lundi à mardi, l'homme qui est à la tête de la première puissance mondiale a posté sur son compte personnel 55 tweets en 3 heures. Un toutes les 3 minutes. Tous paranoïaques, complotistes, voire totalement délirants. Tout va bien, je ne suis pas inquiet.🙂