Wousp

1K posts

Wousp

@qi9098

记录 AI 时代普通人能用上的工具、价格和access route Codex / Claude Code / DeepSeek / 闲鱼暗号

多伦多大学硕士留学两年总开销约55万人民币,你们觉得值嘛? 学费:35000-48000加元/年,折合人民币约18.6-25.4万/年。如果是商科或金融类,费用会更高。 住宿:校外单间月租1200-1800加元,一年约1.5万加元,折合人民币8万。校内宿舍更贵,一年约1.8万加元。 生活费:吃饭、交通、保险等日常开销,月均约800加元,一年约1万加元,折合人民币5.3万。 其他费用:往返机票、签证、教材等,预留约1.7万人民币。

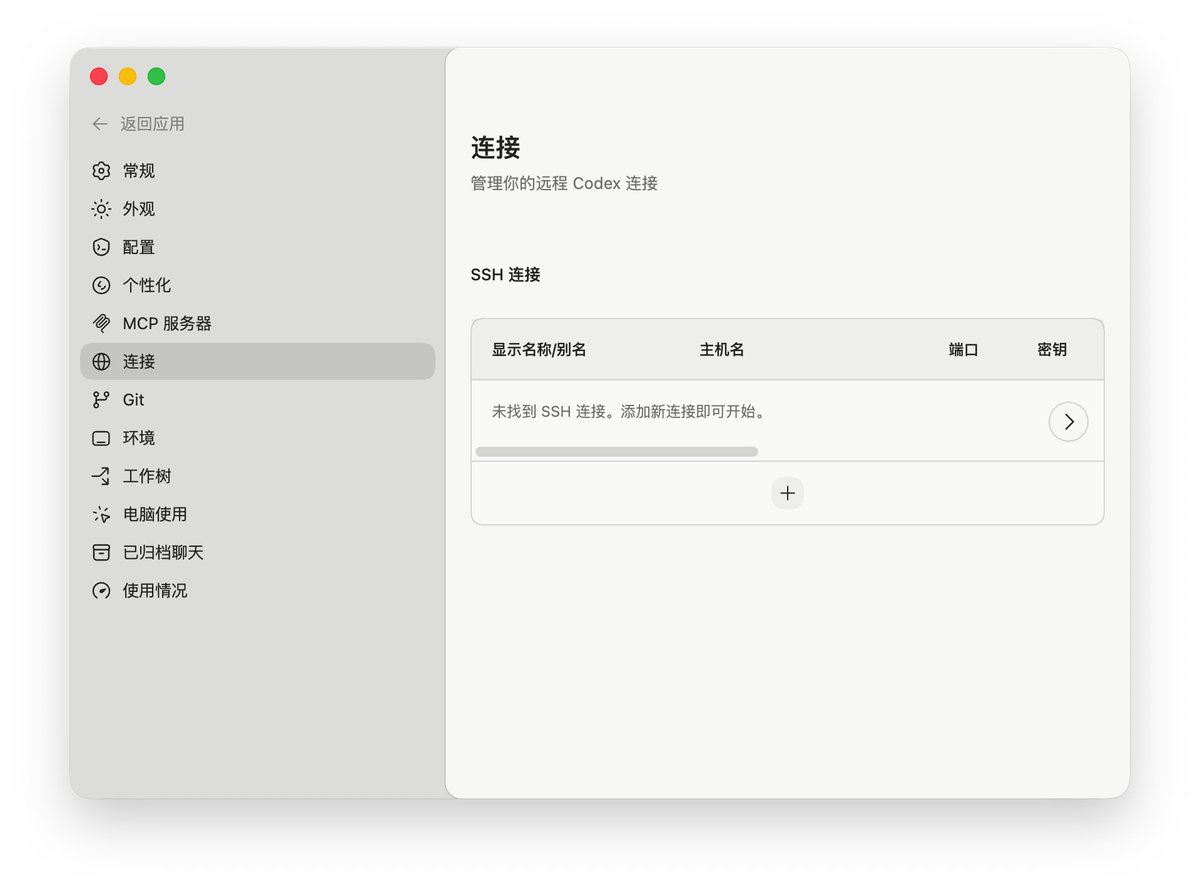

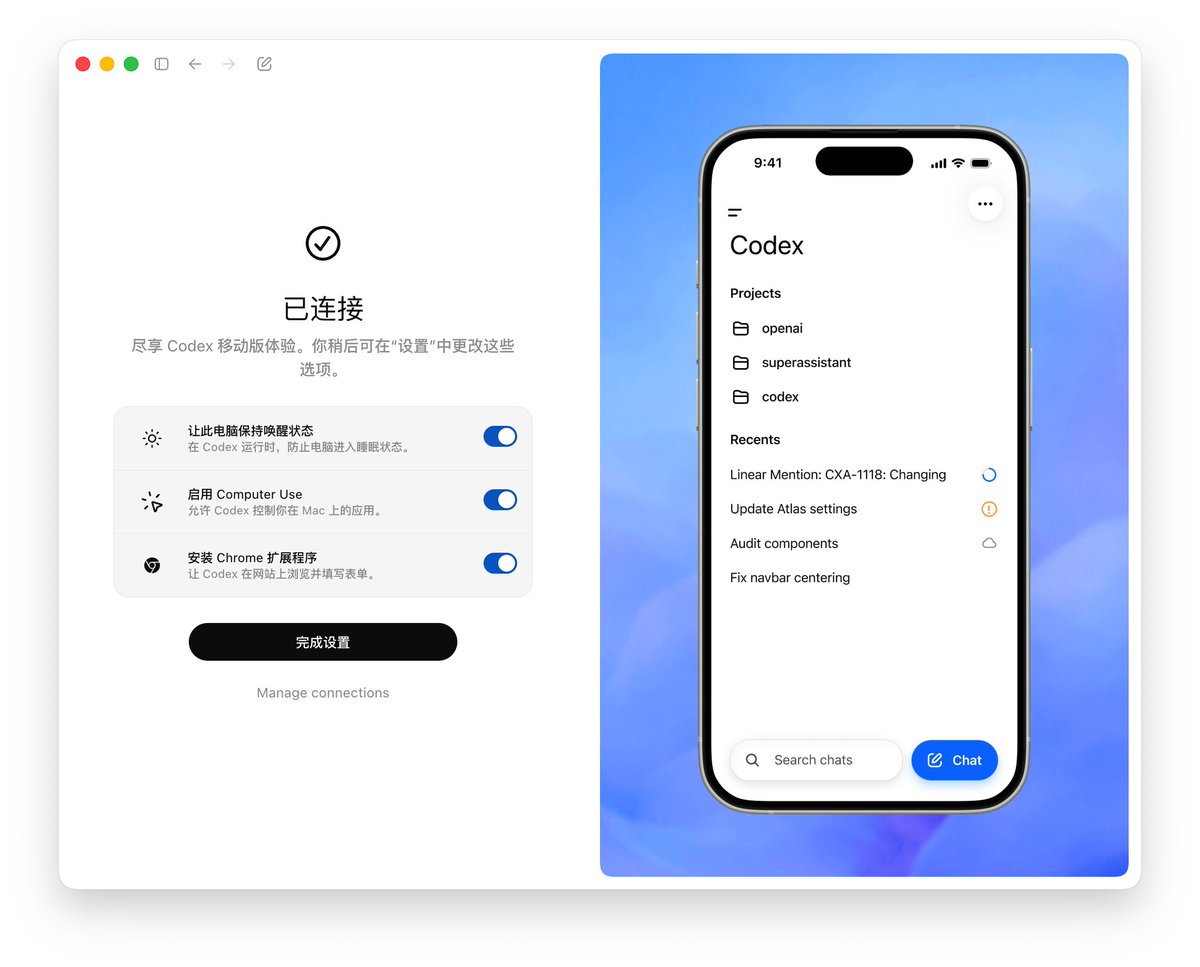

You've been asking for this one... Now in preview: Codex in the ChatGPT mobile app. Start new work, review outputs, steer execution, and approve next steps, all from the ChatGPT mobile app. Codex will keep running on your laptop, Mac mini, or devbox.

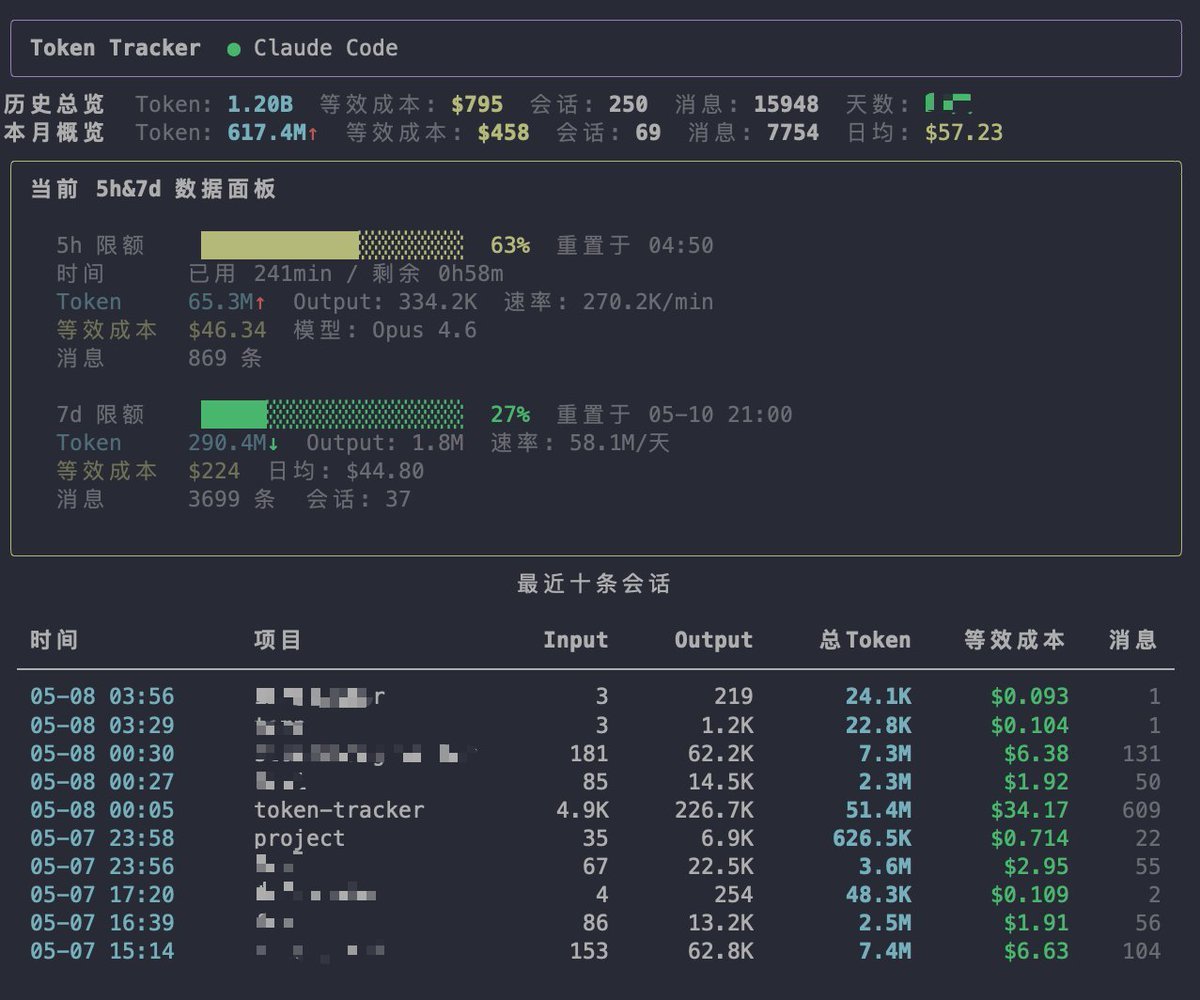

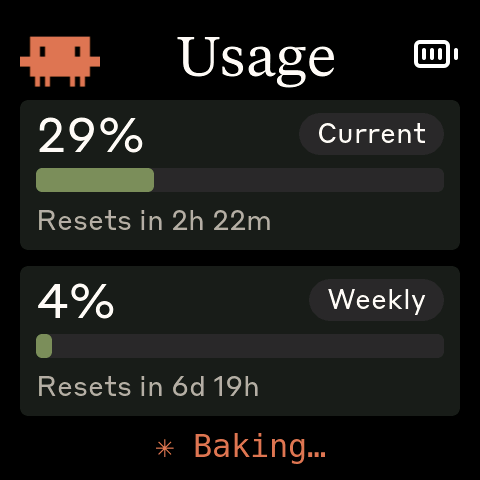

我算出了 GPT Pro 会员在 Codex 里面的实际 Token 单价竟然和中转站的价格相差甚微!我使用的是@cccchuizid 的PackyAPI,具体情况如下: 前两天从 GPT 的20倍 Pro 会员降到了5倍的档位。 然后上一周过完了之后,Token 差不多都用完了,就还剩6%。我让 Codex 帮我统计了一下过去一周的 Token 用量,并且估算出了,如果用到100%的话,分别 input、input hit cache、output 在 fast 和非 fast 以及在有两倍 promotion 和没有两倍 promotion 的情况下,实际上对应的 token 单价是多少 结果如下: Packy codex-sale x0.4: 比你的 10x promo 非 Fast 贵约 1.80 倍 比你的 10x promo Fast 便宜约 28% 比你的 5x 非 Fast 便宜约 10% 比你的 5x Fast 便宜约 64% Packy codex x0.5: 比你的 10x promo 非 Fast 贵约 2.26 倍 比你的 10x promo Fast 便宜约 10% 比你的 5x 非 Fast 贵约 13% 比你的 5x Fast 便宜约 55% 图中是详细的各个档位下的实际单价 可以推断的一点是10倍的 Promotion 非 fast 情况下的单价其实非常之低。然后这个单价理论上应该是跟20倍档位的 Pro 的单价应该是一样的。因为20倍的 Pro 的档位,默认包含了两倍的 Promotion。 那么由此可以推断出另外一个结论: 如果你的用量还没到5倍 Pro 的水平,按量用中转站其实可能更划算,尤其是 codex-sale 这种价格。 但如果你的用量已经超过了5倍,甚至接近10倍,而且主要跑 Codex / GPT-5.5 这种高价模型,那么这种情况下直接买官方 Pro 反而更划算。中转站当然也有稳定性和账号风险的问题,这个就看个人取舍。

我算出了 GPT Pro 会员在 Codex 里面的实际 Token 单价竟然和中转站的价格相差甚微!我使用的是@cccchuizid 的PackyAPI,具体情况如下: 前两天从 GPT 的20倍 Pro 会员降到了5倍的档位。 然后上一周过完了之后,Token 差不多都用完了,就还剩6%。我让 Codex 帮我统计了一下过去一周的 Token 用量,并且估算出了,如果用到100%的话,分别 input、input hit cache、output 在 fast 和非 fast 以及在有两倍 promotion 和没有两倍 promotion 的情况下,实际上对应的 token 单价是多少 结果如下: Packy codex-sale x0.4: 比你的 10x promo 非 Fast 贵约 1.80 倍 比你的 10x promo Fast 便宜约 28% 比你的 5x 非 Fast 便宜约 10% 比你的 5x Fast 便宜约 64% Packy codex x0.5: 比你的 10x promo 非 Fast 贵约 2.26 倍 比你的 10x promo Fast 便宜约 10% 比你的 5x 非 Fast 贵约 13% 比你的 5x Fast 便宜约 55% 图中是详细的各个档位下的实际单价 可以推断的一点是10倍的 Promotion 非 fast 情况下的单价其实非常之低。然后这个单价理论上应该是跟20倍档位的 Pro 的单价应该是一样的。因为20倍的 Pro 的档位,默认包含了两倍的 Promotion。 那么由此可以推断出另外一个结论: 如果你的用量还没到5倍 Pro 的水平,按量用中转站其实可能更划算,尤其是 codex-sale 这种价格。 但如果你的用量已经超过了5倍,甚至接近10倍,而且主要跑 Codex / GPT-5.5 这种高价模型,那么这种情况下直接买官方 Pro 反而更划算。中转站当然也有稳定性和账号风险的问题,这个就看个人取舍。

Introducing npx claude-p A dropin replacement for claude -p

我算出了 GPT Pro 会员在 Codex 里面的实际 Token 单价竟然和中转站的价格相差甚微!我使用的是@cccchuizid 的PackyAPI,具体情况如下: 前两天从 GPT 的20倍 Pro 会员降到了5倍的档位。 然后上一周过完了之后,Token 差不多都用完了,就还剩6%。我让 Codex 帮我统计了一下过去一周的 Token 用量,并且估算出了,如果用到100%的话,分别 input、input hit cache、output 在 fast 和非 fast 以及在有两倍 promotion 和没有两倍 promotion 的情况下,实际上对应的 token 单价是多少 结果如下: Packy codex-sale x0.4: 比你的 10x promo 非 Fast 贵约 1.80 倍 比你的 10x promo Fast 便宜约 28% 比你的 5x 非 Fast 便宜约 10% 比你的 5x Fast 便宜约 64% Packy codex x0.5: 比你的 10x promo 非 Fast 贵约 2.26 倍 比你的 10x promo Fast 便宜约 10% 比你的 5x 非 Fast 贵约 13% 比你的 5x Fast 便宜约 55% 图中是详细的各个档位下的实际单价 可以推断的一点是10倍的 Promotion 非 fast 情况下的单价其实非常之低。然后这个单价理论上应该是跟20倍档位的 Pro 的单价应该是一样的。因为20倍的 Pro 的档位,默认包含了两倍的 Promotion。 那么由此可以推断出另外一个结论: 如果你的用量还没到5倍 Pro 的水平,按量用中转站其实可能更划算,尤其是 codex-sale 这种价格。 但如果你的用量已经超过了5倍,甚至接近10倍,而且主要跑 Codex / GPT-5.5 这种高价模型,那么这种情况下直接买官方 Pro 反而更划算。中转站当然也有稳定性和账号风险的问题,这个就看个人取舍。

我算出了 GPT Pro 会员在 Codex 里面的实际 Token 单价竟然和中转站的价格相差甚微!我使用的是@cccchuizid 的PackyAPI,具体情况如下: 前两天从 GPT 的20倍 Pro 会员降到了5倍的档位。 然后上一周过完了之后,Token 差不多都用完了,就还剩6%。我让 Codex 帮我统计了一下过去一周的 Token 用量,并且估算出了,如果用到100%的话,分别 input、input hit cache、output 在 fast 和非 fast 以及在有两倍 promotion 和没有两倍 promotion 的情况下,实际上对应的 token 单价是多少 结果如下: Packy codex-sale x0.4: 比你的 10x promo 非 Fast 贵约 1.80 倍 比你的 10x promo Fast 便宜约 28% 比你的 5x 非 Fast 便宜约 10% 比你的 5x Fast 便宜约 64% Packy codex x0.5: 比你的 10x promo 非 Fast 贵约 2.26 倍 比你的 10x promo Fast 便宜约 10% 比你的 5x 非 Fast 贵约 13% 比你的 5x Fast 便宜约 55% 图中是详细的各个档位下的实际单价 可以推断的一点是10倍的 Promotion 非 fast 情况下的单价其实非常之低。然后这个单价理论上应该是跟20倍档位的 Pro 的单价应该是一样的。因为20倍的 Pro 的档位,默认包含了两倍的 Promotion。 那么由此可以推断出另外一个结论: 如果你的用量还没到5倍 Pro 的水平,按量用中转站其实可能更划算,尤其是 codex-sale 这种价格。 但如果你的用量已经超过了5倍,甚至接近10倍,而且主要跑 Codex / GPT-5.5 这种高价模型,那么这种情况下直接买官方 Pro 反而更划算。中转站当然也有稳定性和账号风险的问题,这个就看个人取舍。

小小东 大字报 生图 skills 开发得差不多了 比如输入一个 你要的主题 就可以批量得出5个图片,给你选择。 而且满足你主题。 比如我的文本是: `GPT2: 泼墨海报 x 大气大气真大气` 你在codex中提提要求,就能得到如下多个画面: 一切风格,全部AI 自行判断,无限可能。 而不要你各种在汤底+各种啰嗦的配料。 啥时候github公布,问,问就是明天。

我算出了 GPT Pro 会员在 Codex 里面的实际 Token 单价竟然和中转站的价格相差甚微!我使用的是@cccchuizid 的PackyAPI,具体情况如下: 前两天从 GPT 的20倍 Pro 会员降到了5倍的档位。 然后上一周过完了之后,Token 差不多都用完了,就还剩6%。我让 Codex 帮我统计了一下过去一周的 Token 用量,并且估算出了,如果用到100%的话,分别 input、input hit cache、output 在 fast 和非 fast 以及在有两倍 promotion 和没有两倍 promotion 的情况下,实际上对应的 token 单价是多少 结果如下: Packy codex-sale x0.4: 比你的 10x promo 非 Fast 贵约 1.80 倍 比你的 10x promo Fast 便宜约 28% 比你的 5x 非 Fast 便宜约 10% 比你的 5x Fast 便宜约 64% Packy codex x0.5: 比你的 10x promo 非 Fast 贵约 2.26 倍 比你的 10x promo Fast 便宜约 10% 比你的 5x 非 Fast 贵约 13% 比你的 5x Fast 便宜约 55% 图中是详细的各个档位下的实际单价 可以推断的一点是10倍的 Promotion 非 fast 情况下的单价其实非常之低。然后这个单价理论上应该是跟20倍档位的 Pro 的单价应该是一样的。因为20倍的 Pro 的档位,默认包含了两倍的 Promotion。 那么由此可以推断出另外一个结论: 如果你的用量还没到5倍 Pro 的水平,按量用中转站其实可能更划算,尤其是 codex-sale 这种价格。 但如果你的用量已经超过了5倍,甚至接近10倍,而且主要跑 Codex / GPT-5.5 这种高价模型,那么这种情况下直接买官方 Pro 反而更划算。中转站当然也有稳定性和账号风险的问题,这个就看个人取舍。

我算出了 GPT Pro 会员在 Codex 里面的实际 Token 单价竟然和中转站的价格相差甚微!我使用的是@cccchuizid 的PackyAPI,具体情况如下: 前两天从 GPT 的20倍 Pro 会员降到了5倍的档位。 然后上一周过完了之后,Token 差不多都用完了,就还剩6%。我让 Codex 帮我统计了一下过去一周的 Token 用量,并且估算出了,如果用到100%的话,分别 input、input hit cache、output 在 fast 和非 fast 以及在有两倍 promotion 和没有两倍 promotion 的情况下,实际上对应的 token 单价是多少 结果如下: Packy codex-sale x0.4: 比你的 10x promo 非 Fast 贵约 1.80 倍 比你的 10x promo Fast 便宜约 28% 比你的 5x 非 Fast 便宜约 10% 比你的 5x Fast 便宜约 64% Packy codex x0.5: 比你的 10x promo 非 Fast 贵约 2.26 倍 比你的 10x promo Fast 便宜约 10% 比你的 5x 非 Fast 贵约 13% 比你的 5x Fast 便宜约 55% 图中是详细的各个档位下的实际单价 可以推断的一点是10倍的 Promotion 非 fast 情况下的单价其实非常之低。然后这个单价理论上应该是跟20倍档位的 Pro 的单价应该是一样的。因为20倍的 Pro 的档位,默认包含了两倍的 Promotion。 那么由此可以推断出另外一个结论: 如果你的用量还没到5倍 Pro 的水平,按量用中转站其实可能更划算,尤其是 codex-sale 这种价格。 但如果你的用量已经超过了5倍,甚至接近10倍,而且主要跑 Codex / GPT-5.5 这种高价模型,那么这种情况下直接买官方 Pro 反而更划算。中转站当然也有稳定性和账号风险的问题,这个就看个人取舍。

我算出了 GPT Pro 会员在 Codex 里面的实际 Token 单价竟然和中转站的价格相差甚微!我使用的是@cccchuizid 的PackyAPI,具体情况如下: 前两天从 GPT 的20倍 Pro 会员降到了5倍的档位。 然后上一周过完了之后,Token 差不多都用完了,就还剩6%。我让 Codex 帮我统计了一下过去一周的 Token 用量,并且估算出了,如果用到100%的话,分别 input、input hit cache、output 在 fast 和非 fast 以及在有两倍 promotion 和没有两倍 promotion 的情况下,实际上对应的 token 单价是多少 结果如下: Packy codex-sale x0.4: 比你的 10x promo 非 Fast 贵约 1.80 倍 比你的 10x promo Fast 便宜约 28% 比你的 5x 非 Fast 便宜约 10% 比你的 5x Fast 便宜约 64% Packy codex x0.5: 比你的 10x promo 非 Fast 贵约 2.26 倍 比你的 10x promo Fast 便宜约 10% 比你的 5x 非 Fast 贵约 13% 比你的 5x Fast 便宜约 55% 图中是详细的各个档位下的实际单价 可以推断的一点是10倍的 Promotion 非 fast 情况下的单价其实非常之低。然后这个单价理论上应该是跟20倍档位的 Pro 的单价应该是一样的。因为20倍的 Pro 的档位,默认包含了两倍的 Promotion。 那么由此可以推断出另外一个结论: 如果你的用量还没到5倍 Pro 的水平,按量用中转站其实可能更划算,尤其是 codex-sale 这种价格。 但如果你的用量已经超过了5倍,甚至接近10倍,而且主要跑 Codex / GPT-5.5 这种高价模型,那么这种情况下直接买官方 Pro 反而更划算。中转站当然也有稳定性和账号风险的问题,这个就看个人取舍。

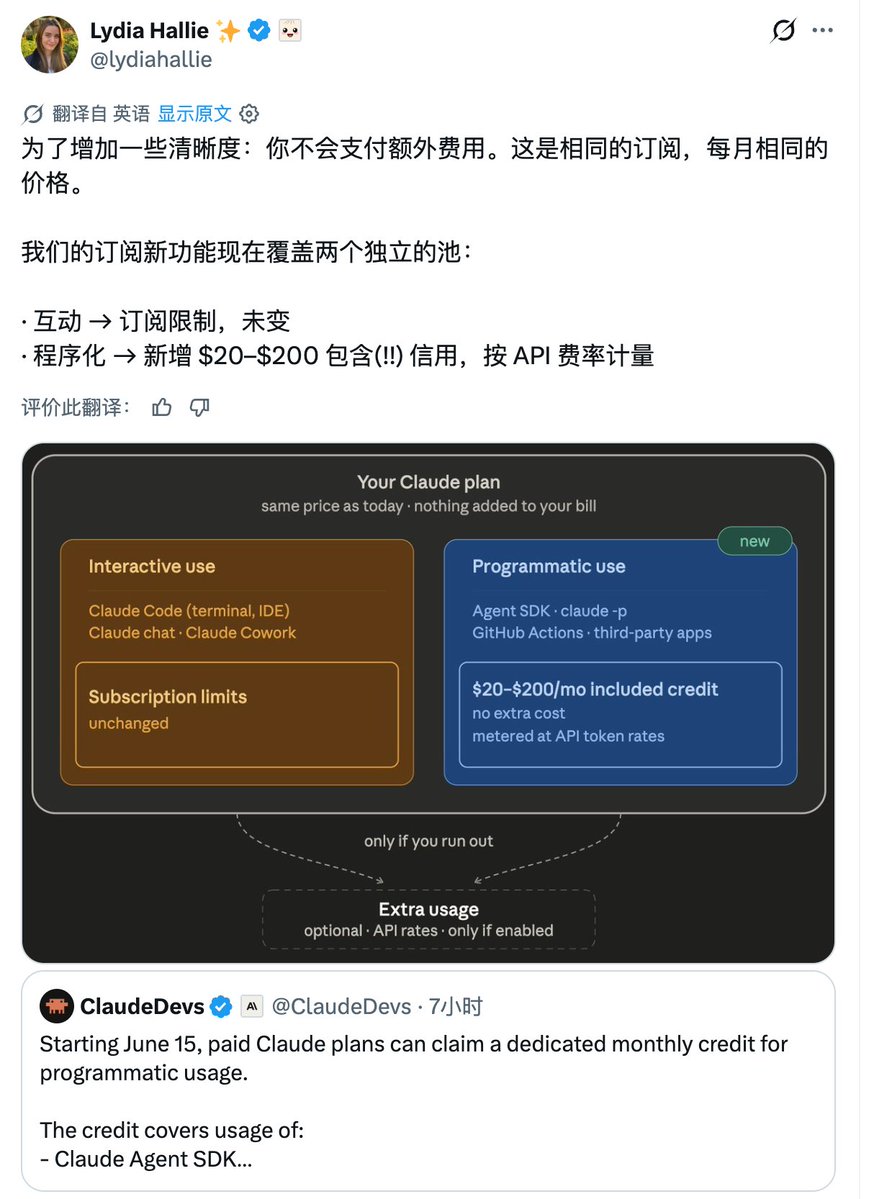

To add some clarity: you don't pay extra. It's the same subscription, same price per month. What's new our sub now covers two separate pools: · Interactive → sub limits, unchanged · Programmatic → new $20–$200 included(!!) credit, metered at API rates

我算出了 GPT Pro 会员在 Codex 里面的实际 Token 单价竟然和中转站的价格相差甚微!我使用的是@cccchuizid 的PackyAPI,具体情况如下: 前两天从 GPT 的20倍 Pro 会员降到了5倍的档位。 然后上一周过完了之后,Token 差不多都用完了,就还剩6%。我让 Codex 帮我统计了一下过去一周的 Token 用量,并且估算出了,如果用到100%的话,分别 input、input hit cache、output 在 fast 和非 fast 以及在有两倍 promotion 和没有两倍 promotion 的情况下,实际上对应的 token 单价是多少 结果如下: Packy codex-sale x0.4: 比你的 10x promo 非 Fast 贵约 1.80 倍 比你的 10x promo Fast 便宜约 28% 比你的 5x 非 Fast 便宜约 10% 比你的 5x Fast 便宜约 64% Packy codex x0.5: 比你的 10x promo 非 Fast 贵约 2.26 倍 比你的 10x promo Fast 便宜约 10% 比你的 5x 非 Fast 贵约 13% 比你的 5x Fast 便宜约 55% 图中是详细的各个档位下的实际单价 可以推断的一点是10倍的 Promotion 非 fast 情况下的单价其实非常之低。然后这个单价理论上应该是跟20倍档位的 Pro 的单价应该是一样的。因为20倍的 Pro 的档位,默认包含了两倍的 Promotion。 那么由此可以推断出另外一个结论: 如果你的用量还没到5倍 Pro 的水平,按量用中转站其实可能更划算,尤其是 codex-sale 这种价格。 但如果你的用量已经超过了5倍,甚至接近10倍,而且主要跑 Codex / GPT-5.5 这种高价模型,那么这种情况下直接买官方 Pro 反而更划算。中转站当然也有稳定性和账号风险的问题,这个就看个人取舍。

我算出了 GPT Pro 会员在 Codex 里面的实际 Token 单价竟然和中转站的价格相差甚微!我使用的是@cccchuizid 的PackyAPI,具体情况如下: 前两天从 GPT 的20倍 Pro 会员降到了5倍的档位。 然后上一周过完了之后,Token 差不多都用完了,就还剩6%。我让 Codex 帮我统计了一下过去一周的 Token 用量,并且估算出了,如果用到100%的话,分别 input、input hit cache、output 在 fast 和非 fast 以及在有两倍 promotion 和没有两倍 promotion 的情况下,实际上对应的 token 单价是多少 结果如下: Packy codex-sale x0.4: 比你的 10x promo 非 Fast 贵约 1.80 倍 比你的 10x promo Fast 便宜约 28% 比你的 5x 非 Fast 便宜约 10% 比你的 5x Fast 便宜约 64% Packy codex x0.5: 比你的 10x promo 非 Fast 贵约 2.26 倍 比你的 10x promo Fast 便宜约 10% 比你的 5x 非 Fast 贵约 13% 比你的 5x Fast 便宜约 55% 图中是详细的各个档位下的实际单价 可以推断的一点是10倍的 Promotion 非 fast 情况下的单价其实非常之低。然后这个单价理论上应该是跟20倍档位的 Pro 的单价应该是一样的。因为20倍的 Pro 的档位,默认包含了两倍的 Promotion。 那么由此可以推断出另外一个结论: 如果你的用量还没到5倍 Pro 的水平,按量用中转站其实可能更划算,尤其是 codex-sale 这种价格。 但如果你的用量已经超过了5倍,甚至接近10倍,而且主要跑 Codex / GPT-5.5 这种高价模型,那么这种情况下直接买官方 Pro 反而更划算。中转站当然也有稳定性和账号风险的问题,这个就看个人取舍。

我算出了 GPT Pro 会员在 Codex 里面的实际 Token 单价竟然和中转站的价格相差甚微!我使用的是@cccchuizid 的PackyAPI,具体情况如下: 前两天从 GPT 的20倍 Pro 会员降到了5倍的档位。 然后上一周过完了之后,Token 差不多都用完了,就还剩6%。我让 Codex 帮我统计了一下过去一周的 Token 用量,并且估算出了,如果用到100%的话,分别 input、input hit cache、output 在 fast 和非 fast 以及在有两倍 promotion 和没有两倍 promotion 的情况下,实际上对应的 token 单价是多少 结果如下: Packy codex-sale x0.4: 比你的 10x promo 非 Fast 贵约 1.80 倍 比你的 10x promo Fast 便宜约 28% 比你的 5x 非 Fast 便宜约 10% 比你的 5x Fast 便宜约 64% Packy codex x0.5: 比你的 10x promo 非 Fast 贵约 2.26 倍 比你的 10x promo Fast 便宜约 10% 比你的 5x 非 Fast 贵约 13% 比你的 5x Fast 便宜约 55% 图中是详细的各个档位下的实际单价 可以推断的一点是10倍的 Promotion 非 fast 情况下的单价其实非常之低。然后这个单价理论上应该是跟20倍档位的 Pro 的单价应该是一样的。因为20倍的 Pro 的档位,默认包含了两倍的 Promotion。 那么由此可以推断出另外一个结论: 如果你的用量还没到5倍 Pro 的水平,按量用中转站其实可能更划算,尤其是 codex-sale 这种价格。 但如果你的用量已经超过了5倍,甚至接近10倍,而且主要跑 Codex / GPT-5.5 这种高价模型,那么这种情况下直接买官方 Pro 反而更划算。中转站当然也有稳定性和账号风险的问题,这个就看个人取舍。

微软又整活了❗️开源了个叫 TRELLIS 的 3D 生成模型,还直接入选 CVPR'25 Spotlight 一句话总结:丢张图或打几个字,高质量 3D 资产直接给你吐出来,3D 建模师怕不是要集体失业😅 四个点说完: 1️⃣ 生成质量能打,形状纹理都在线 2️⃣ 输出格式随便选,Radiance Fields、3D Gaussians、Mesh 全都要 3️⃣ 支持局部编辑,不满意直接改,不用重做 4️⃣ 还能塞多张图进去,生成更贴近你想要的模型 官网有 Demo 可以直接玩,设计师、开发者、搞研究的都冲一波 🔗 github.com/microsoft/TREL… 🔗 trellis3d.github.io

我算出了 GPT Pro 会员在 Codex 里面的实际 Token 单价竟然和中转站的价格相差甚微!我使用的是@cccchuizid 的PackyAPI,具体情况如下: 前两天从 GPT 的20倍 Pro 会员降到了5倍的档位。 然后上一周过完了之后,Token 差不多都用完了,就还剩6%。我让 Codex 帮我统计了一下过去一周的 Token 用量,并且估算出了,如果用到100%的话,分别 input、input hit cache、output 在 fast 和非 fast 以及在有两倍 promotion 和没有两倍 promotion 的情况下,实际上对应的 token 单价是多少 结果如下: Packy codex-sale x0.4: 比你的 10x promo 非 Fast 贵约 1.80 倍 比你的 10x promo Fast 便宜约 28% 比你的 5x 非 Fast 便宜约 10% 比你的 5x Fast 便宜约 64% Packy codex x0.5: 比你的 10x promo 非 Fast 贵约 2.26 倍 比你的 10x promo Fast 便宜约 10% 比你的 5x 非 Fast 贵约 13% 比你的 5x Fast 便宜约 55% 图中是详细的各个档位下的实际单价 可以推断的一点是10倍的 Promotion 非 fast 情况下的单价其实非常之低。然后这个单价理论上应该是跟20倍档位的 Pro 的单价应该是一样的。因为20倍的 Pro 的档位,默认包含了两倍的 Promotion。 那么由此可以推断出另外一个结论: 如果你的用量还没到5倍 Pro 的水平,按量用中转站其实可能更划算,尤其是 codex-sale 这种价格。 但如果你的用量已经超过了5倍,甚至接近10倍,而且主要跑 Codex / GPT-5.5 这种高价模型,那么这种情况下直接买官方 Pro 反而更划算。中转站当然也有稳定性和账号风险的问题,这个就看个人取舍。