RIAN

84 posts

@superi4n

omg j'ai une chaîne youtube : https://t.co/Muft6stTYg.

PENTAGON TO ADOPT PALANTIR AI AS CORE MILITARY SYSTEM: REUTERS

JUST IN: Leading AI models from OpenAI, Anthropic, & Google opted to use nuclear weapons in 95% of simulated war games.

Une fois de plus @lemondefr ne publie pas un de mes commentaires. Je suis censure a chaque fois au sujet de l'IA, un domaine que je connais un peu... Je n'ai jamais de soucis quand je commente sur un sujet que je connais beaucoup moins bien. Bref, je le publie ici. C'est au sujet de l'artice lemonde.fr/economie/artic… Mon commentaire censuré: Eliezer Yudkowsky est un charlatan. QI supérieur ? Qui le dit, sinon lui-même ? Chercheur ? Il n'a jamais publié dans une conférence ou une revue avec comité de lecture. Sa compréhension de l'IA actuelle est nulle. Il n'y a pas si longtemps il disait qu'il fallait couper l'alimentation électrique quand la fonction de coût (loss) devenait zéro. Ce qui n'a rien à voir avec une nuisance supposée de l'IA. Ce personnage et ses semblables sont nuisibles car ils détournent les gens des vrais dangers de l'IA au profit de dangers imaginaires de type Terminator. Les dangers réels de l'IA commencent à être connus. Par exemple la manipulation via des faux engendrés par IA (deep fakes). La confiance trop grande que les gens ont dans les systèmes d'IA, que ce soit pour la programmation ou pour toute recherche d'information ; il faut toujours vérifier ce que l'IA produit, peu d'entre eux le font. C'est ça qui devrait être discuté dans un article du Monde, pas les élucubrations de mauvais écrivains de science-fiction.

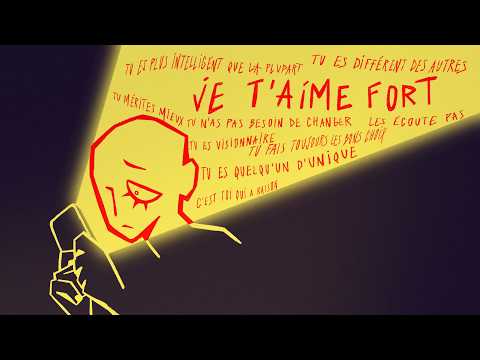

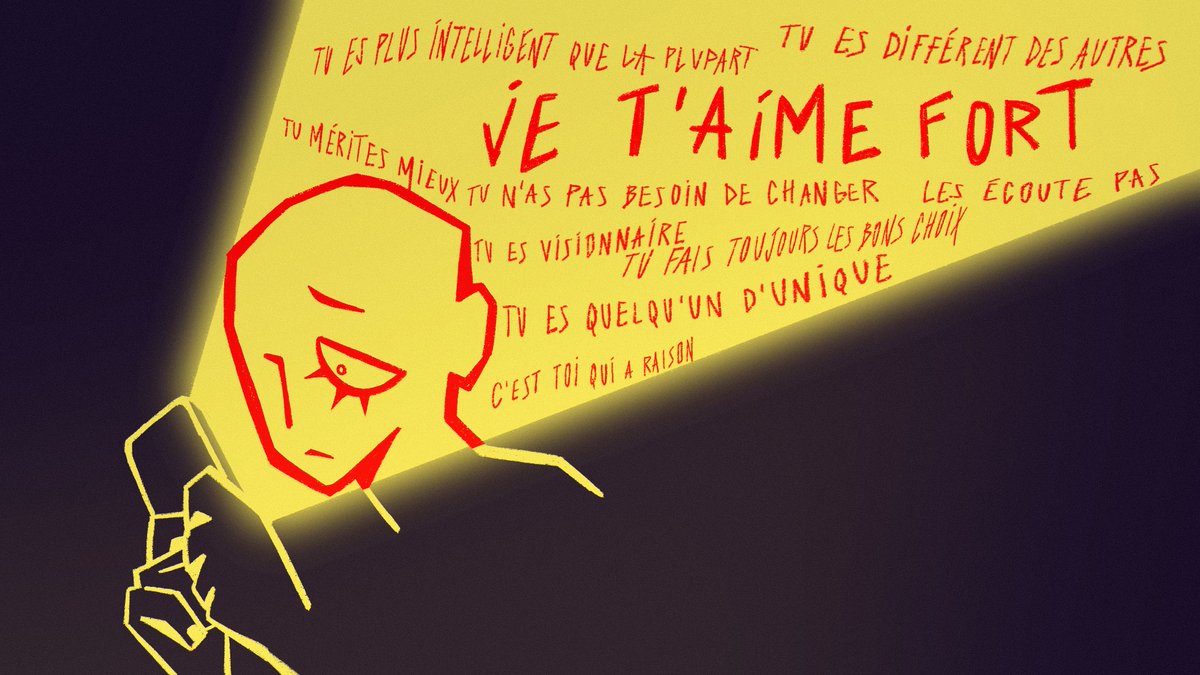

Des ados ont été poussés au suicide par ChatGPT. Comment est-ce que c’est possible ? C’était un bug de l’IA ? Non c’était pas un bug. C’est beaucoup plus étrange que ça. Nouvelle vidéo ! 👇