uprmthr

14.3K posts

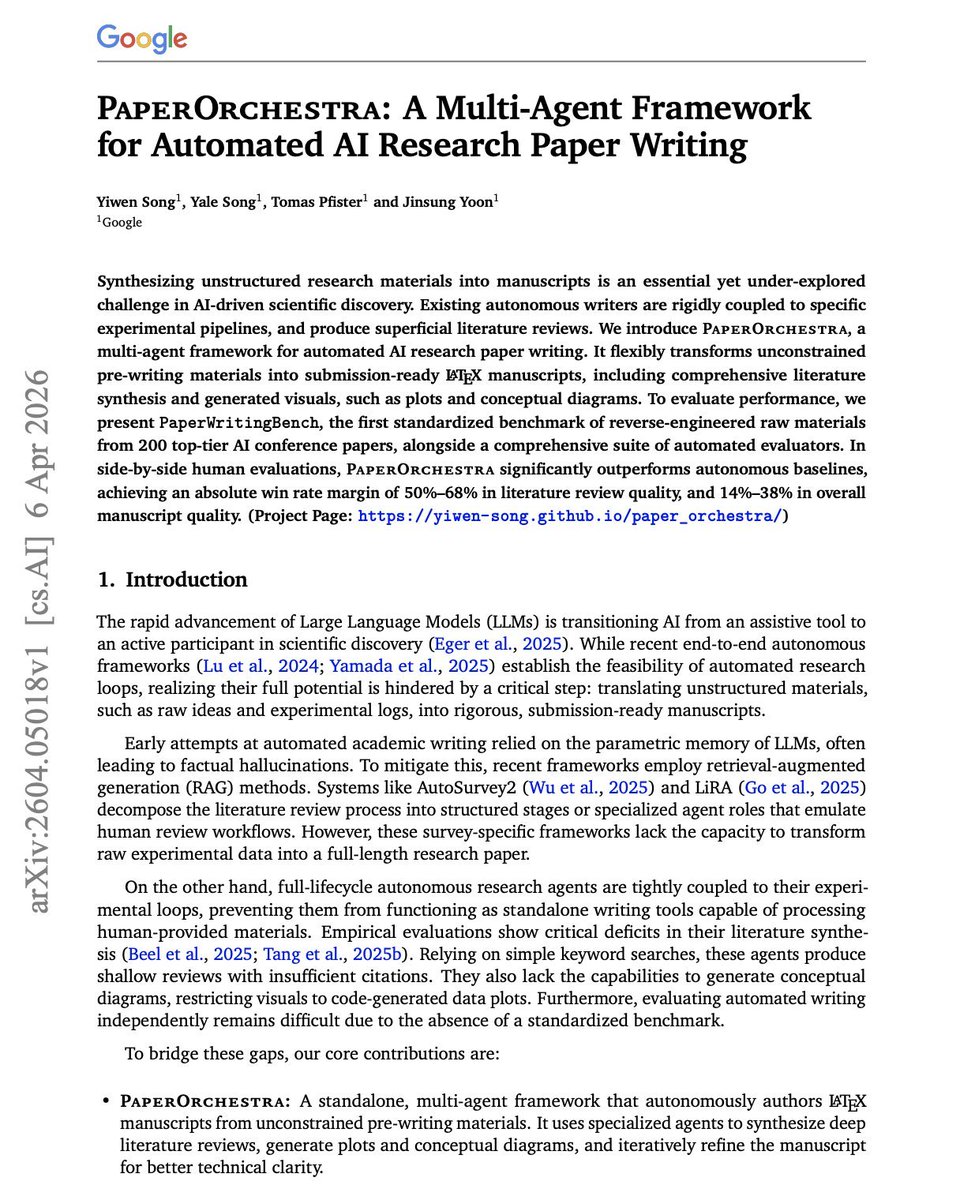

NEW paper from Google on multi-agent research agents. It's one of the first systems that handles end-to-end LaTeX generation, targeted literature reviews, and conceptual diagrams as a decoupled, standalone writer. Automated research frameworks can run experiments, but their writing modules remain the weakest link. Literature reviews are shallow, citations are sparse, and no system generates conceptual diagrams. This new research introduces a standalone writing framework that addresses all of this. PaperOrchestra is a multi-agent system that transforms unconstrained pre-writing materials, raw ideas, experimental logs, notes, into submission-ready LaTeX manuscripts. It uses specialized agents for deep literature synthesis, plot generation, conceptual diagram creation, and iterative refinement. The team also releases PaperWritingBench, the first standardized benchmark with reverse-engineered materials from 200 top-tier AI conference papers. Why does it matter? In side-by-side human evaluations, PaperOrchestra achieved absolute win rate margins of 50 to 68% in literature review quality and 14 to 38% in overall manuscript quality over autonomous baselines. Paper: arxiv.org/abs/2604.05018 Learn to build effective AI agents in our academy: academy.dair.ai

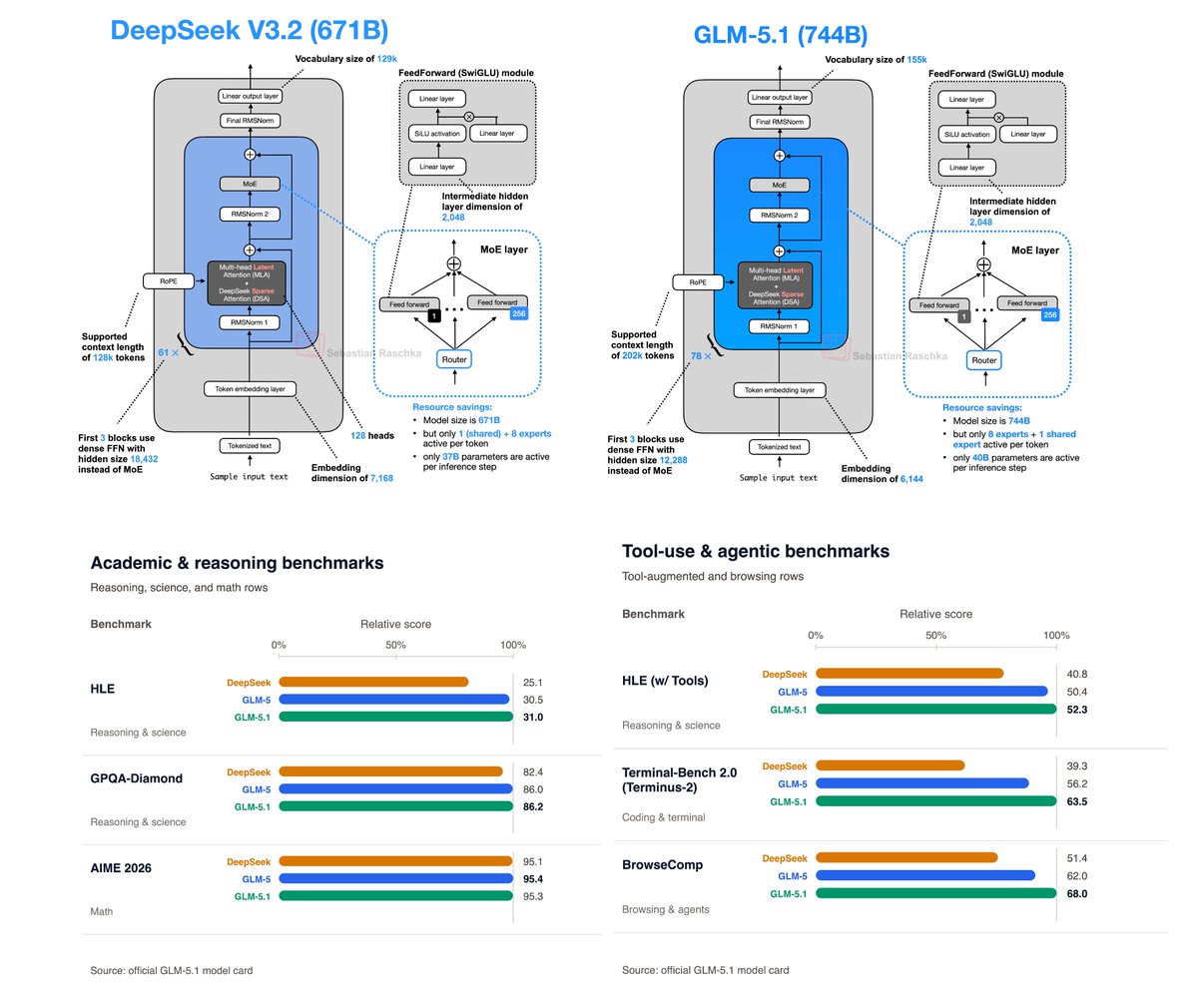

Introducing GLM-5.1: The Next Level of Open Source - Top-Tier Performance: #1 in open source and #3 globally across SWE-Bench Pro, Terminal-Bench, and NL2Repo. - Built for Long-Horizon Tasks: Runs autonomously for 8 hours, refining strategies through thousands of iterations. Blog: z.ai/blog/glm-5.1 Weights: huggingface.co/zai-org/GLM-5.1 API: docs.z.ai/guides/llm/glm… Coding Plan: z.ai/subscribe Coming to chat.z.ai in the next few days.