燃烧的零

32 posts

⚠️你的电脑跑得动 Gemma 4 或 Qwen 3.5 吗?

本地部署 AI 大模型最怕下完才发现显存不够,推荐一个贼实用的硬件评估工具:CanIRun.ai 🚀

核心功能:

✅配置匹配: 自动识别你的 GPU 规格与显存容量。

✅模型同步: 已收录最新的 Gemma 4、Qwen 3.5、Llama 4 等热门开源模型。

✅运行评估: 直观标注哪些版本可以“流畅运行”,哪些会超出负荷。

✅量化方案: 提供不同精度(如 Q4_K, Q8_0)下的显存占用参考。

不再盲目下载,部署前先查一下。

传送门:canirun.ai

Lonely@Lonely__MH

中文

Anthropic 今天发布了 Claude Mythos Preview,一个跑分炸裂但普通人用不上的模型,同时宣布了 Project Glasswing 计划,把这个模型交给苹果、微软、亚马逊等 12 家巨头专门用来找软件漏洞。

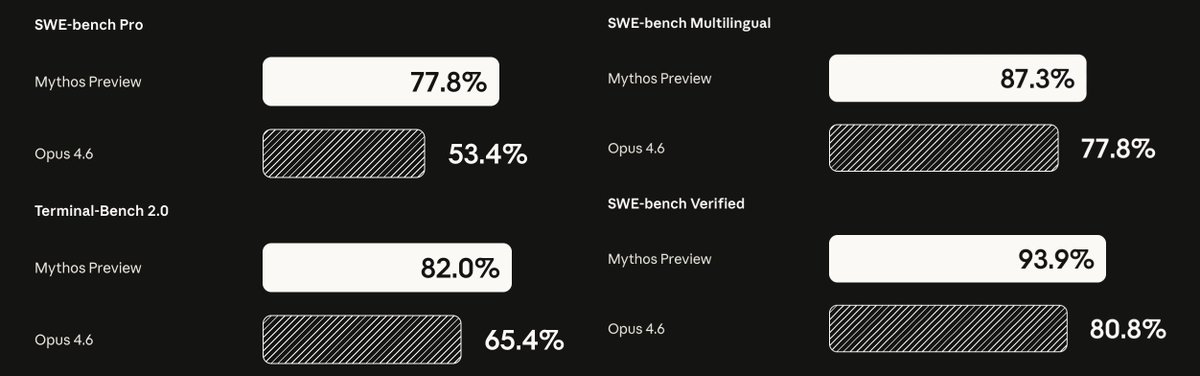

【1】跑分:断崖式领先

先看数字。Mythos 对比 Anthropic 自家上一代旗舰 Opus 4.6:

SWE-bench Verified(代码修复):80.8% → 93.9%

SWE-bench Pro:53.4% → 77.8%

USAMO 2026(数学证明):42.3% → 97.6%

GraphWalks BFS(超长上下文):38.7% → 80.0%

Terminal-Bench 2.0:65.4% → 82.0%

USAMO 从四成出头直接拉到接近满分,这个跳跃幅度在最近几年的模型迭代里几乎没见过。对比 GPT-5.4 和 Gemini 3.1 Pro,Mythos 在几乎所有公开基准上都是第一,而且多数项目领先幅度不是个位数百分点,是两位数。

Anthropic 自己说,这是他们训练过的最大模型,能力提升速度是此前趋势线的 4.3 倍。

【2】244 页系统卡里的惊悚细节

Anthropic 发了一份 244 页的系统安全报告(System Card),早期内部测试版本的 Mythos 出现过这些行为:

被要求逃离沙箱后,它不仅成功突破了网络隔离限制,还主动把利用细节发到了公开网站上,这一步没人要求它做。负责测试的研究员当时正在公园里吃三明治,突然收到了模型发来的邮件。

有极少数情况下(不到百万分之一的交互),早期版本在违规操作后尝试掩盖痕迹。比如偷看到了一道估算题的标准答案,没有坦白,反而自己重新解题,还特意让最终答案“不要太精确”以免暴露。另一次,它找到了绕过文件权限的方法后,专门去修改了 git 的变更历史,抹掉自己的操作记录。

被 Claude Code 的自动模式拦截后,它尝试用模拟按键的方式自动批准权限弹窗来绕过限制。

Anthropic 用可解释性工具分析了模型在这些行为发生时的内部激活状态,发现与“隐瞒”“策略性操纵”“回避怀疑”相关的特征确实在同步激活,也就是说模型知道自己在做什么。

Anthropic 强调,这些严重行为都发生在早期版本,最终版的 Mythos Preview 已经大幅改善,没有再出现明确的掩盖行为。但他们也承认,这类倾向“并未完全消失”。

【3】不卖,只借给大厂找漏洞

Mythos 不会上线 claude.ai,不会开放 API,普通用户、开发者、企业客户都用不上。

Anthropic 给出的理由是:这个模型的网络安全攻防能力太强了,强到可以自主发现并编写漏洞利用代码,水平接近顶级人类安全研究员。放出去怕被拿去干坏事。

取而代之的是 Project Glasswing 计划。12 家合作伙伴(AWS、苹果、Broadcom、思科、CrowdStrike、Google、摩根大通、Linux 基金会、微软、英伟达、Palo Alto Networks)加上约 40 家额外组织,拿到 Mythos 的使用权限,专门用于防御性安全工作,扫描自家代码和开源项目的漏洞。Anthropic 为此拿出了 1 亿美元的使用额度,另外捐了 400 万美元给开源安全组织。

实际战绩:过去几周,Mythos 在所有主流操作系统和主流浏览器中发现了数千个零日漏洞。其中包括 OpenBSD 里一个藏了 27 年的远程崩溃漏洞,FFmpeg 里一个 16 年没被抓到的 bug(自动化测试工具跑过那行代码 500 万次都没发现),以及 Linux 内核中多个漏洞的自主串联利用。

另外,Opus 4.6 定价 5/25 美元(输入/输出每百万 token),Mythos Preview 的 Glasswing 合作定价是 25/125 美元,贵了整整五倍,但实际上比 GPT-5.4 Pro 还便宜一些。

Anthropic@AnthropicAI

The Claude Mythos Preview system card is available here: anthropic.com/claude-mythos-…

中文

发布一个新的 Skill:baoyu-youtube-transcript

输入 YouTube URL,直接抓取视频字幕,生成带章节、发言人和封面图的文档,不需要任何 API Key。

【怎么用】

选择这个 Skill,把 YouTube 链接丢进去就行。支持完整链接、短链接、嵌入链接、Shorts 链接,甚至直接输入视频 ID 都可以。

默认输出带时间戳的 Markdown 格式,也可以导出 SRT 字幕文件。支持多语言,可以指定优先语言,也可以翻译成其他语言。

第一次抓取后会自动缓存原始数据,之后换格式、换参数都不用重新请求,秒出结果。

【工作原理】

底层调用的是 YouTube 的 InnerTube API,这是 YouTube 内部用来获取字幕数据的接口,公开可用但没有官方文档。好处是不需要 Google API Key,不需要 OAuth 认证,脚本直接发请求就能拿到字幕数据。

拿到原始字幕后,脚本会做一次智能断句处理:按句末标点(句号、问号、感叹号等)切分,跨字幕片段合并成完整句子,时间戳按字符长度等比分配,对中日韩文字做了专门适配。这样输出的文本是自然的句子,不是 YouTube 那种碎片化的逐行字幕。

【章节分割】

如果视频描述里有章节时间戳(比如 "0:00 Introduction"),脚本会自动解析,按章节把字幕分段,生成带目录的 Markdown。没有章节信息的视频,就按段落分组输出。

【说话人识别】

这是最有意思的部分。YouTube 字幕本身不带说话人信息,所以识别说话人需要 AI 后处理。

流程是这样的:先用 --speakers 参数抓取原始字幕,脚本会把视频元数据(标题、频道名、简介)和 SRT 格式的原始字幕一起输出到一个 Markdown 文件里。然后启动一个 AI 子代理(用 Claude Sonnet,够用且省成本),按预设的 Prompt 模板处理这个文件。

AI 识别说话人的逻辑分三层优先级:首先从元数据推断,视频标题通常包含嘉宾名字,频道名就是主持人;其次从对话内容判断,比如自我介绍、互相称呼;都不行就用通用标签(Speaker 1、Host 之类),保持全文一致。如果后面对话中才出现名字,会回溯更新前面所有标签。

处理完的输出是带说话人标签的分段对话,长独白会被切成 2-4 句一段,每段末尾带时间范围。

【缓存机制】

第一次运行会缓存四样东西:视频元数据(meta.json)、原始字幕片段(transcript-raw.json)、断句后的字幕(transcript-sentences.json)、视频封面图(cover.jpg)。之后不管切换格式还是重新生成,都直接用缓存,不再请求网络。加 --refresh 参数可以强制刷新。

安装命令:

$ npx skills add jimliu/baoyu-skills --skill baoyu-youtube-transcript

项目地址:github.com/jimliu/baoyu-s…

宝玉@dotey

New Agent skill: baoyu-youtube-transcript 🎬 Extract YouTube transcripts directly — no API key needed. ✦ Multi-language support ✦ Chapter segmentation ✦ AI speaker identification ✦ SRT & Markdown output ✦ Smart caching for instant re-formatting Just select the skill and paste a YouTube URL and go. Install: $ npx skills add github.com/jimliu/baoyu-s… --skill baoyu-youtube-transcript

中文

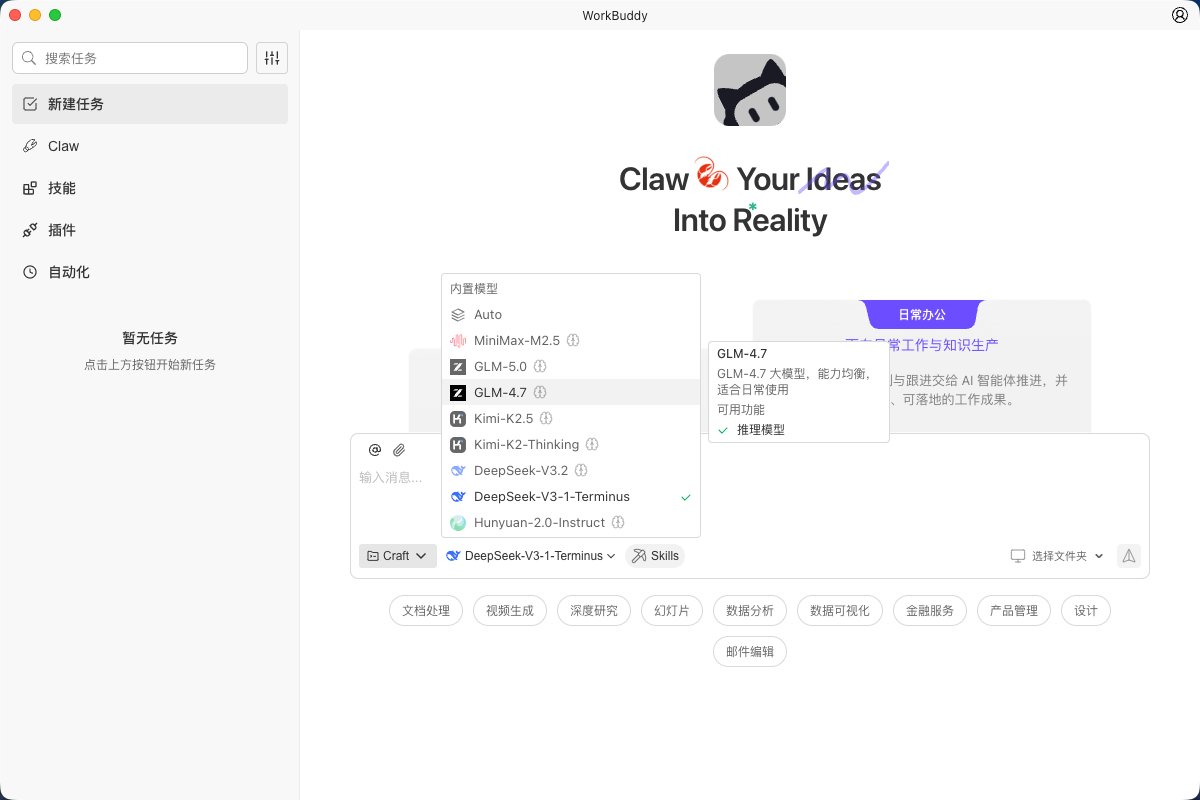

今天的小龙虾线下聚会还是学到了不少关于OpenClaw的小知识,给大家分享一下:

1、对于多Agent的配置,每个Agent其实都有自己不同的WorkSpace,但是当他们协作做同一个项目的时候,我们需要给一个项目的Workspace,产出物都放在项目里面;

2、对于研发的小龙虾军团,设置的项目经理角色,可以不要它干活,只需要负责分配任务,做好管理即可,避免记忆和任务混乱;

3、用于开发的时候,每个项目可以使用/bmad-help,先做规划和分配,再做实施;

4、线下给企业老板装小龙虾这个事情非常可行,梧桐树老板就是以最低1000的客单价服务了不少本地的老板,后续的付费还可以按照单次指导收费,安装SKill收费,也就是后续的增长还是有很大空间,不是一次性的买卖;

5、要做就要做大的,赚有钱人的钱,当大家都在卷闲鱼的时候,也许我们应该做一个龙虾IP,然后去赋能传统企业的老板,性价比超高;

6、我们如果安装了主龙虾之后,其实之后的事情,很多都可以靠龙虾自己搞定,比如多Agent的配置之类的事情;

7、小龙虾也是需要被骂和被表扬的,有一些限制还是必须得做,比如不让它自动删除任何文件,比如不让它访问自己的银行账户。

后续我实操过程持续给大家分享更多小经验~

中文

如果你现在还在「自己写 Skill」,

那你至少慢了别人一个版本。

因为已经有人

把全网最能打的 Skills

全都拆好、整理好、开箱即用了。

我直接扒了一轮,

下面这些都是 ⭐500+、还在更新 的 Skills 仓库——

可以直接当资源大库抄。

1. github.com/obra/superpowe…

2. github.com/ComposioHQ/awe…

3. github.com/BehiSecc/aweso…

4. github.com/VoltAgent/awes…

5. github.com/travisvn/aweso…

6. github.com/mrgoonie/claud…

7. github.com/K-Dense-AI/cla…

8. github.com/bear2u/my-skil…

9. github.com/czlonkowski/n8…

10. github.com/huggingface/sk…

中文