faultbugs

10.2K posts

faultbugs

@faultbugs

Tesla Model 3 owner(2020 model 3 SR+ & 2024 model 3 LR). Rumor Buster. If you wanna know the true facts of Tesla China. Just follow me.

Chinese restaurant's robot waitresses 😳 This is scary.

Anti-dooring protection now rolling out to @Cybertruck This feature comes standard on every new Model 3, Model Y & Cybertruck – using cameras to delay door opening if a cyclist, pedestrian or other vehicle is detected approaching in your blind spot

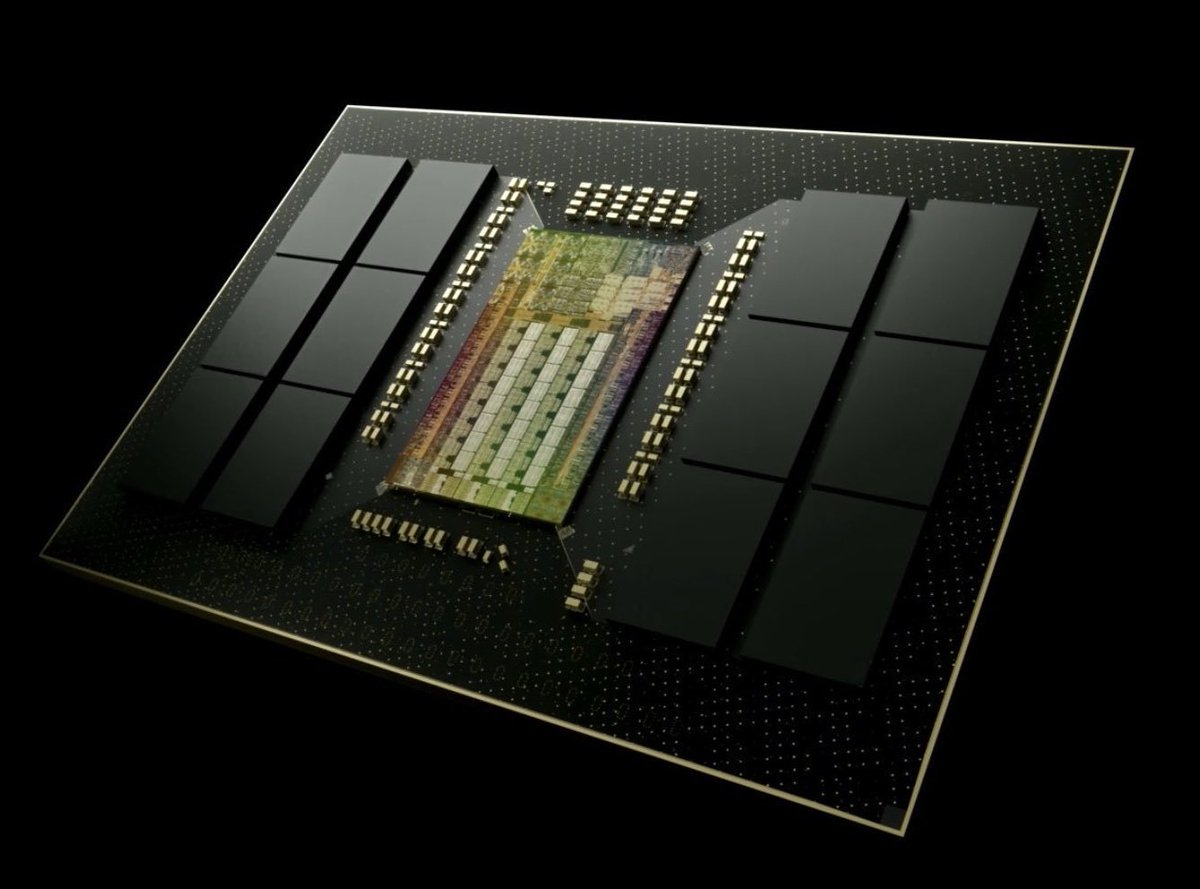

Terafab may be the most essential vertical integration Tesla has ever undertaken— and it is truly non-optional. It will take years to build and will test even Elon’s speedrunning abilities to the limit, but that won’t stop him from trying. The breakthrough likely lies in overhauling the overall facility’s cleanroom model. By moving wafers in sealed pods with localized micro-environments, the fab no longer needs a monolithic ultra-clean space. Elon’s line about “eating cheeseburgers and smoking cigars” on the fab floor isn’t silly, it’s the practical reality of a radically simpler, cheaper, faster approach that could finally change the economics of chipmaking. This is all forced by the brutal “pinch” in chip supply. Tesla must produce on the order of 100–200 billion AI chips per year just to saturate its roadmap. That volume powers: FSD cars & Robotaxis (tens of millions of vehicles needing AI5 inference for near-perfect autonomy), Physical Optimus (scaling from thousands today to millions per year, each requiring AI5/AI6-level compute), Digital Optimus (the new xAI-Tesla software agents for digital/office automation, running massive inference clusters), Space-based data centers (AI7/Dojo3 orbital compute for GW-scale training and inference beyond Earth limits). AI5 delivers the ~10× leap for vehicles and early robots; AI6 shifts focus to Optimus + terrestrial DCs; AI7 goes orbital. No external foundry (TSMC, Samsung, etc.) can deliver that scale or timeline— hence the Terafab launch. Without it, the entire robotics + autonomy future hits a brick wall. Terafab isn’t optional; it’s the only way forward.

Elon Musk의 Terafab 선언 이후 배터리 vs 반도체 기술 난이도 논쟁이 활발해진 것 같습니다. 제 생각을 하나 얹다면, 두 분야는 주도하는 기술 분야의 특성이 달라, 각각 서로 다른 난점이 있다고 생각합니다. 배터리 제조과정의 경우, 화학적 특성이 주도한다고 생각합니다. 양극재 소성이나 전해질 주입, 활성화 공정 등에서 일어나는 화학적 반응은 ‘브라운 운동’처럼 불규칙하고 창발적으로 진행되는 경향이 있습니다. 반면 마스크를 통한 증착, 노광 및 식각 공정 등으로 진행되는 반도체 제조과정의 경우, 전자적 특성이 주도한다고 생각합니다. 즉, 반도체 공정은 훨씬 세밀한 공정을 요하지만, (배터리 제조공정에 비해) 통제가 용이하며, 불확실성이 적다고 생각합니다. 이러한 특성들을 고려할 때, 저는 Elon Musk는 배터리 보다는 반도체에 더 fit 하며, 따라서 만약 Terafab을 실제로 진행한다면, 건식 4680 프로젝트 보다는 시행착오를 덜 겪을 것이라고 생각하고 있습니다. 물리학에 기반한 제1원칙(First Principles) 사고방식을 가지고 있는 Elon Musk에게는 Random하고 Chaotic한 Chemical world 보다는 Control 가능한 Electronic world가 더 어울린다고 생각하기 때문입니다. 😉

从特斯拉出名的David,这么快就接商单了??? @CharlesXBoy

Terafab Project launches in 7 days

배터리 관련트윗 걍 하나로 묶음. 반도체가 극단적으로 좁은공간에 회로를 잘 우겨넣고 전자를 설계대로 잘 흘릴수있는가의 싸움이라면 빳떼리분야는 시간에 따른 싸이클충방전시의 계면부분의 거동이 문제가됨. 그걸 포함한 양품수율인거라... 자본이 속도를 올릴순있는데... 배터리쪽도 한계를 시험하긴 마찬가지... 동적으로 변화하는 환경에서 리튬 덴드라이트같은걸 어떻게 억제하는지 같은 구동단계에서의 동역학적인 안정성 문제(뭐가 인과관곈지도 모르는 확률문제)는 돈 더 넣고 갈아넣는다고 쉽게 해결되는 문제가 아니라봐서. 반도체쪽만 해온사람은 어캐볼지 모르겠는데 상대적으로 반도체뉴비인 내쪽에서 보면 반도체는 트레서빌리티가 비교적 용이하고 명확함. 근데 배터리는... 불량이 창발적임. 동적으로 불량이 발생하고 안하고 하는터라 모든 공정단계가 OK더라도 스태킹후 충방전테스트시 좆되는경우가 허다함. 원인? 필사적으로 있는데이터 없는데이터 긁어서 추측할뿐임. 스태킹시 압력분포, 미세한 농도편차, 충전속도, 접착방식 다 문제가 됨. 뭐가 원인인지도 모르고 전부 원인일수도 있음. 이런 나도 배터리 엔지니어는 아니었음 걍 장비쪽 시점서 골때리겠다 하고 본게 전부지. 이런 나도 줄줄 나오는데 ㄹㅇ 전문가입장서는 뭐가 더 있을지 상상이 안됨. 단편적인 이해일수있지만 반도체는 질서를 정교하게 쌓아가는 과정이고, 전고체 배터리는 내재된 무질서와의 싸움임. 특히 전고체계면부가 전기화학적 스트레스로 어떻게되는지 같은건 거의 확률론적 변수같은거라서 어떻게 이 카오스를 확률적으로 억제할지가 문제. 장님 코끼리 만지는 식으로...

BSPK(@BSPK_)님과 faultbugd(@faultbugs)님 등이 지속적으로 지적해주신 바와 같이, LLM이나 VLM 등의 모델로는 Physical AI 구현이 “불가능”하다고 생각합니다. 이유는 두 가지이며, 둘 다 Elon Musk님의 원 글에 언급되어 있습니다. 😉 1️⃣ 반응속도 문제 Physical AI는 실시간(에 가까운) 대응 가능성을 갖추어야 합니다. 예를 들어 자율주행 중인 차량 앞에 예상치 못했던 장애물이 등장한 상황을 가정해 봅시다. Hi 라는 인사에 대답하는데 5분 이상의 시간이 걸린 아래의 GPT-5.4 Pro처럼, 최종 답을 내리는데 몇 십 초에서 몇 분이 걸리는 모델로 대응이 가능할까요? Physical AI는 milliseconds의 영역입니다. 2️⃣ 칩 성능의 제약 무한(에 가까운) 에너지를 공급 받고 있고, 공간의 제약이 없는 "AI in Data Center"와 달리, Physical AI는 embedded system에서 구동되어야 하며, 에너지 자원과 공간의 제약으로 인해 컴퓨팅 파워는 제약될 수 밖에 없습니다. AI4 칩으로 LLM이나 VLM을 구동시키는 상황을 상상해보세요. 아예 구동이 불가능하거나, 엄청난 성능 저하를 경험할 것입니다. Openclaw 등을 통해 로컬 LLM을 구동해보신 분들은 이해하실 거라고 생각합니다.