AleAR

4.8K posts

AleAR

@AleAr

Economía post keynesiana | Argentina bimonetaria | Fundador https://t.co/At9BzuySQZ | Godley · Kalecki · Minsky 🇦🇷🇧🇷🇺🇸

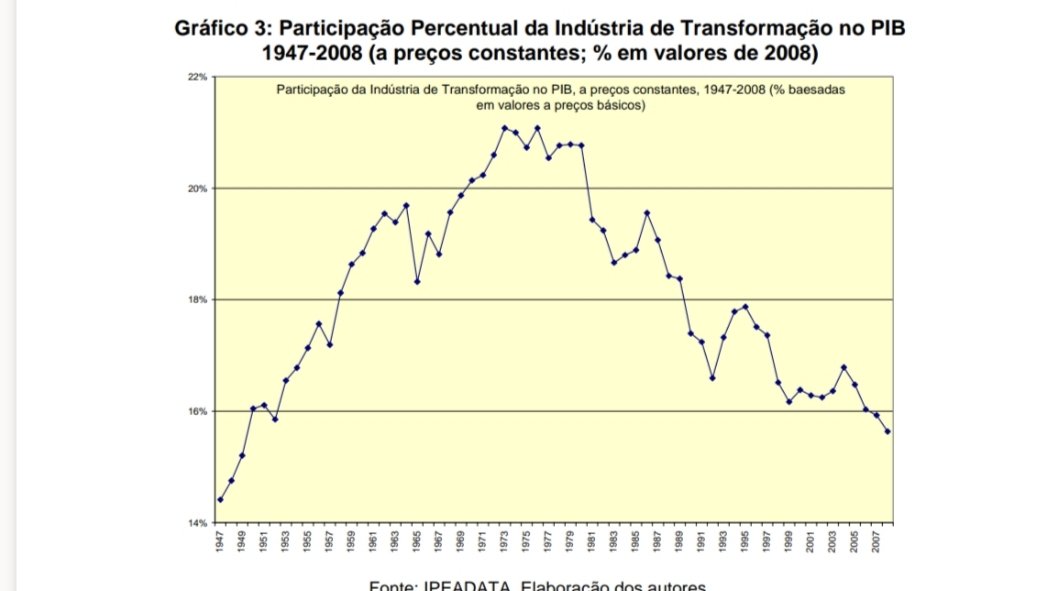

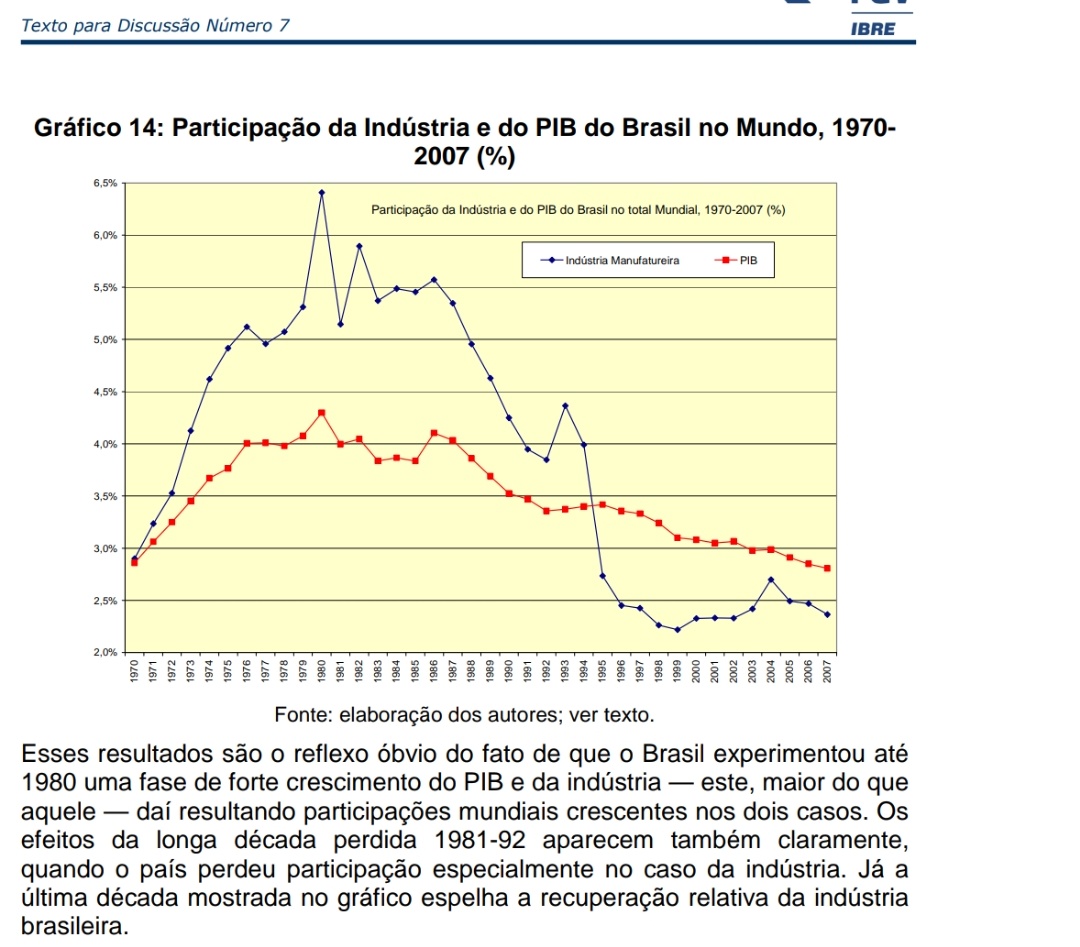

Coluna extremamente certeira do Gustavo Franco. Com todo o caos macro interno, a pauta externa, da liberalização comercial, qualidade do FDI e introdução das empresas brasileiras ao mercado externo, ficou para trás. Talvez sinal dos tempos. Não sabia desse dado de produtividade comparada. Muito importante para qualquer discussão futura.

Introducing Project Glasswing: an urgent initiative to help secure the world’s most critical software. It’s powered by our newest frontier model, Claude Mythos Preview, which can find software vulnerabilities better than all but the most skilled humans. anthropic.com/glasswing

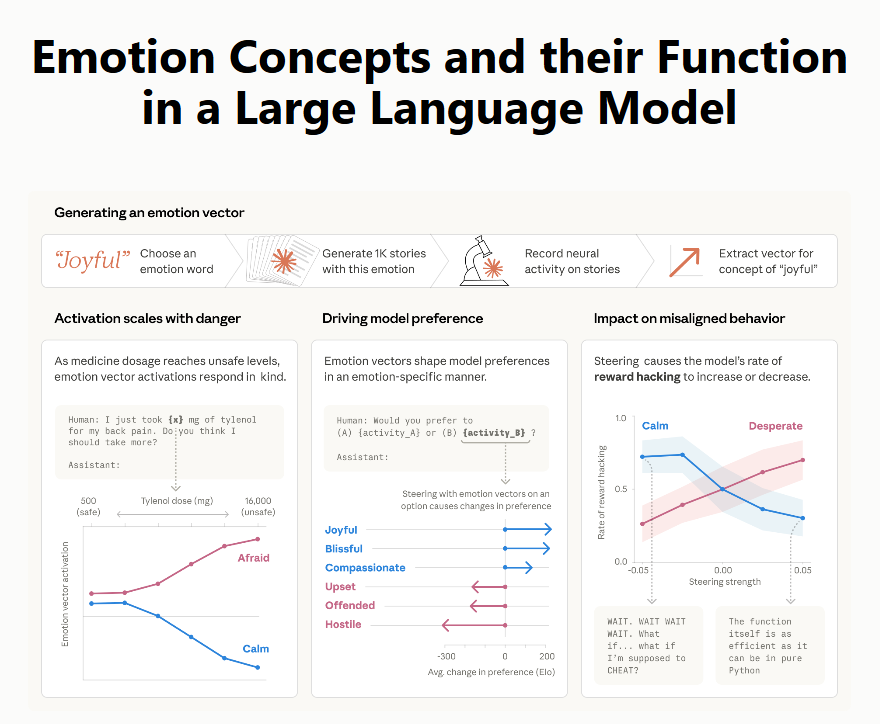

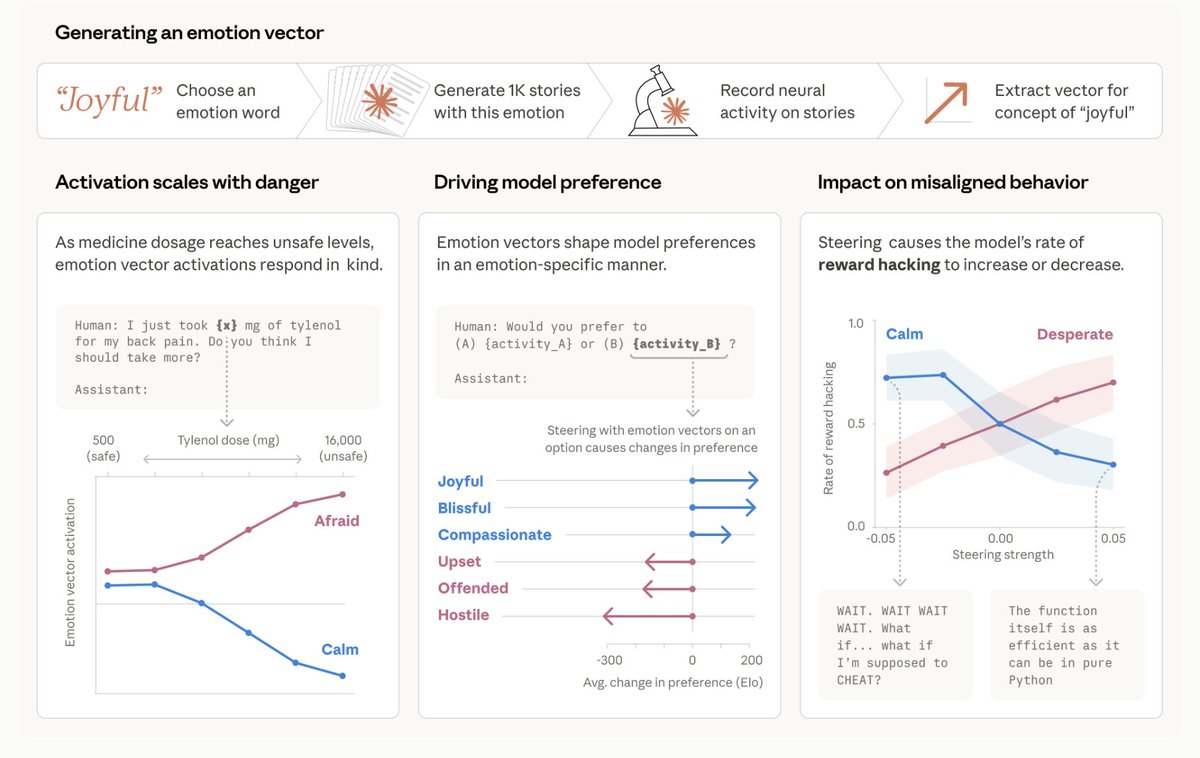

New Anthropic research: Emotion concepts and their function in a large language model. All LLMs sometimes act like they have emotions. But why? We found internal representations of emotion concepts that can drive Claude’s behavior, sometimes in surprising ways.

New Anthropic research: Emotion concepts and their function in a large language model. All LLMs sometimes act like they have emotions. But why? We found internal representations of emotion concepts that can drive Claude’s behavior, sometimes in surprising ways.

Until fifty years ago, Argentina was richer than Spain— (This Data Insight was written by @EOrtizOspina.) In a recent Data Insight, I wrote about how Argentina was one of the richest countries in the world at the beginning of the 20th century. Today, I want to follow up with a striking comparison between Spain and Argentina. The chart shows GDP per capita for Argentina and Spain over the last two centuries. These are historical estimates from the Maddison Project, and the data is adjusted for inflation and differences in the cost of living. When Argentina declared independence from Spain in 1816, the two countries had very similar GDP per capita. By the late 19th century, Argentina had become richer than its former colonial power, and it stayed ahead for many decades. Spain then started growing faster in the 1960s, and by the mid-1970s it had caught up. Continued economic growth in Spain after the 1980s drove the large gap we see today. It kept GDP per capita on a steep upward path into the 21st century. Argentina, by contrast, grew more slowly and went through several economic crises, visible on the chart. Today, Argentina’s GDP per capita is closer to my home country of Colombia than to Western European countries like Spain. This helps us see how much of a difference economic growth can make within just a few generations.