JK.Ryan

183 posts

分享下我的方法:

1. 🪜开了个paypal美区账户,绑定了国内信用卡,然后美区apple账号支付方式选择paypal,已经稳定用了几年了。

2. Android 手机上美区Google Pay,也是绑定国内信用卡。

这两种方式充值ChatGPT和Claude都很丝滑。

Mr Panda@PandaTalk8

如果你是iphone 手机, 可以用这个方法为 ChatGPT 充值, 我刚刚续费成功了。

中文

看到一个可以将文章直接转换成 PPT 演讲的工具,Paper2Video,一篇文章+一个头像+一段语音样本,它就能帮你生成一个生动的演讲解说视频。对于偏专业和学术性的场景,这个工具几乎能承担起人工完成的工作,做学术汇报和做课程的朋友有福了😄

仔细阅读了源码和论文,它的实现方式颇为精妙,整个 PPT 的渲染,主要基于 Beamer 这个声明式布局框架:

1)首先让大模型对内容做一次通篇的解说,并做好摘要分段,确保能够把核心知识表达清晰;

2)对于每页 PPT 的布局,通过视觉模型判断是否存在溢出、错位、拥挤等情况,如果存在类似的问题,就会让布局模块生成多套拼接方案,对图片和文字进行缩放后进行不同组合,再由视觉模型从中挑选出最优的一张;

3)过程中还添加了一个虚拟鼠标,方便捕获观众的注意力,也让整个呈现更具动态感与交互感;

4)口型采用的是 Hallo2,这是一种支持长时长、高分辨率、音频驱动的人像动画模型,能够让头像与语音同步地做口型/表情动画。

这个工具主要解决的还是论文汇报场景,不过有几个思路值得借鉴,包括如何将文章内容做拆解、如何做好 PPT 排版,如何做好口型等。

稍微改改,应该也能适配到更大众化的领域,例如做自动培训视频、技术方案的交互式解说,甚至产品手册的可视化呈现,把 Paper2Video 升级成 Doc2Video。

中文

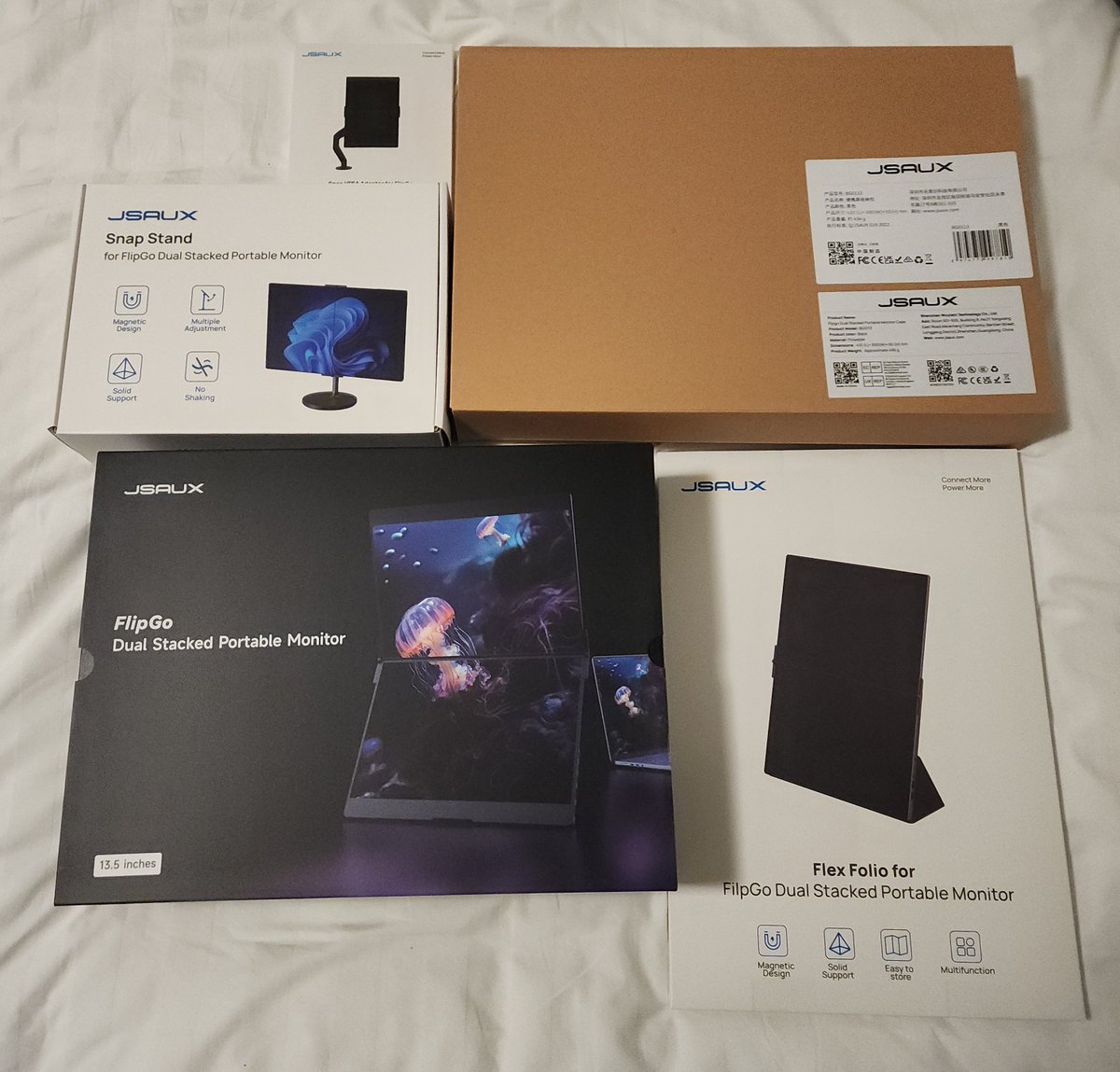

笑死,显示器就算轻20%,对真实体验帮助也不大,不如多一两个接口

居然sir@juransir

不同国家地区的人对于同一样事物的感知确实是不一样的。FlipGo 便携屏目前全球出货几千台,国内客户反馈重量太重的比例在一半以上,国外客户反馈重量太重的比例还不到 20%,并且目前国外的出货量是国内的十倍。

中文

Ridiculous to build a business upon @OpenAI when at anytime their automated systems may falsely deactivate your account, purge its data, continue to charge for the inaccessible subscription, with zero notice nor support nor contact:

community.openai.com/t/chatgpt-fals…

English

@SaveToNotion @SaveToNotion It seems down again. I couldn't save the tweet through the DM.

English

这句话是职场管理者们说的话,因为他们他们的行为被公司的财务报表绑架了,他们无时无刻都要算投入产出,这句话直接导致了KPI管理……这句话挺臭名昭著的(medium.com/centre-for-pub…)。如果你相信的这句话,你将永远无法得到成长……我觉得应该这么说:如果你没见过什么是好的,你将永远无法成长……

Tony Xu@t0nyxu

@haoel @madawei2699 @waylybaye @tinyfool 有人说 If you can’t measure it, you can’t improve it

中文

@thomaspaulmann @rusack It sound said... You could provide options for user to configure the API-Key and API-Endpoints

English

🪄 Introducing Raycast AI: The magic of AI, right on your Mac.

Write smarter, code faster and answer questions quicker with ChatGPT in Raycast – just one keystroke away.

Join the beta 👉 raycast.com/ai

English

GPT-4 用于训练的数据量据说在 5到9万亿 token 之间。假设是 9 万亿,这就等价于 45 terabyte. 普通一本英文书的数据量大约在 1 MB (一个英文字母相当于一个 byte), 所以 45 TB 相当于四千五百万本书。而美国国会图书馆收藏的书籍到2021年底不到四千万。另外一个参考数据,全世界每年出版的新书,大约两百万左右。

这也意味着,训练大语言模型的数据量,未来不太可能指数级别增加,而是会线性增加。大语言模型的发展,将主要体现在训练算法的进步,训练成本的大幅度下降这方面。

即使引入多模态的大语言模型,高质量的录像和图像数据量,总共大概 1000到 2000 TB 足矣。(Getty image 有两亿个图片,假设每张图片 2 MB, 这就是 400 TB. 假设 Netflix 有五千部高精度电影,每个电影的数据量是 3 GB, 总共就是 15 TB ) 猜测达到这个级别的训练数据量的 LLM, 五年内实现足矣,也许更快。

中文

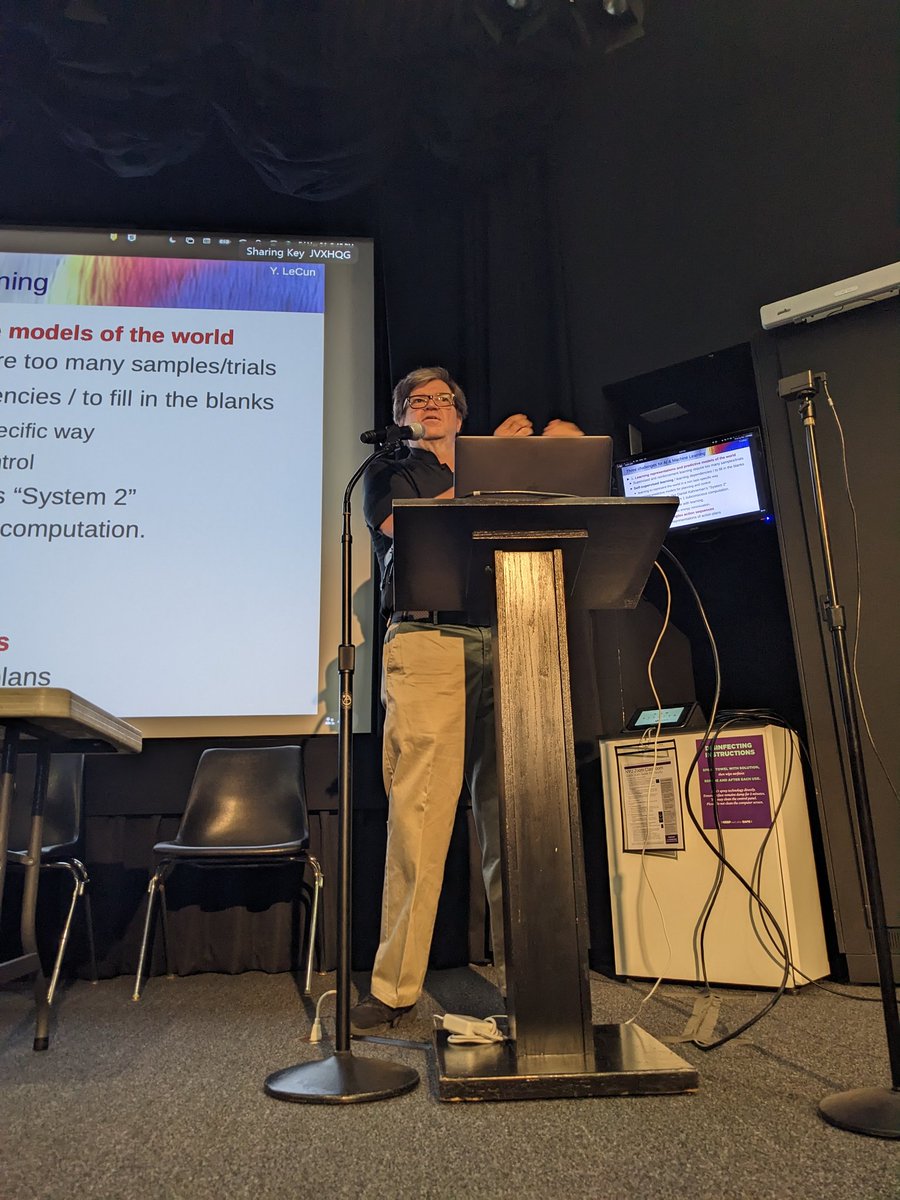

Yann LeCun kicking off the debate with a bold prediction: nobody in their right mind will use autoregressive models 5 years from now #phildeeplearning

English

@dominikhoma @SaveToNotion Is there any solution on it? I have meet the same issue

English

@SaveToNotion the link does not come, the message does not arrive because "/connect

Message failed to send

Delete for you

Try again"

English

We are experimenting a new way to grab Twitter conversations using Twitter Developer Labs. Please try it out by mentioning us at the beginning of any Twitter conversation with the keyword "grab this" like below!👇

twitter.com/haruno07/statu…

Amy at ThreadReaderApp@haruno07

@TwitterDev @pdfmakerapp grab this

English