Q²Ubik

1.5K posts

La IA también transforma el campo. Proyectos como Agro4Data optimizan el riego, ayudan a ahorrar agua y mejoran la producción con datos útiles para agricultores. Puedes unirte a un espacio de datos y pedir el Kit Espacios de Datos. 📅 Hasta el 31/03 cred.digital.gob.es/kit-de-espacio…

No number before 1,000 contains the letter A.

¿Cuál es tu primer pensamiento cuando ves este refrigerador?

This company claims a battery breakthrough. Now they need to prove it. trib.al/ZKNlTkY

Susana Sumelzo, Sª de Estado de Sánchez, no ha querido responder: ¿Por qué Montearagón SL, empresa de su familia, estaba domiciliada en el mismo piso que Servinabar? ¿Por qué Sumelzo SA está domiciliada donde Soluciones de Gestión? Casualidades de las empresas de la trama...🤔

📊 El número de viviendas turísticas registra su mayor caída de la serie histórica: 🔸Descenso interanual del 12,4%, el dato más alto desde que hay registros. 🔸Las viviendas comercializadas en plataformas se redujeron entre mayo y noviembre de 2025 en más de 52.000 unidades.

‼️Gabriel Rufián 🍋 llevará a cabo una 'gira' con líderes de la izquierda desde el próximo 18 de febrero, según adelanta @laSextaXplica Habría hablado con todo el espectro político a la izquierda del PSOE 🌹 para explorar una candidatura unitaria. 👇 electomania.es

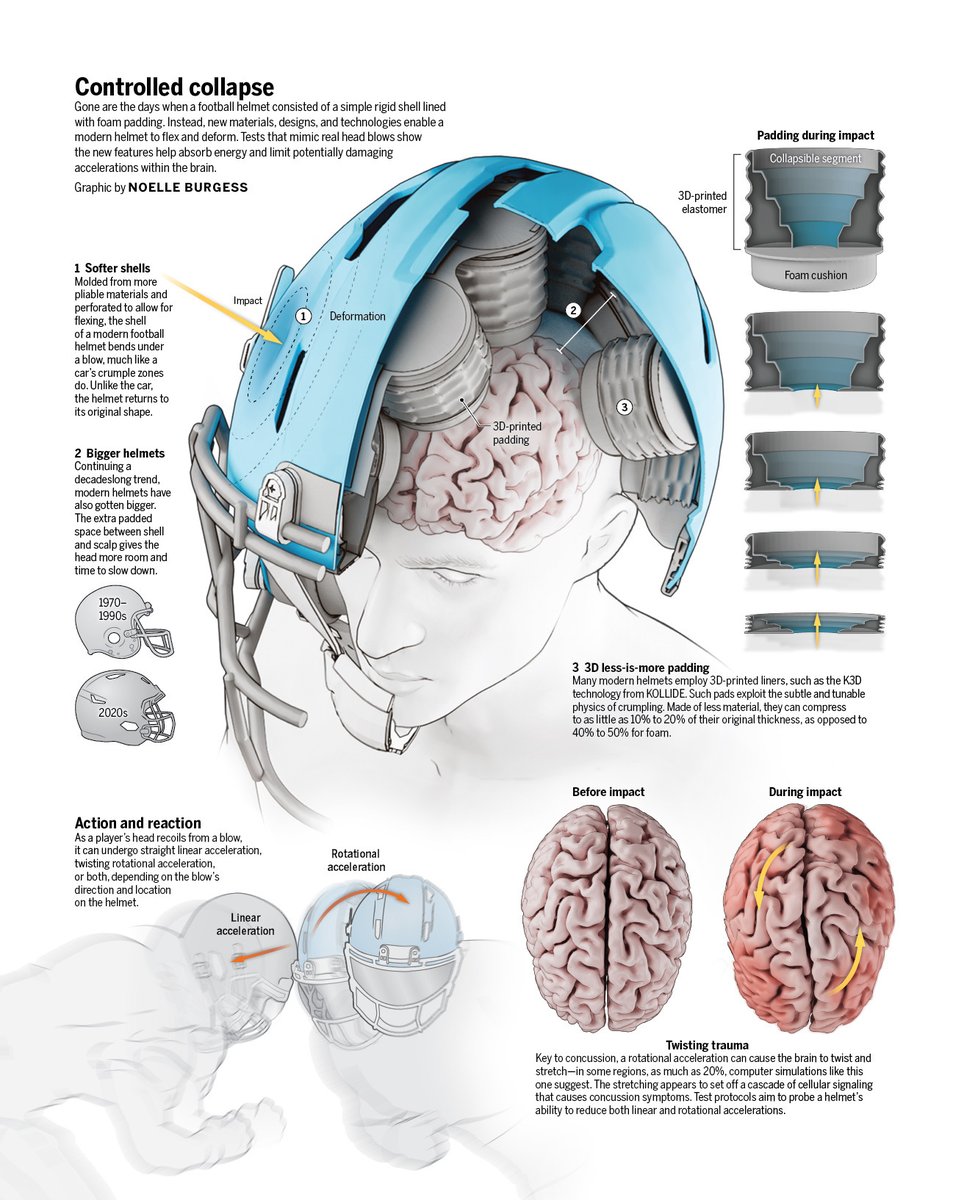

The evolution of the football helmet, a critical safety device, has accelerated in recent years, driven by concerns over the long-term effects of concussions, new concepts and materials, and data-driven test protocols. Learn more this week in Science: scim.ag/4tjrPoI