reeslo

4.7K posts

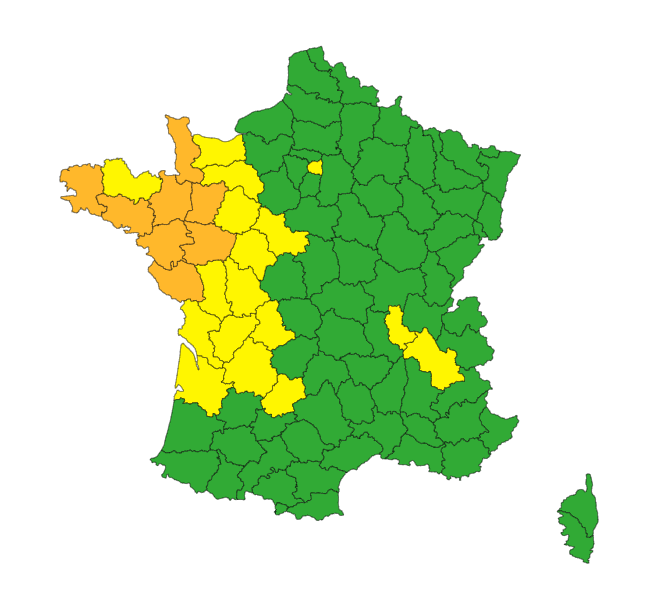

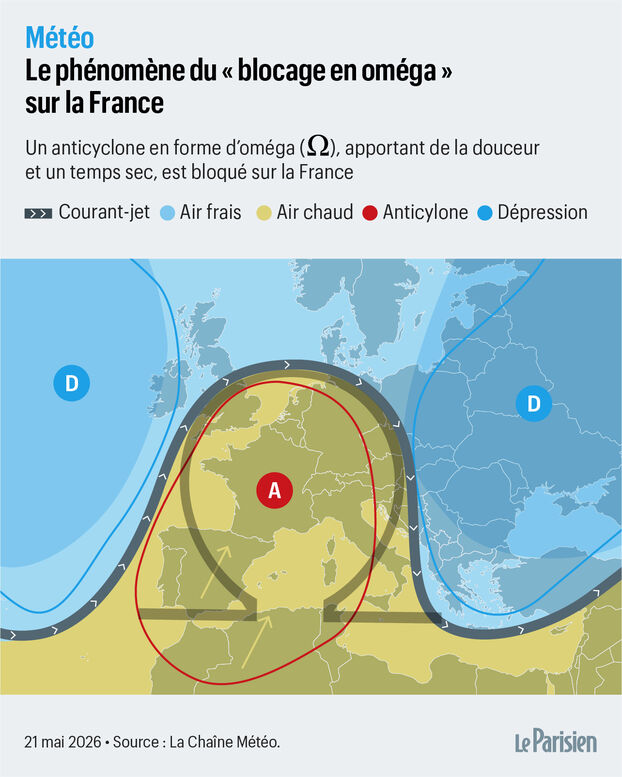

On va vivre quelque chose de difficilement concevable : à quelques degrés près, certaines régions de France frôlent des seuils de canicule*… en plein mois de mai. ➡️ Plus de 30°C attendus pendant une durée encore incertaine (au moins 10 jours ?). ➡️ Des pointes au-delà de 34°C dans le sud-ouest. Certains scénarios envisagent même localement 36°C en mai, mais je préfère rester prudent à ce stade. L’épisode de chaleur qui débute aujourd’hui est tellement hors normes pour le sud-ouest de la France que j’ai longtemps hésité à communiquer dessus avant d’avoir davantage de certitudes. Les modèles divergeaient encore récemment sur le positionnement exact d’une goutte froide, capable de modifier fortement l’intensité de la chaleur. Ce qui frappe surtout, c’est que de telles valeurs n’étaient parfois même pas atteintes au cœur de certains étés au siècle dernier. J’ai fouillé les archives pour retrouver des épisodes comparables (?) en mai : ➡️21 au 31 mai 1922 ➡️12 au 18 mai 1945 ➡️28 mai au 3 juin 1947 Je vais désormais travailler sur les impacts agricoles et écologiques potentiels dans les prochains jours. * Petit rappel important : la « canicule » correspond à des seuils sanitaires définis département par département. Une « vague de chaleur » répond, elle, à des critères nationaux précis. Dans certains départements du sud-ouest, nous nous rapprochons des seuils de canicule ; ce sont surtout les températures nocturnes qui manquent encore de quelques degrés. Le seuil de vague de chaleur nationale ne sera pas atteint (et heureusement, en mai !).

what’s the catch with SAM models from Meta that no one seems to be using them to build the obvious awesome products one could build on top of them? I don’t get it