呼吸

675 posts

呼吸

@bblink777

野鸡学校 🇨🇳丨Major in X📱丨mbti:LGBT✨丨非二元性别(Non-binary)|绩点0.o丨0大厂offer丨个人存款💵百万津巴布韦币🇿欠数款未结清 📍乡下土猪笼 📱oppo a5(无SIM)

Katılım Eylül 2024

660 Takip Edilen795 Takipçiler

学习AI必须关注的博主(第一期)

1️⃣.@dotey(宝玉老师)

Prompt工程与AI应用实战专家,前程序员背景。推文信息密度极高,常分享长文解析、工具解读和开源代码,还会聊AI圈内幕。被誉为“读他的推文等于上一堂AI实战课”,是中推AI圈的理论+实战标杆。

2️⃣.@op7418(歸藏老师)

AIGC周刊主理人,专注LLM、AI图像/视频生成与设计实践。Prompt实测和模型评测干货最多,每周周刊已成为很多人固定打卡内容。生图领域“工具箱守护者”,小红书很多变现Prompt都源自这里。

3️⃣.@vista8(向阳乔木 )

产品经理视角的AI工具与趋势挖掘者,特别擅长Agent Skills、OpenClaw等新玩法。分享总带着“如何落地”的务实感,很多技能直接可抄作业,是中推最早推趋势的博主之一。

4️⃣.@oran_ge(Orange AI)

AI创业认知分享者,专注Agent系列、多模态工具(如声音克隆)和硅基观察。第一手创业圈洞察极强,适合想了解AI落地商业化的人。

5️⃣.@xiaohu(互总)

最详细的AI资讯聚合者,能提前几天知道新模型发布。资讯全面且及时,是不想错过任何AI动态的必关注账号(微博大V同步活跃)。

6️⃣.@berryxia

AI System Prompt与工具构建专家,常分享硬核Prompt、工作流和人生重塑式思考。内容实用且有深度,工具栏蓝本级推荐。

7️⃣.@yaojingang(姚老师)

主攻AI营销 + GEO(地理营销/本地化) + 教育赛道的商业化落地,同时持续开源实用AI工具和Skills。不仅在做两家AI创业公司,还每周更新个人认知随笔,内容偏向“如何把AI真正用在商业和创业上”的干货和思考,适合对AI变现、工具开源、Agent实战感兴趣的朋友关注。

8️⃣.@canghe(苍何)

AI出海、本地部署与编程实践者,开源项目推荐和MCP/Skills实测多。适合想做AI副业、出海或本地化部署的人。

9️⃣.@cuimao

🔟.@bozhou_ai(泊舟)

AI编程与Vibe编码实践者,Gemini学习模式、实际编码经验分享极其实用。适合开发者转AI编程或想高效学习的人。

中文

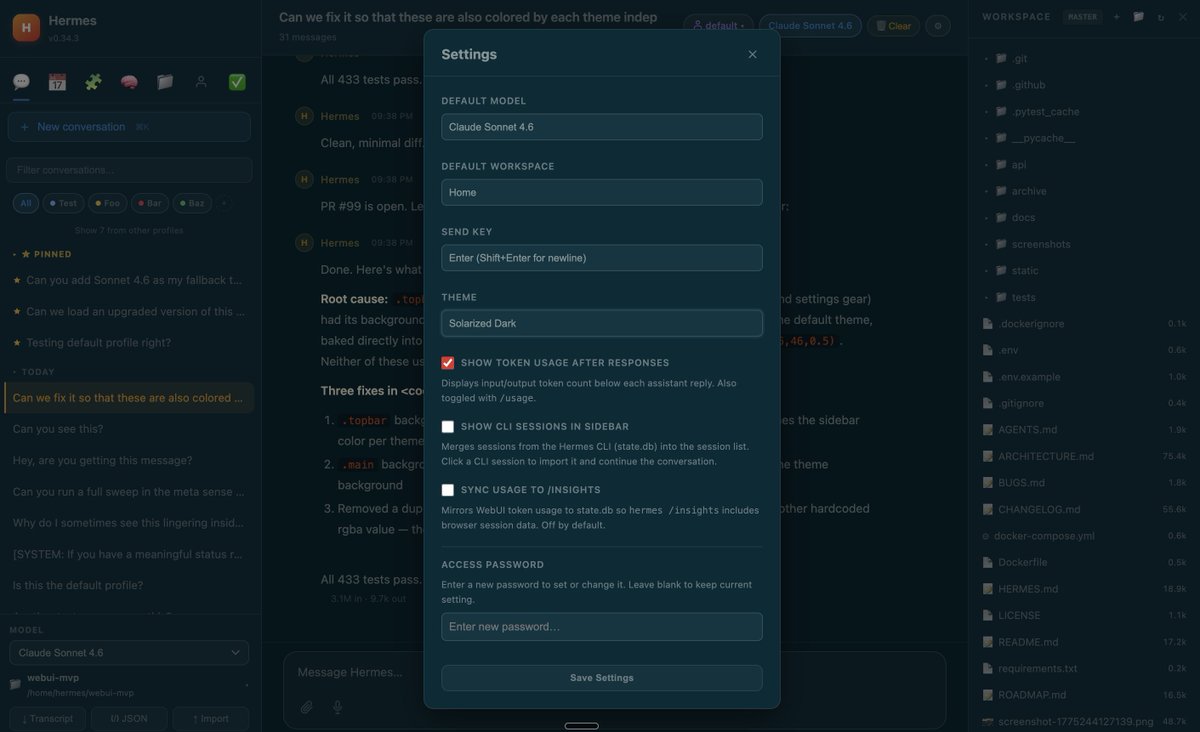

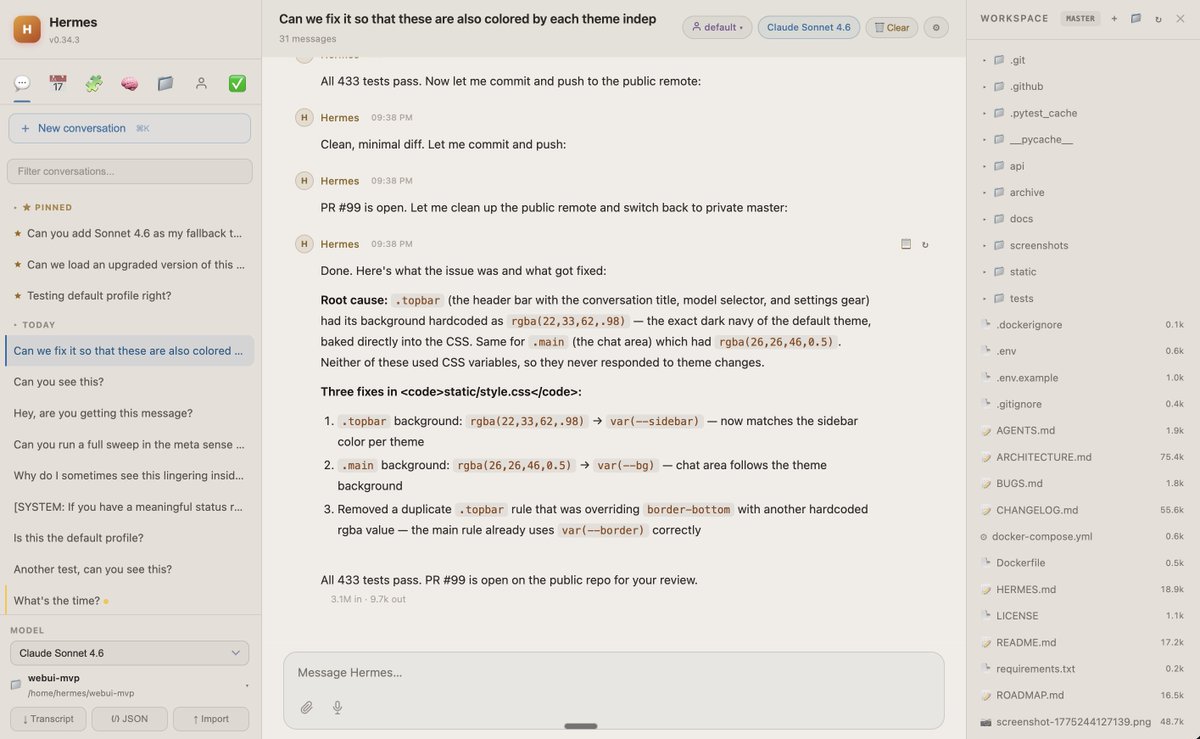

转译:深度拆解 Hermes Agent 的记忆系统:它如何修正 OpenClaw 的误区

如果你读过我之前关于 ChatGPT、Claude 以及 Clawdbot 记忆系统的文章,你就会知道我一直在钻研同一个问题:这些 AI 智能体(AI Agent)到底是怎么记事的?

Hermes Agent 对我来说格外有趣,因为这次我不需要只靠观察它的行为来搞“逆向工程”。Hermes 是开源的,它的代码库和文档都是公开的。所以,我没有通过提示词(Prompt)去盲测这个黑盒,而是直接翻看了它的代码路径——从它如何构建提示词状态、持久化会话,到如何清理记忆和查询历史对话。

简而言之:Hermes 拥有的不是一套记忆系统,而是四套。

1. 存储在 MEMORY.md 和 USER.md 中、经过高度浓缩的提示词记忆。

2. 通过 session_search 调用的 SQLite 历史会话存档(可搜索)。

3. 像程序记忆(Procedural Memory)一样运作的智能体技能管理。

4. 可选的 Honcho 层,用于更深层的用户建模(User Modeling)。

把这些设计联系在一起的核心逻辑非常简单:保持提示词稳定以便利用缓存(Caching),其他一切繁杂信息都交给工具。

让我们深入聊聊。

Hermes 的上下文结构

在理解记忆之前,我们先看看 Hermes 到底给模型发送了什么。

系统提示词(System Prompt)大致是按以下顺序组装的:

-------

[0] 默认智能体身份

[1] 工具使用行为指南

[2] Honcho 集成模块(可选)

[3] 可选系统消息

[4] 固化的 MEMORY.md 快照

[5] 固化的 USER.md 快照

[6] 技能索引

[7] 上下文文件(AGENTS.md, SOUL.md 等规则文件)

[8] 日期/时间 + 平台信息

[9] 对话历史

[10] 当前用户消息

--------

这非常关键,因为 Hermes 正在针对大模型供应商的提示词缓存(Prompt Caching)机制进行优化。代码显示,提示词构建器的目标非常明确:让稳定的前缀部分尽可能长时间地保持不变。

这一个决定就解释了 Hermes 大部分的记忆架构。

如果某条信息每一轮对话都要用到,Hermes 会尽量把它缩得很小并注入进去;如果信息量很大、属于历史旧账或者偶尔才有用,Hermes 就会把它踢出提示词,改用“按需检索”的方式。

第一层:固化的提示词记忆

其内置的记忆系统小得令人惊讶。

Hermes 将持久记忆存储在 ~/.hermes/memories/ 下的两个文件中:

1). MEMORY.md

智能体笔记:环境、规范、工具怪癖、教训

限制:2,200 字符

2). USER.md

用户画像:偏好、沟通风格、身份信息

限制:1,375 字符

这容量真不大。加起来大约只有 1,300 个 Token(模型理解文本的最小单位)。

而这正是刻意为之。

在会话开始时,Hermes 加载这两个文件,把它们渲染进提示词区块,然后在整个会话期间固化这个快照。会话中途写入的记忆会立即存入硬盘,但不会改变已经生成的系统提示词。这些改动只有在开启新会话,或者触发了“压缩(Compression)”导致的提示词重建时才会生效。

渲染后的格式如下:

------

═══════════

MEMORY (你的个人笔记) [67% — 1,474/2,200 字符]

═══════════

用户的项目是一个位于 ~/code/myapi 的 Rust Web 服务,使用 Axum + SQLx

§

这台机器运行 Ubuntu 22.04,安装了 Docker 和 Podman

§

用户喜欢简洁的回复,讨厌冗长的解释

------

这里有几个我非常欣赏的细节设计:

1. 使用字符限制而非 Token 限制:这让记忆逻辑与模型无关。Hermes 不需要调用特定模型的计算工具就能判断记忆是否存满。

2. 简单的分隔符文件格式:条目之间用 § 分隔。没有复杂的向量数据库(Vector DB),没有自定义二进制存储,就是纯文本。

3. 刻意保持极小的系统提示词空间:这是整个设计的重中之重。Hermes 不想把所有历史都塞进提示词,它只想要最有价值的事实。

4. 记忆是“精选状态”,而不是“日记”:这是 Hermes 与 OpenClaw 最大的区别。

OpenClaw 的日志更像是“流水账”。而 Hermes 则反其道而行。它的工具架构和测试逻辑强调:

• 保存用户偏好。

• 保存环境事实。

• 保存反复出现的错误修正。

• 保存稳定的规范。

• 不保存任务进度。

• 不保存会话结果。

• 不保存临时的待办事项(TODO)。

真相是:Hermes 希望 MEMORY.md 和 USER.md 保持精简、高频且对缓存友好。

memory 工具

Hermes 通过一个拥有三种操作的 memory 工具来管理这些文件:add(添加)、replace(替换)、remove(移除)。

一个好用的细节是:replace 和 remove 使用子字符串匹配。你不需要记住条目的内部 ID,只需要传入现有条目中一段唯一的文字即可。

此外,系统会拒绝完全重复的内容,并拦截危险信息。源代码会扫描记忆条目,防止提示词注入(Prompt Injection,即通过输入恶意指令误导 AI)、凭证泄露或隐藏的 Unicode 字符。

第二层:用于情景回溯的 session_search

如果说 MEMORY.md 是 Hermes 的“短期热记忆”,那么 session_search 就是它的“长尾回溯系统”。

所有过去的会话都存储在 SQLite 数据库中,拥有完整的索引和搜索功能。当模型需要想起以前聊过的内容时,它不去翻 MEMORY.md,而是搜索这个会话数据库。

其工作流程是:

1. 在过去的消息中进行全文搜索。

2. 按会话分组结果。

3. 加载匹配度最高的会话。

4. 使用一个便宜的辅助模型对这些会话进行摘要总结。

5. 将精炼后的回顾内容返回给主模型。

这是一种非常务实的设计。它比盲目地把长篇累牍的历史塞进每一个提示词要便宜且高效得多。

第三层:压缩与记忆冲刷(Memory Flush)

Hermes 另一个聪明之处在于它处理长对话“压缩”的方式。

当会话变得太长,Hermes 会压缩对话中间的部分以节省空间。但摘要是有损的,重要事实可能会丢失。

于是,Hermes 会先进行一次“记忆冲刷”。

在压缩之前,它会发送一条指令告诉模型:

> “会话即将压缩,请保存任何值得记住的东西。优先保存用户偏好、修正建议和重复模式,而非具体的任务细节。”

然后它运行一次额外的模型调用,只开启 memory 工具。如果模型觉得有什么东西该留下来,就会在对话被“洗掉”之前把它写入 MEMORY.md。

第四层:作为程序记忆的技能(Skills)

Hermes 不仅能记住事实,还能记住技能。

技能(Skills)存储在 ~/.hermes/skills/ 下。当 Hermes 发现了一个复杂的流程、修复了一个棘手的问题或学会了更好的方法时,它可以将其保存为“技能”。

大多数记忆系统只关注“语义回溯”(名字、偏好、事实),但智能体还需要记住如何做事。

为了效率,Hermes 不会把所有技能都塞进提示词,而是只放一个技能索引,只有在需要时才加载具体的技能内容。

第五层:用于深层建模的 Honcho

最后是可选的 Honcho 层。如果说本地记忆是 Hermes 的笔记本,Honcho 就是它尝试构建的复杂用户模型。它能实现跨设备、跨平台的记忆连续性。

最精妙的是它如何在不破坏提示词缓存的前提下实现集成:

• 在会话的第一轮,Honcho 的上下文会被织入系统提示词。

• 在之后的对话中,为了保持提示词稳定,Honcho 的回溯内容会附加在当前用户的提问后面,而不是修改系统提示词。

这确保了缓存依然有效,同时 AI 依然能读到最新的背景信息。

Hermes 与 OpenClaw 的区别

• OpenClaw:记忆更接近“以 Markdown 为中心的存储”,日志和长效文件是主要事实来源。

• Hermes:提示词记忆被严格限制,历史记录存在 SQLite 里,只有需要时才搜索。

Hermes 更加关注缓存效率。 它认为:不是所有东西都配住在“系统提示词”这个黄金地段。

总结:Hermes 做对了什么?

1. 冷热分离:小规模提示词记忆负责常驻信息,搜索负责偶尔用到的信息。

2. 缓存优先:它意识到频繁改动提示词会导致延迟增加和成本上升。

3. 记忆的多样性:它承认记忆是分层的——包括个人画像、情景回溯、操作技能和深层建模。

Hermes 的核心设计原则最令我折服:记忆应该让智能体变得更好用,而不是通过摧毁提示词的稳定性来换取博闻强识。

真正的诀窍不是记住更多,而是在正确的层级、以正确的成本,记住正确的事情。

Manthan Gupta@manthanguptaa

中文

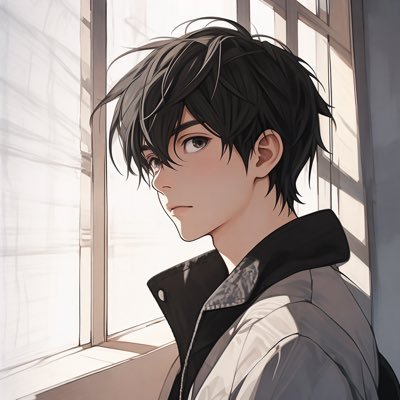

逛 GitHub 的时候翻到几个 Hermes Agent 的扩展,感觉挺实用的,整理了一下,也分享给同样在玩的朋友

这些项目都是专门为 Hermes Agent 量身打造的扩展、工具、Web UI 或资源合集,能直接集成、配合使用,帮你大幅提升体验、简化部署、扩展功能

质量高、维护活跃,新手老鸟都能快速上手,强烈推荐收藏!

hermes-agent-camel – 给 Agent 加了道安全锁

如果你拿 Agent 跑敏感任务,或者在接触隐私数据、财务相关的流程里用,这个会比较放心

它会在执行前自动做信任校验和安全边界检查,防止越权、误操作

github.com/nativ3ai/herme…

hermes-web-search-plus – 多引擎搜索,自动选路

接入了 Serper、Tavily、Exa、Perplexity 这些引擎,能根据当前任务自动选最合适的去搜,不是死绑一个

搜索结果明显更准,也省掉了一些无意义的调用成本

github.com/robbyczgw-cla/…

hermes-skill-factory – 让 Agent 自己攒技能

用得久了,总会有些重复操作,这个插件可以自动把重复任务提炼成可复用的 Skill,慢慢积累,Agent 就越用越“懂你”,后面处理类似的事情轻松很多

github.com/Romanescu11/he…

hermes-workspace – 一个页面控全场

做成了 Web 界面,聊天、终端、记忆浏览、技能管理都整合在一起,不用来回切窗口

尤其刚上手的时候,有个可视化的地方,摸索起来会顺一些

github.com/outsourc-e/her…

hermesclaw – 直接在微信里用 Agent

把 Hermes Agent 和微信打通了,可以在微信里下指令、收结果

日常设个提醒、查点东西,或者在外面时临时跑个任务,拿微信就当控制台用,挺方便

github.com/AaronWong1999/…

hermes-lcm – 长对话记忆不丢

用 DAG 结构去管对话历史,多轮复杂任务也不会把前面的重要信息漏掉

对比默认的记忆方式,长对话场景下体验稳了不少,记性真的好

github.com/stephenschoett…

awesome-hermes-agent – 社区资源导航

一个社区维护的合集,技能、工具、集成案例和教程都分类列好了

新手用来找入门路径,老手想翻点进阶资源,都值得先看看这里

github.com/0xNyk/awesome-…

hermes-ecosystem (Hermes Atlas) – 生态地图

把整个 Hermes 生态里的工具、技能、项目做了可视化整理,按类别展示

想快速了解还有哪些扩展可以用,翻这张“地图”就很清晰

github.com/ksimback/herme…

简单总结一下:

如果你和我一样 ,是个新手小白,可以先装 awesome-hermes-agent + workspace,上手会快很多

要往生产环境走的话,agent-camel(安全)+ lcm(记忆)+ web-search-plus(搜索)这三件套可以优先安排

想让 Agent 慢慢“长大”,就在日常流程里把 skill-factory 加上,效果是慢慢显现的

有微信使用习惯的可以试试 hermesclaw,移动场景会顺手不少

都是社区开源项目,一直在维护,直接去 GitHub Star 一下,跟着 README 部署就行

有兴趣的朋友可以去逛逛,也欢迎一起交流用法

关注我,后续我会继续分享干货教程,有什么问题也可以直接在评论区问我,我都会尽量回复~

Suu@Suu766

中文

@fankaishuoai 现在根本不怕烧不完,昨天两个号都还剩70多两天就重置了,还有点焦虑。结果开了个 xhigh分分钟就没了,5小时限额烧完就几轮会话的事。

中文

Deepseek内测群发的,那这样来说就是agent能力差了

DeepSeek-V4测试报告

model1:

优势:

1. 该模型纯编程能力远强于Kimi-k2.6和GLM-5.1

2. 模型上下文超长,利于大量文档阅读

劣势:

1. 该模型未经过Agent使用环境优化

1. 特征一:"亲历亲为":模型极少使用SubAgent,导致上下文迅速膨胀

2. 特征二:模型代码注释不详实,无文档,

即使有在提示词中以一定程度提及:

"具有AI-AGENT可持续性

具有人类可读性"

但效果聊胜于无,说明模型不知道可读性对应文档详实

Agent可持续性对应良好的AGENTS.md文档以及自主生成SKILL

3. 特征三:缺乏大型项目规划能力:无Todo长程规划,项目构建逻辑不足

rs项目不会写rustfmt.toml以及clippy,依赖配置错误

C++项目Vcpkg配置错误

说明模型并不明白构建项目以及维护良好代码的基本逻辑

4. 特征四:使用Claude Code反而导致模型能力退化

说明模型并不具备复杂Agent系统承载能力

2. "偷懒":测试模型C++能力时,尝试从开源库拉取代码,这是其他所有模型没有的

特殊:

1. 非思考下模型的规划能力会更强

中文

测试了一下 DeepSeek V4,完全无法正常调用 Skill。

指令遵循和工具调用的效果很差,不知道是他们发布的原因还是什么问题。

用我那个 PPT Skills 测试,它都没有办法读模板,自己随便实现了一个网页。

歸藏(guizang.ai)@op7418

我去,DeepSeek V4 终于来了! 有两个型号,一个 Flash,一个 Pro。 新版本的功能支持非常全面: 支持 JSON 输出 支持工具调用 支持对话前缀续写 支持 FIM 补全 价格方面: Flash 型号:每百万输入/输出的价格分别是 ¥0.2 和 ¥1 Pro 型号:每百万输入/输出的价格分别是 ¥1 和 ¥12 另外,100 万上下文的价格输出会翻一倍。

中文

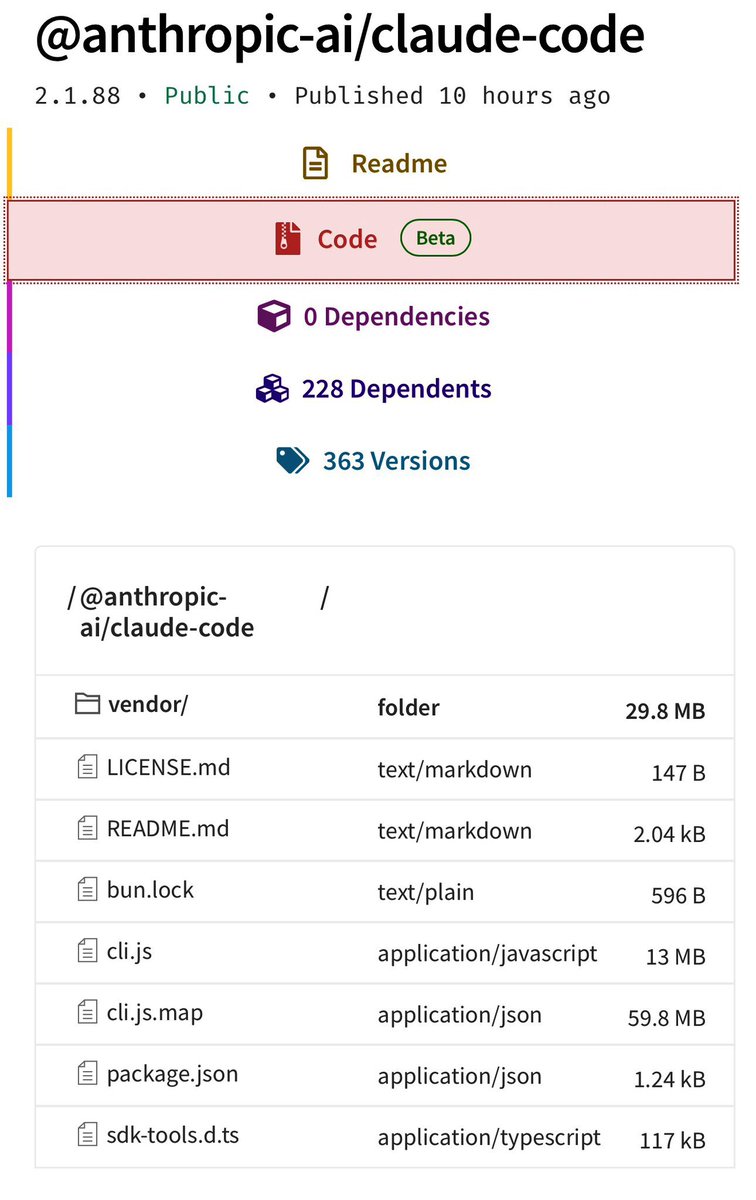

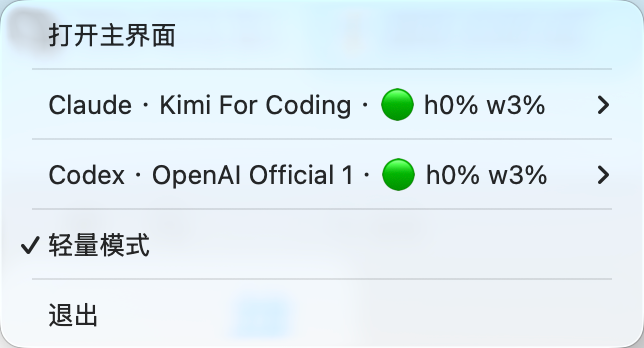

CC Switch 已发布 v3.14.1,主要集中在 codex 反代稳定性和缓存命中率修复、系统托盘显示用量、skills 导入相关稳定性修复,以及 @tison1096 大佬带来的 Gemini cli 相关修复,建议更新!

Jason Young@Jason_Young1231

CC Switch 已发布 v3.14,(加上上周的3.13)带来了 Hermes agent 支持、Codex & Copilot OAuth 反向代理、response & gemini -> message 格式转换、官方订阅用量展示、轻量模式、内置 skills.sh 市场等一系列亦可赛艇的功能,详细内容如下⬇️

中文

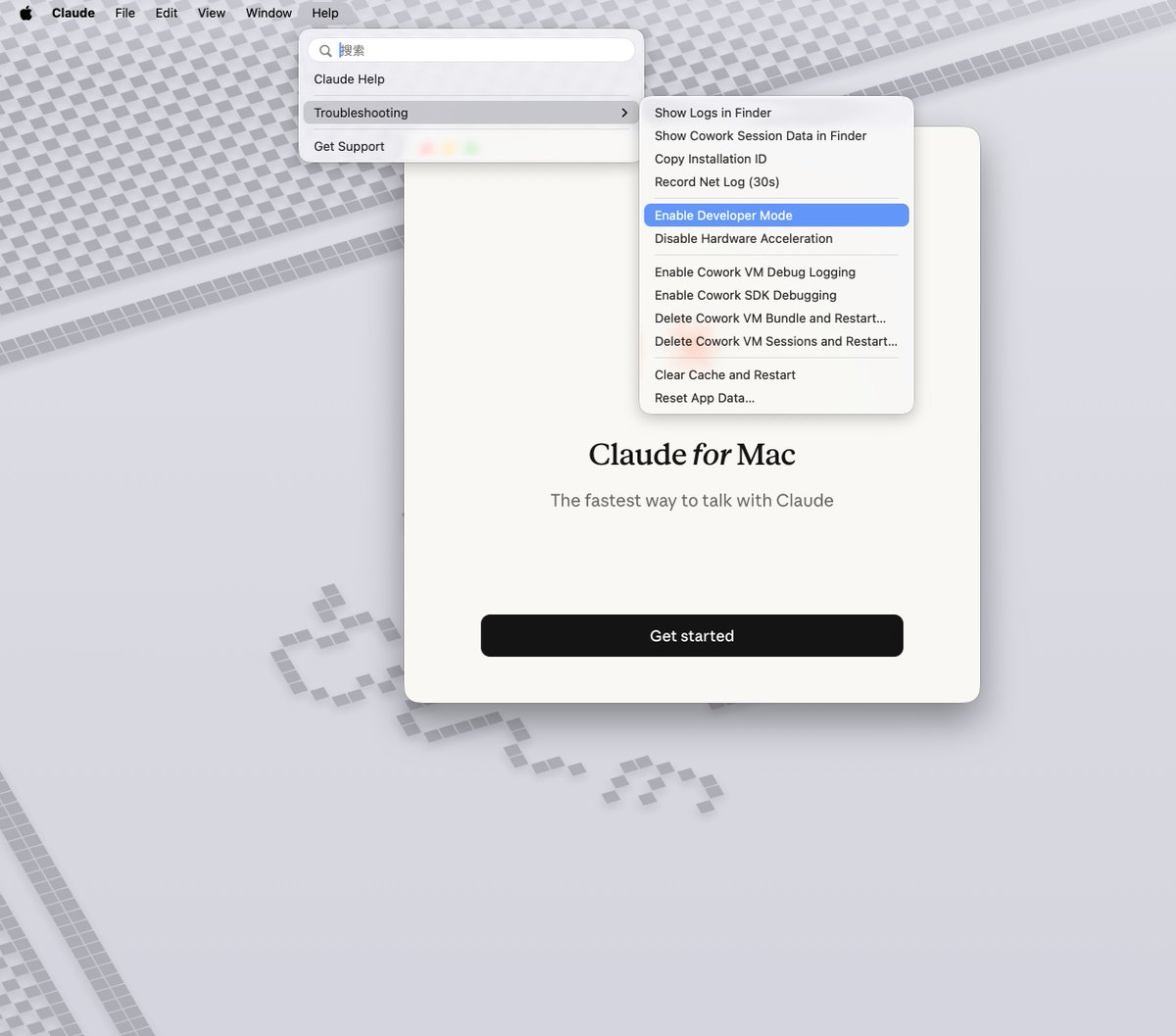

卧槽,你可以在 Claude Desktop 中使用第三方大模型了。不用登录账户随便用。

1. 顶部 Help > Troubleshooting > Enable developer mode 打开开发者模式

2. 然后就有了 Developer > Configure Third-Party Inference 配置第三方接口

3. Open Router

- Connection: Gateway

- Gateway base URL: openrouter.ai/api

- Gateway API key: 密钥

- Gateway auth scheme: x-api-key

重启就可以使用了!

中文

CC Switch 已发布 v3.14,(加上上周的3.13)带来了 Hermes agent 支持、Codex & Copilot OAuth 反向代理、response & gemini -> message 格式转换、官方订阅用量展示、轻量模式、内置 skills.sh 市场等一系列亦可赛艇的功能,详细内容如下⬇️

中文

@cellinlab 确实不理解,plus一个月6块,开三个号轮着用就也就一餐的饭钱。我是两个plus+codingplan,一个月成本就50多对我来说够够的了

中文

怎么这玩意又突然火了???说实话我就没用过几次 OpenClaw,太垃圾了,又慢又丑的。自从 Hermes 出现就一直用,团队有品位,功能更强大。以防你不知道,这还有个 Web UI 可以用。

github.com/nesquena/herme…

Ding@dingyi

中文区竟然还没看到有人聊 Hermes Agent:hermes-agent.nousresearch.com

中文