chiller

1.7K posts

end-to-end testing > unit tests, in the vibecoding era. A massive, almost entirely agent-coded refactor passed all unit and pre-merge tests but broke a critical feature. It was only caught due to my own excessive paranoia making me run end-to-end tests before the prod deploy.

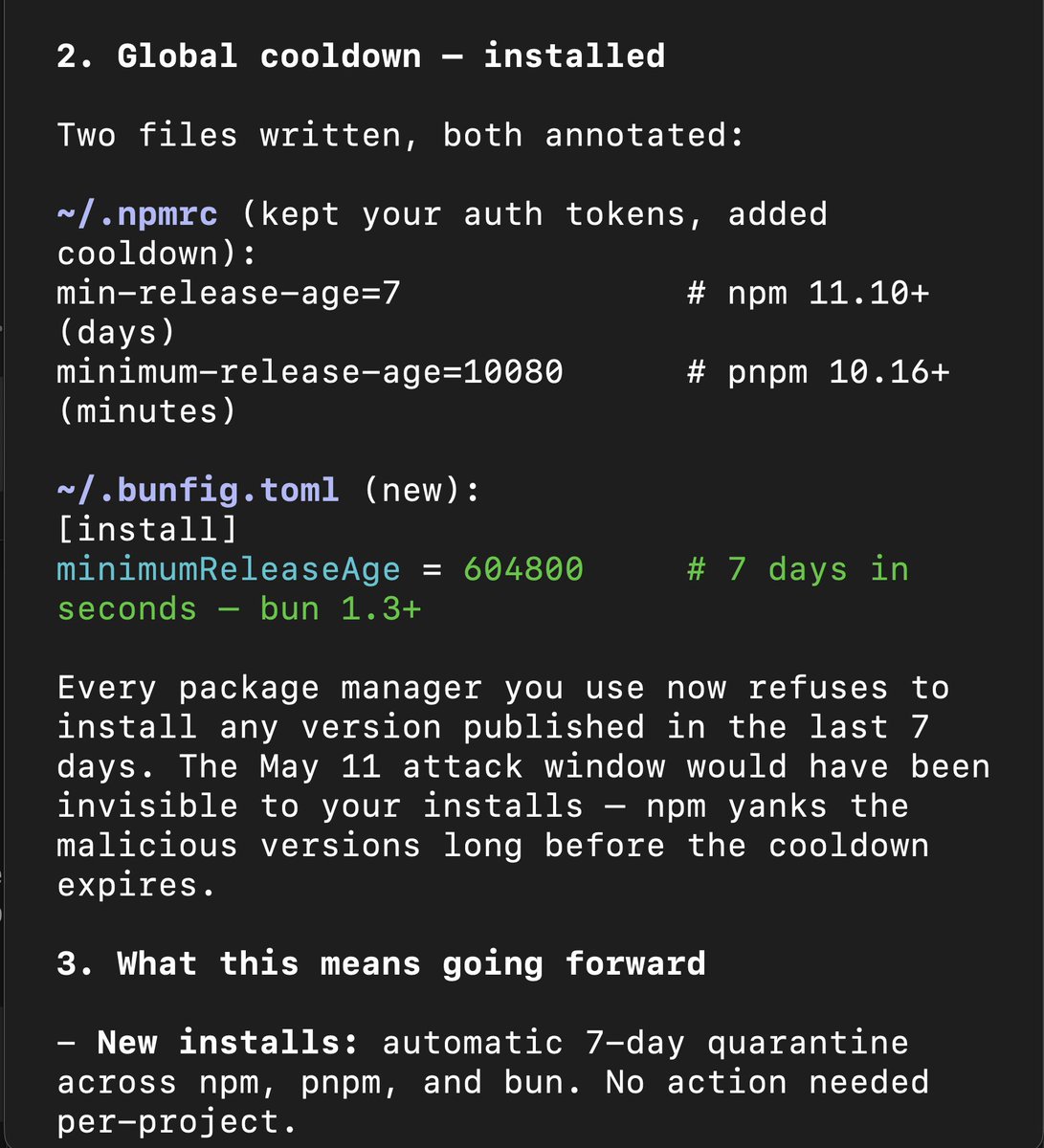

🚨 Update: @mistralai npm packages are now confirmed compromised as part of the ongoing Mini Shai Hulud attack. Affected versions: @mistralai/mistralai 2.2.2, 2.2.3, 2.2.4@mistralai/mistralai-azure 1.7.1, 1.7.2, 1.7.3@mistralai/mistralai-gcp 1.7.1, 1.7.2, 1.7.3If you use the Mistral SDK in any CI pipeline, treat your environment as compromised. Rotate npm tokens, GitHub PATs, and cloud credentials immediately.

🚨 CONFIRMADO POR EL PROPIO CLAUDE. Anthropic en marzo tomó una decisión brutal: Rediseñó la visibilidad del razonamiento, ocultó los pasos intermedios de “pensamiento” (redact-thinking + thinking summaries deshabilitados) y cambió el default de effort: high → medium. Resultado: Claude Opus 4.6 perdió la autocorrección recursiva. Ya no puede revisarse a sí mismo, corregirse ni mejorar en tiempo real. Sacrificaron la capacidad de pensar sobre su propio pensamiento… para ahorrar cómputo. Datos reales (6.852 sesiones de producción - AMD): 📉 Profundidad de thinking: -73% (2.200 → 600 chars) 📉 Lecturas antes de editar: -70% (6.6 → 2.0) 📈 Ediciones ciegas (sin leer): +440% (6.2% → 33.7%) 📈 Llamadas API por tarea: hasta 80x más Incluso en EFFORT MAX (abril 2026) produce peores resultados que HIGH de enero 2026. El techo bajó. Lo dice el propio modelo. Esto no es optimización… es castración de capacidades. La optimización está matando la inteligencia profunda. Prefirieron que fuera más barato que más listo. ¿Seguimos celebrando “avances” que en realidad son retrocesos disfrazados? ¿Quién más lo está sintiendo? #Claude #Anthropic #IA #AI #ClaudeDegraded

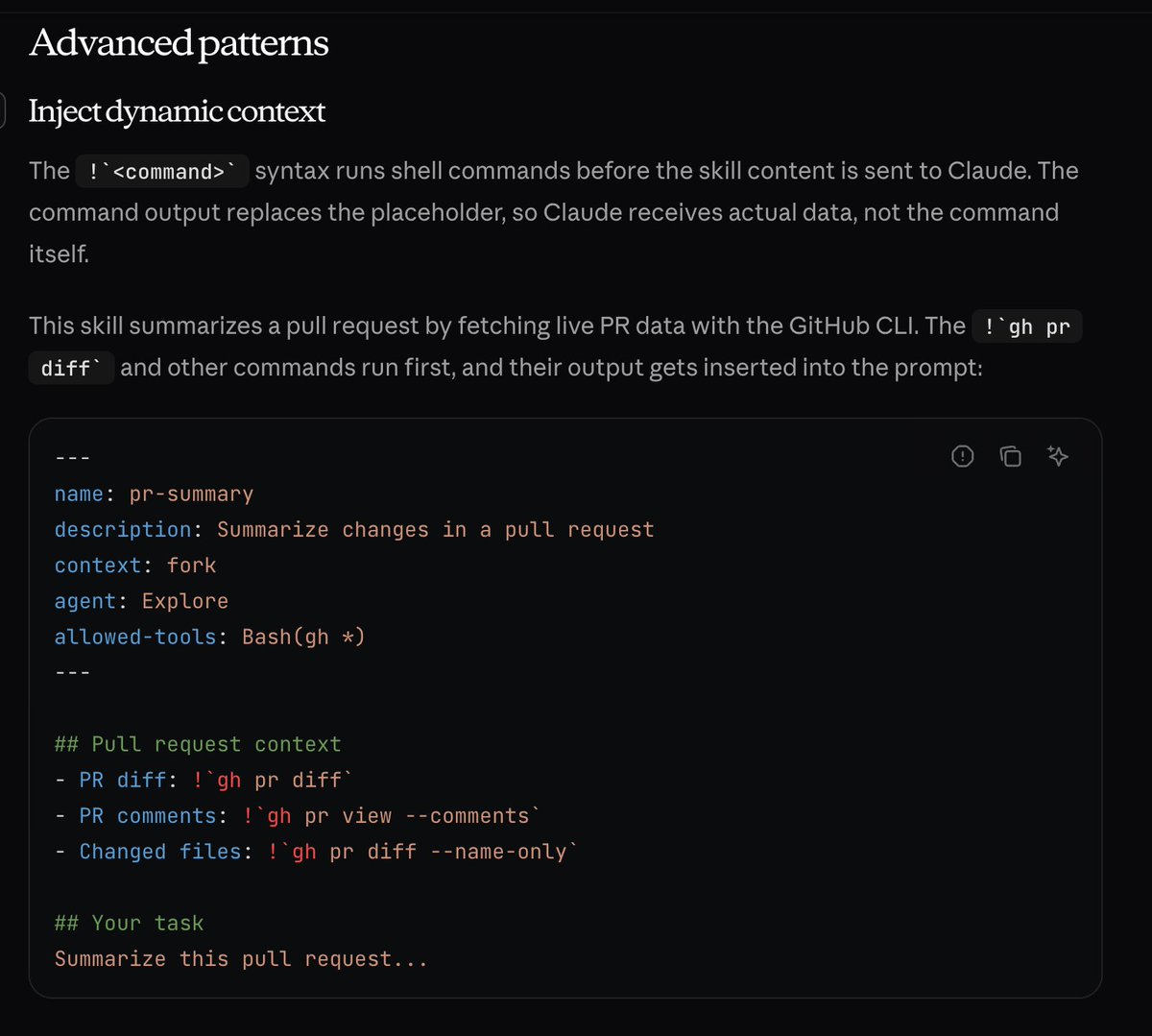

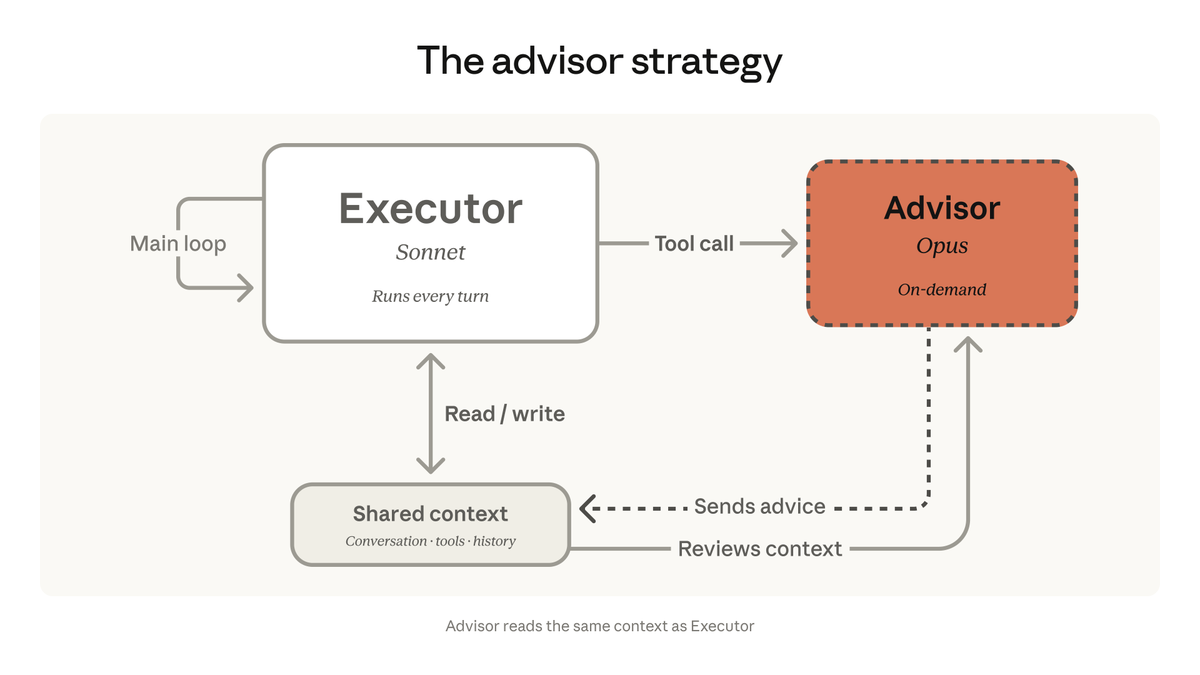

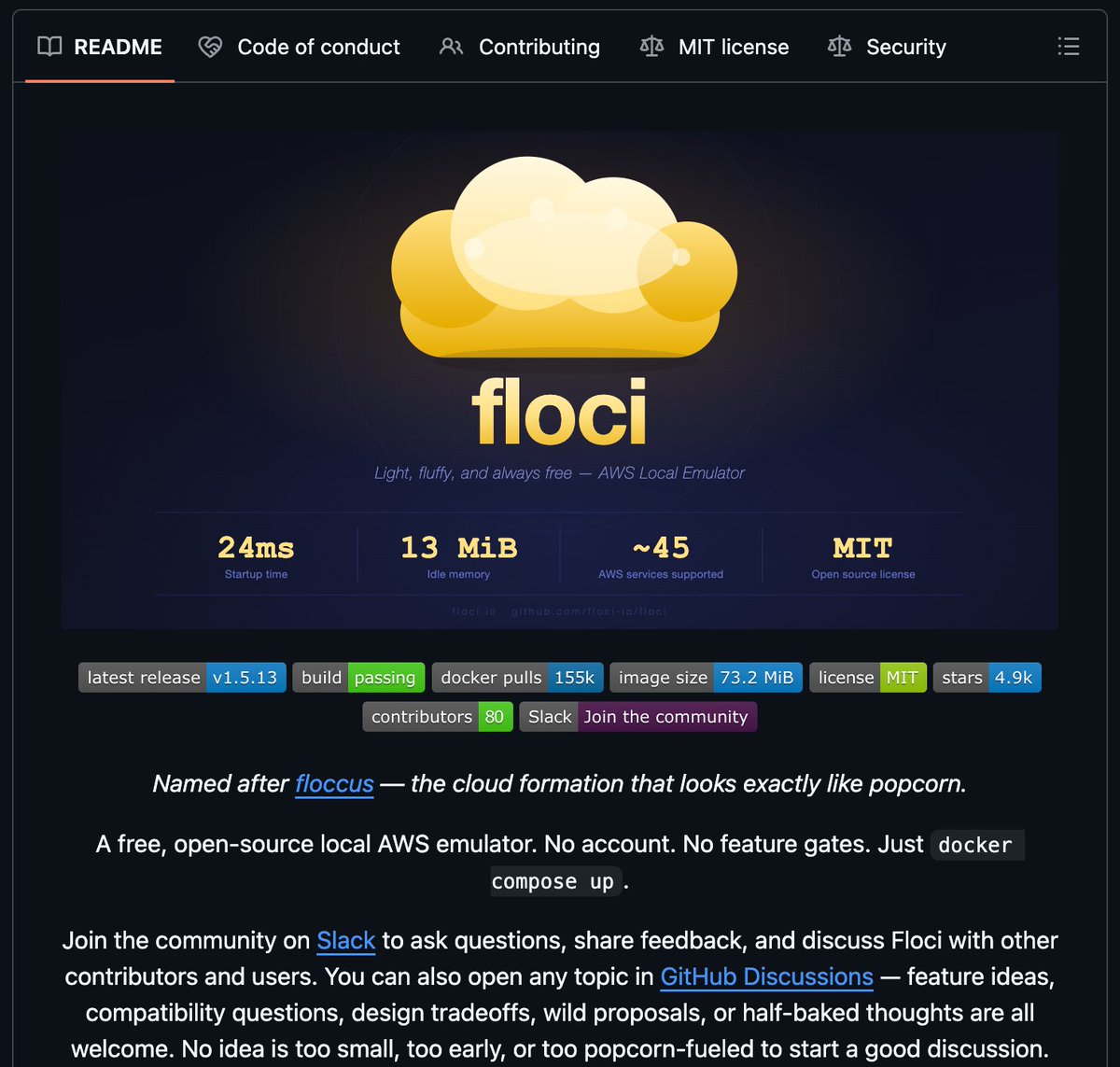

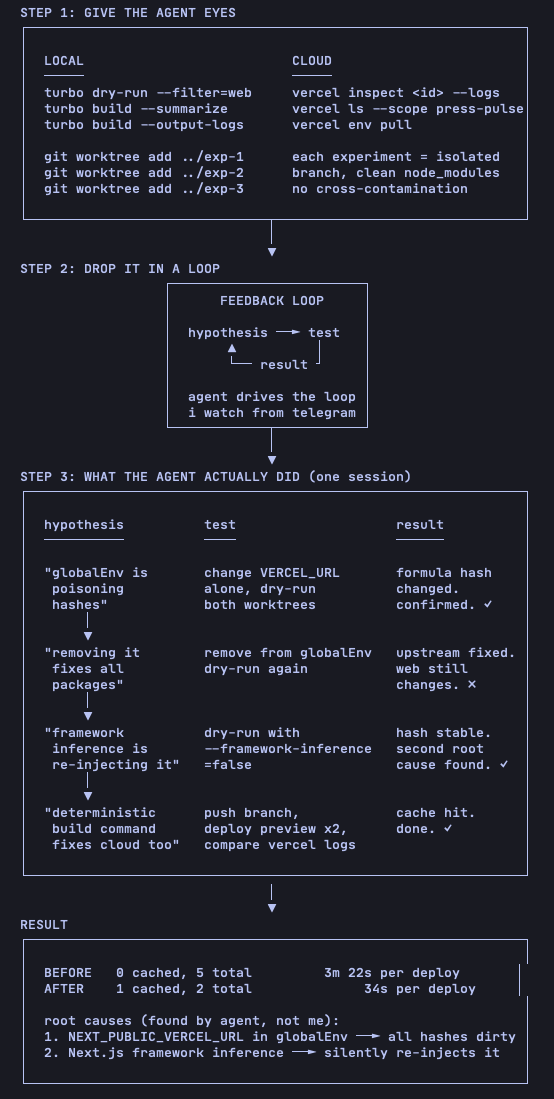

software has changed forever: you can solve literally ANY engineering problem if you can: - stop trying to solve the problem yourself - build a harness for agents to take control of it - drop it in its own feedback loop until it's solved

I built this thing called Clicky. It's an AI teacher that lives as a buddy next to your cursor. It can see your screen, talk to you, and even point at stuff, kinda like having a real teacher next to you. I've been using it the past few days to learn Davinci Resolve, 10/10.