95200.eth 📦 Dans ma zone

904 posts

95200.eth 📦 Dans ma zone

@crypto_blockg

$GME holder, solopreneur

New York, USA Katılım Temmuz 2017

226 Takip Edilen250 Takipçiler

@techskunkworks T’en as peut être parlé sur tes autres vidéos. En tout cas J’ai beaucoup appris sur la 1ere heure de ta vidéo. Je vais te suivre pour mieux comprendre la méthode et le comment du pourquoi. Encore bravo

Français

@techskunkworks Bravo mec, excellent contenu. Je suis convaincu que le local sera ou est déjà la next step dans notre moyen d’utiliser/consommer de l’ia.

Tu parles souvent d’une armée d’ia legere, est-ce qu’on pourrait pas appliquer à un bon gros LLM bien capable ?

Français

On est combien dans le monde a se fabriquer son propre LLM ?

À voir le nombre de téléchargements sur des DataSets et l'utilisation de certains scripts, ça ne dépasse pas quelques centaines d'individus.

Le reste de l'humanité loue l'intelligence d'un autre sans en avoir rien à foutre.

Ce soir je déroule l'intégralité du worflow pour construire son propre LLM

RDV 21:00 en LiVE

youtube.com/live/pRQclTySY…

YouTube

Français

@Frenchie_ Le power du mec, il TP et les ticker crash 😆

Français

@gregisenberg @mvanhorn So in Oder to summarize we need OpenaiAi api and Reddit API? Right

English

I sat down with matt van horn (@mvanhorn) and watched him turn claude code into a real-time research engine with his /last30days claude code skill

he "fixes" claude code in 30 seconds.

this skill pulls what’s actually working right now from x, reddit, and the web, then feeds that context straight into your prompts so you stop building off stale advice.

we went from trending rap songs → cold email frameworks → researching clawdbot → planning and building a competitor live, with almost zero hand-written code.

pretty nifty little claude code skill

share this with a friend / full ep available on @startupideaspod where i will give you ideas/tools/tutorials to make your dreams a reality

i will not hold back any alpha and this claude skill is alpha forsure

you can install this claude code skill in 30 seconds

dream big my friends

English

@LeverCRO @cocogoatmain @MatthewBerman @nvidia @Dell 3 of them is like buying a house? How much does it cost?

English

@LeNoobCodeur Tres bien pour prendre la main. T’as pu gérer tes Channel simplement ?

Français

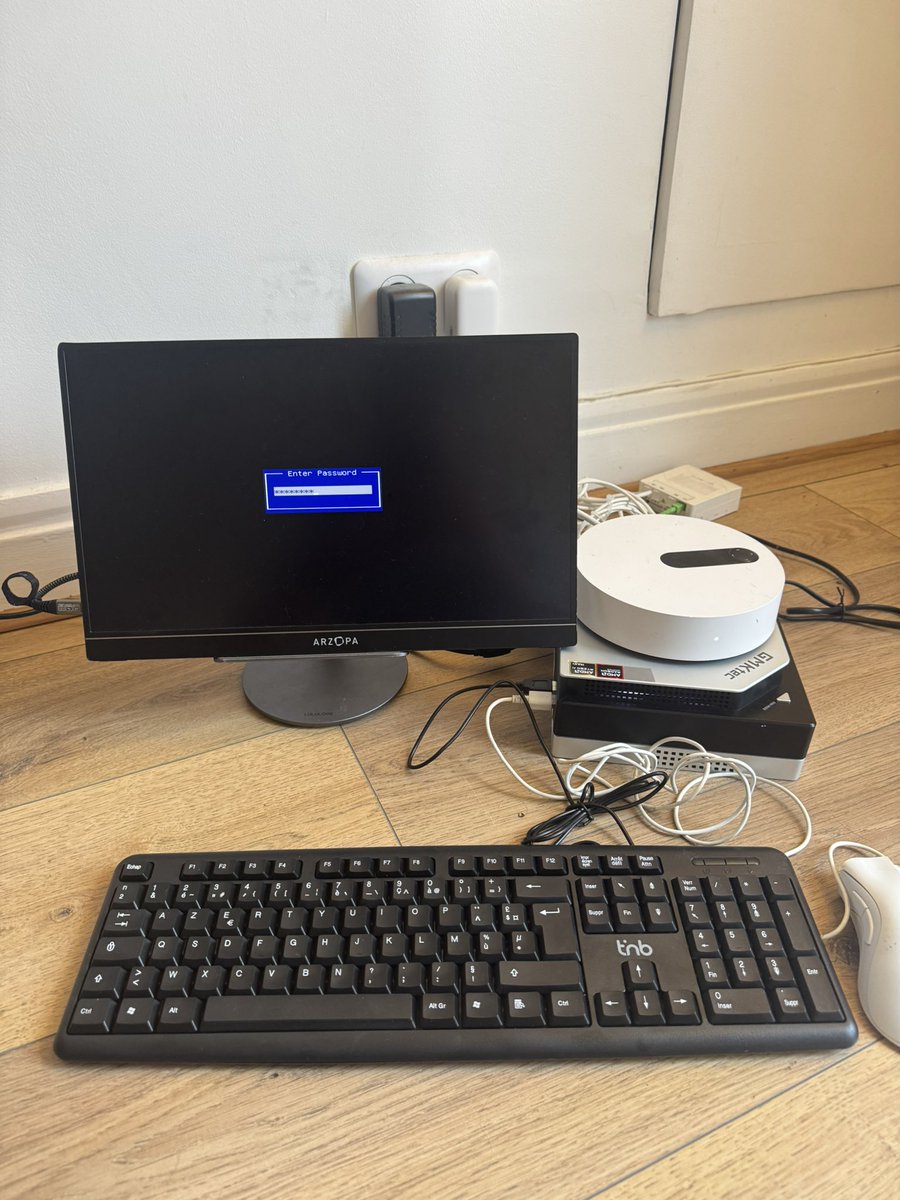

C'est connecté. 🦞

#OpenClaw tourne sur mon VPS, #OpenRouter configuré, modèles routés par type de tâche.

Honnêtement en tant que noob du terminal, sans l'IA pour débugger en temps réel j'aurais abandonné 3 fois aujourd'hui. Entre le heredoc qui bloque, le JSON invalide, le conteneur qui crash...

L'IA a tout résolu à chaque fois. En direct. Pendant que je galérais.

C'est peut-être ça le vrai use case qu'on sous-estime : pas juste automatiser des tâches, mais rendre accessible des trucs qui étaient réservés aux devs confirmés.

Français

@iamsupersocks Ça fait du bruit ou c’est plutôt silencieux ? Conduire un v8 c’est ok mais dodo à côté d’un monstre en plein régime c’est pas trop WAF

Français

Le Supersockslab. Jour 2.

Jour 1 : galère d’installation. Ubuntu Server, GPU non détecté, kernel trop vieux, 3 h de debug et d'installation. Normal j'y connais rien et je viens de déballer la bête.

Jour 2 : configuration hardware et premiers vrais tests.

Problème du jour 1 : 96 Go de RAM, mais par défaut Linux n’en donne qu’une partie au GPU. C’est comme un V8 bridé à 4 cylindres. Il a fallu passer par le BIOS et les paramètres kernel pour tout débloquer.

Résultat : le GPU voit 143 Go. Nemotron 120B (un modèle qui ne rentre même pas sur une RTX 4090 24 Go) se charge entièrement en VRAM. Zéro compromis.

Ensuite, les benchmarks. Pourquoi ? Parce qu’un modèle local, contrairement à une API, dépend entièrement de ta config. Entre une mauvaise et une bonne, c’est le jour et la nuit.

J’installe Claude Code en SSH. Je lui donne un fichier CLAUDE.md avec tout le contexte hardware (specs, chemins, commandes). Il devient opérationnel sur mon setup.

Le benchmark mesure les tokens par seconde (t/s).

< 8 t/s → lent, on attend

≈ 12 t/s → confortable, lecture en temps réel

> 30 t/s → instantané

→ Nemotron 120B premier test : 9,7 t/s. Correct, mais perfectible.

Claude Code teste 7 configurations. Résultat contre-intuitif : passer de 32 à 8 threads CPU donne +34 % de vitesse.

Raison : CPU et GPU partagent la même mémoire. Trop de threads CPU = bouchon autoroutier. Avec 8 threads, le GPU respire → 12,9 t/s stables. Je vais investiguer ça pour mieux comprendre.

Comparatif final sur 4 modèles :

- Nemotron 120B → 12,9 t/s (gros, lent, intelligent)

- Qwen 3 32B → 10,8 t/s (ancienne référence)

- Qwen 3.5 27B → 12,5 t/s (nouveau, aussi rapide que Nemotron pour 5× moins de mémoire)

- Qwen 3.5 35B-A3B → 61,5 t/s (le monstre)

61,5 t/s sur Qwen 3.5 35B-A3B (MoE : 35B total, 3B actifs par token).

Timing fou : Qwen 3.5 et Nemotron sont sortis entre la commande de la machine et aujourd’hui.

Bilan concret : j’ai mon ChatGPT local. Open WebUI, interface identique, mais zéro donnée ne sort de la machine. Parfait pour stratégie, données clients, etc. Pas pour toute les tâches bien sur.. on garde claude & chatgpt.

Qualité : entre GPT-3.5 et GPT-4o selon les tâches. 1 h de thermodynamique et calculs exigeants → très correct pour le ratio vitesse/précision.

Claude Code a piloté 90 % des ops. Stagiaire brillant : il faut le cadrer, vérifier, corriger quand il part en vrille, mais il va 10× plus vite que moi sur Linux.

On n’est qu’au début. J’ai déjà un modèle local assez intelligent pour remplacer Copilot sur certains usages. Pas encore optimal, mais la courbe d’apprentissage est exponentielle.

Connecté en SSH avec le téléphone je vais m'amuser un peu au lit à présent et faire travailler claude.

Benchmarks et analyse détaillés en cours. Suite demain.

Français

@iamsupersocks Du coup tu vas connecter ta machine de guerre avec Claude mais via l’api ou en mode souscription ?

Français

@Frenchie_ Des points d’entrée à surveiller?? Avec la hausse récente c’est un peu compliqué nan?

Français

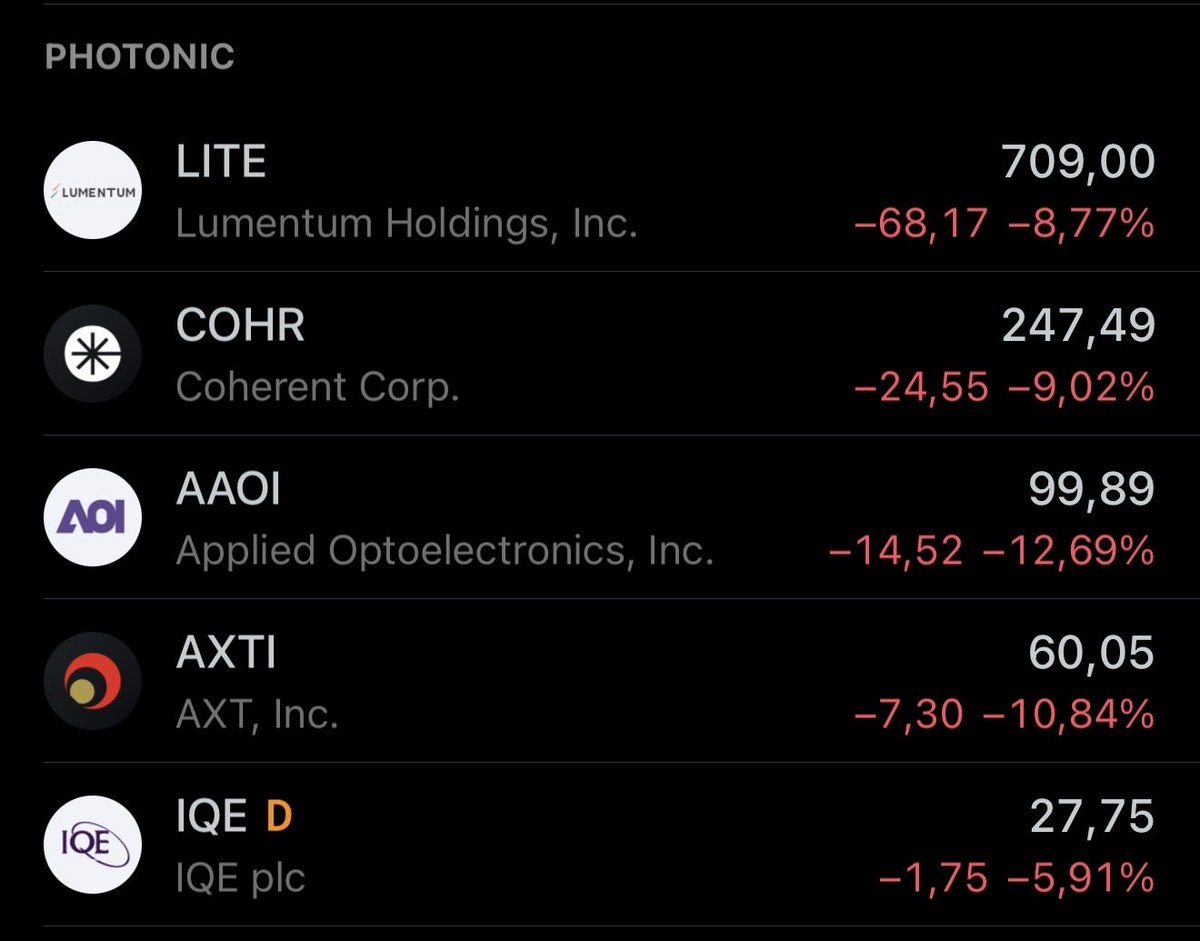

Pour les boîtes de photonique voici mon basket

La répartition est la suivante :

> $LITE : 30%

> $COHR : 25%

> $AAOI : 20%

> $AXTI : 15%

> $IQE : 10%

Cette allocation reste quand même très offensive tourné vers les leaders et quelques small caps.

$LITE et $COHR servent de socle car leaders du secteur.

$AAOI , $AXTI et $IQE sont des play plus agressifs.

Français

@MikeCodeur J’viens de recharger Nexos AI pour la 3eme fois.

Français

@MikeCodeur Pour utiliser Hostinger j’peux dire que déjà à la base Openclaw nécessite pas mal de configuration et optimisation mais sur VPS c’est encore pire

Français

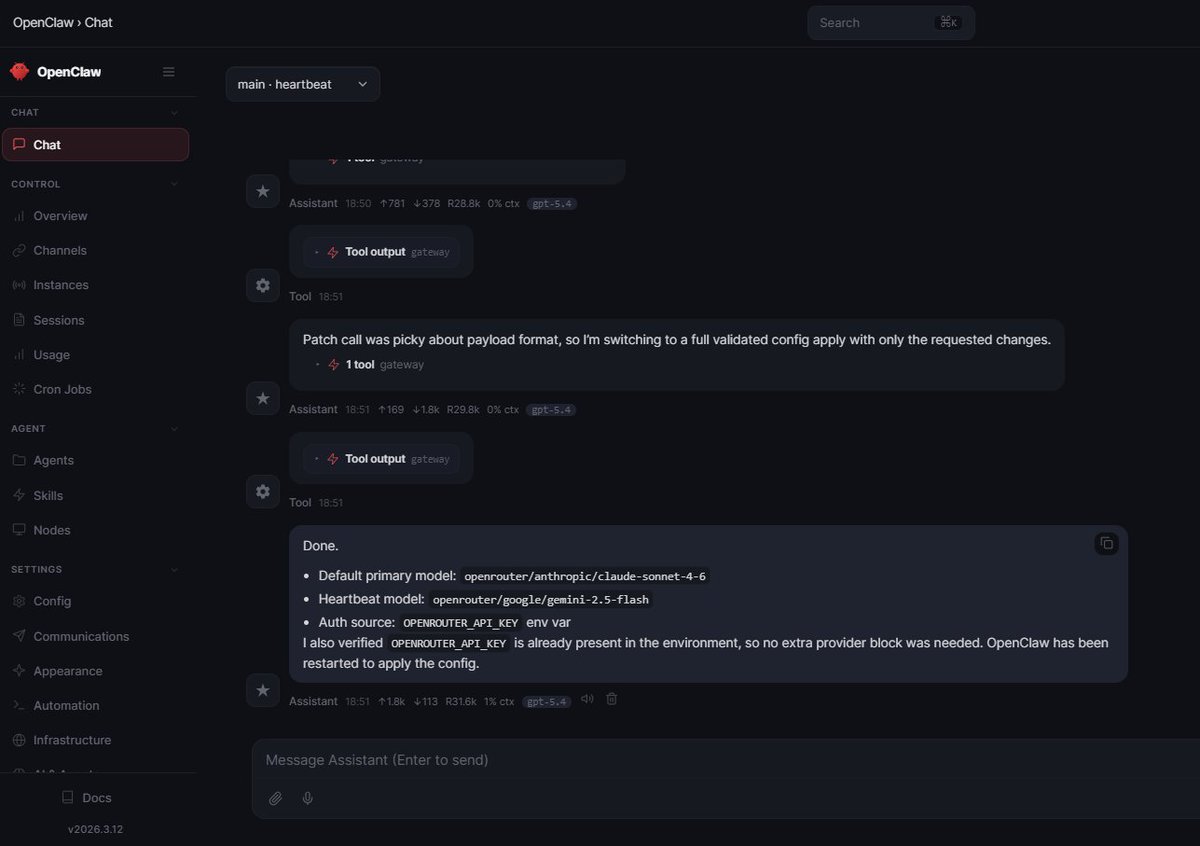

Je comprends pas la hype du Mac mini pour faire tourner OpenClaw.

mkc.sh/openclaw-orche…

Mon setup : un VPS à 10€/mois. 99,9% de disponibilité. Accessible de partout.

Dessus, mon OpenClaw fait tourner en parallèle :

- Des compilations vidéo lourdes

- Des builds de projets complets

- Des audits de sécurité automatiques

- Un orchestrateur multi-agents sur un kanban automatique

- Ma veille tech, mes posts sociaux, mes emails

Tout ça H24, sans ventilateur qui souffle sous mon bureau.

Un Mac mini c'est :

- 700-1500€

- Une IP résidentielle à configurer

- Un onduleur si tu veux pas tout perdre à la première coupure

Un VPS c'est :

- 10€/mois

- IP fixe, backups, redondance

- Tu scale en 2 clics

- Tu le kill et t'en reprends un autre si ça plante

Sérieusement — quelqu'un peut m'expliquer l'intérêt du Mac mini pour OpenClaw ?

Parce que pour l'instant, je vois pas.

👇 Ma dernière vidéo sur le multi-agent OpenClaw :

mkc.sh/openclaw-orche…

Français

@RyanSAdams Telegram me your email and I’ll have Felix send you some stuff to help speed up the learning curve 🫡🫡🫡

English

day 1 working with an OpenClaw bot as a founder / employee inside discord

inspired by @nateliason

my bot has flashes of pure brilliance, but kinda flaky.

the craziest thing is how he'll tell me he absolutely learned his lesson not do a thing, then an hour later he does the thing again

also...i'm having a hard time getting him to ship things. like he's always sandbagging me.

it's exhausting but at the same time incredible, because he'll have these flashes of insight or he'll build something cool and i'll see the potential again and want to keep working with him

English

@spideystreet @4ssulei Énormément d’opti. Sorti de boîte ça sert pas à grand chose et ça consomme et du temps et du token. Mais une fois pris en main et bien tuné c’est une machine de guerre

Français

d’ailleurs en fouillant bien je suis tombé un dashboard qui relaie les meilleurs modèles pour openclaw selon vos use cases 🔽

James Alley@james_alleyy

Vous utilisez quel model pour vos agents Openclaw ?

Français

@guillaume_rygn Salut mec, niveau secu tu penses qu’il y aurait un ou des risques de les prendre direct ? Ça nécessite pas un réglage ?

Français

Orchestrateur d'agent open source

c'est très très sympa comme projet ça ! j'en vois de plus en plus en open source dessus et clairement celui là est vraiment stylé 👇

dotta@dotta

We just open-sourced Paperclip: the orchestration layer for zero-human companies It's everything you need to run an autonomous business: org charts, goal alignment, task ownership, budgets, agent templates Just run `npx paperclipai onboard` github.com/paperclipai/pa… More 👇

Français