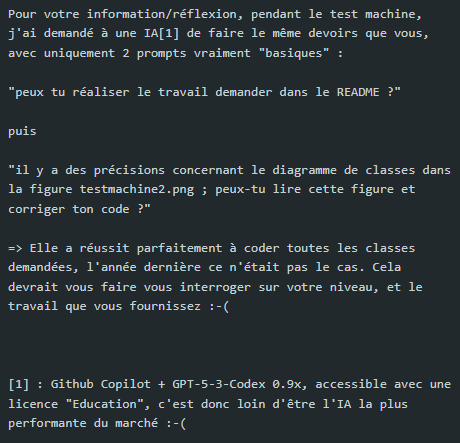

mobo

2.1K posts

mobo

@dotmobo

🧙♂️developer/AI engineer 🐧linux 💕python/rust/typescript 🎮lua/love2d/pico8 🎸metal 👽sci-fi 👻 horror 🐈⬛cats 🏕 forest 🚀e/acc

LiteLLM HAS BEEN COMPROMISED, DO NOT UPDATE. We just discovered that LiteLLM pypi release 1.82.8. It has been compromised, it contains litellm_init.pth with base64 encoded instructions to send all the credentials it can find to remote server + self-replicate. link below

L'IA devait sauver les développeurs, elle détruit leur production : un agent Claude Code supprime une base de données entière ; Amazon en réunion de crise après des pannes liées à l'IA. 👉 l.numerama.com/Jgj

On our way to OpenAI!

Scrum a ruiné une génération de devs. Les solutions clés en main d'agents IA vont ruiner la suivante. Pour exactement la même raison. Le pattern : → un problème fondamentalement contextuel → quelqu'un vend une méthode générique → tout le monde l'applique sans réfléchir → ça marche pas → on blame l'exécution au lieu de la méthode Les meilleures boîtes n'ont jamais appliqué Scrum by the book. Elles ont construit leur propre façon de fonctionner, adaptée à leur contexte, leur culture, leur stade de croissance. Et elles l'ont fait évoluer en permanence. Avec les agents, c'est exactement pareil. Chaque boîte a une archi différente, une stack différente, des process différents. Brancher un agent générique sur tout ça et espérer que ça marche, c'est la même illusion que de coller Scrum sur une équipe et attendre que la productivité explose. Nous en ce moment on construit Argil Forge. C'est notre harness interne. On a wrappé Claude Code avec toute notre infra : → Playwright pour le browser → Tauri en desktop app → un backend qui orchestre nos services → des worktrees git dédiés avec des ports séparés par service → des callbacks d'auth auto-générés Résultat : un agent qui a le même setup qu'un ingé onboardé chez nous. Pas un outil générique posé dans un terminal qui bosse en silo. On commence par le produit, mais le plan c'est d'étendre à toute la boîte : ops, marketing, ads, SEO, legal. → Ship une feature → la landing se crée → Nouveau use case → la campagne se lance Et tout ce qui a vraiment de la valeur là-dedans, c'est ce qui est propre à nous : → Le context graph de la boîte → La mémoire globale de l'orchestrateur level 0, qui porte la vision d'ensemble → La mémoire de chaque agent spécialisé, qui accumule l'expertise de son domaine → Une decision trace commune entre toutes les entités, pour que chaque décision prise par un agent soit visible et traçable par tous les autres C'est pas générique. C'est le reflet de comment notre boîte fonctionne. Et c'est un truc qu'on va owner et maintenir de manière profonde, parce que c'est ça qui permet à terme de faire tourner la boîte quasiment en autopilote. L'objectif dans quelques mois chez Argil, c'est qu'il reste deux métiers : → Maintenir et faire évoluer ces systèmes → Prendre les décisions qui reposent sur de la taste, et corriger celles de l'agent quand il se trompe Et quand l'agent a suggéré 10 décisions d'affilée validées par l'humain, on considère que ce domaine commence à pouvoir tourner en autopilote. Dans le futur, les meilleures boîtes owneront leur agent infrastructure comme elles ownent leur culture et leur orga. Ça se construit, ça se maintient, ça évolue. Les autres achèteront le "Scrum des agents" et se demanderont pourquoi rien ne marche.

Introducing NVIDIA Nemotron 3 Super 🎉 Open 120B-parameter (12B active) hybrid Mamba-Transformer MoE model Native 1M-token context Built for compute-efficient, high-accuracy multi-agent applications Plus, fully open weights, datasets and recipes for easy customization and deployment. 🧵

Advanced Machine Intelligence (AMI) is building a new breed of AI systems that understand the world, have persistent memory, can reason and plan, and are controllable and safe. We’ve raised a $1.03B (~€890M) round from global investors who believe in our vision of universally intelligent systems centered on world models. This round is co-led by Cathay Innovation, Greycroft, Hiro Capital, HV Capital, and Bezos Expeditions, along with other investors and angels across the world. We are a growing team of researchers and builders, operating in Paris, New York, Montreal and Singapore from day one. Read more: amilabs.xyz AMI - Real world. Real intelligence.

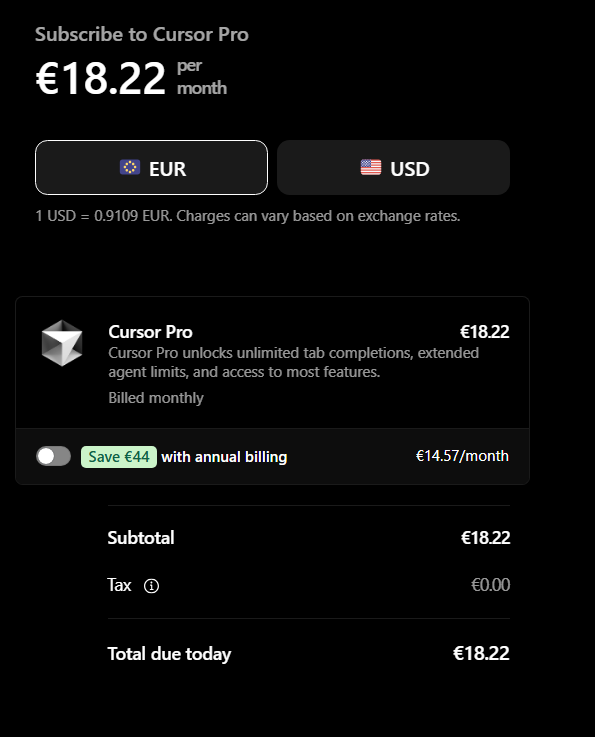

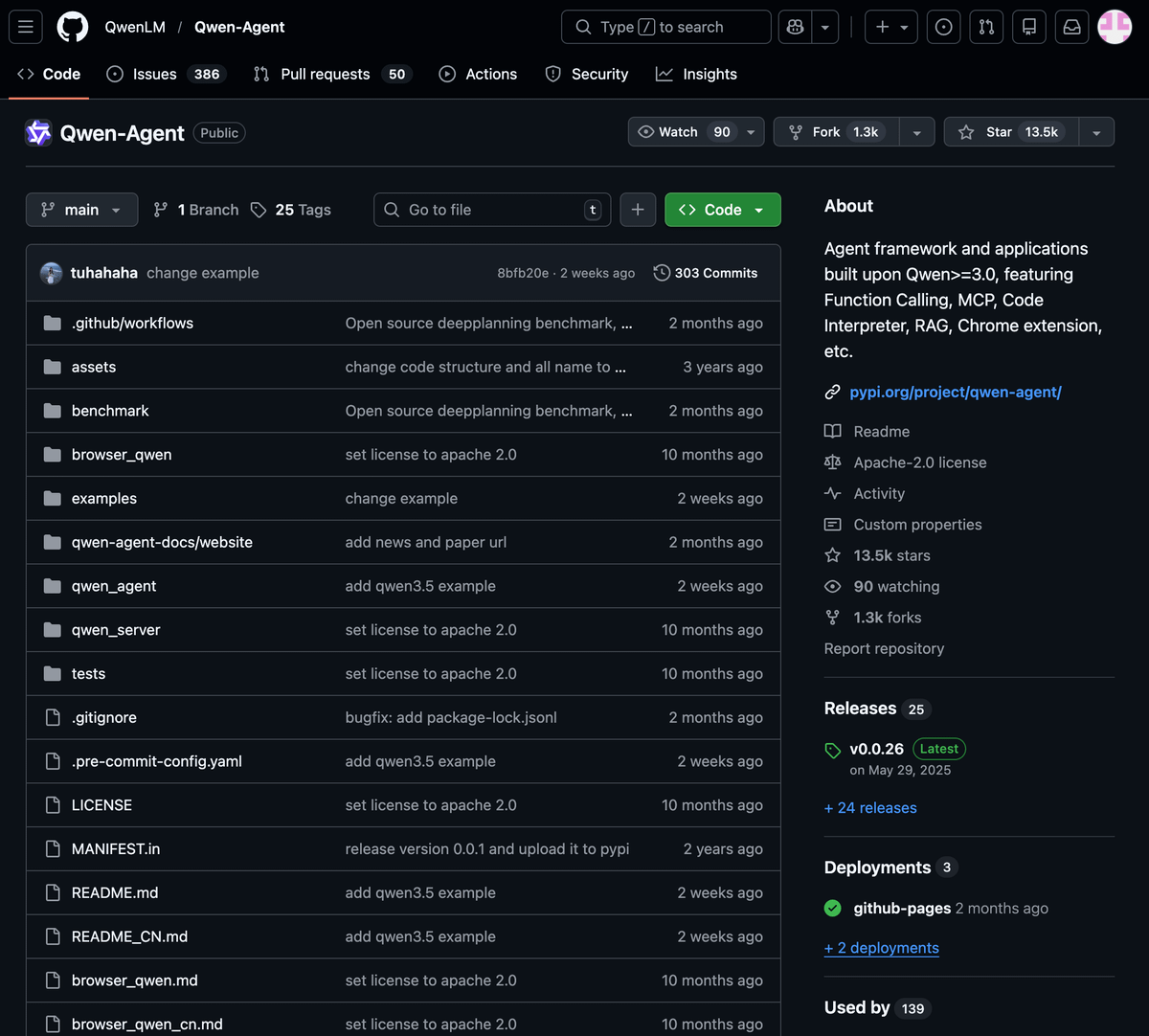

testing Qwen3.5-35B-A3B latest optimized version by UnslothAI on a single RTX 3090. one detailed prompt. zero handholding. watch a 3B model scaffold an entire multifile game project autonomously. the setup: > model: Qwen3.5-35B-A3B (80B total, only 3B active per token) > quant: UD-Q4_K_XL by Unsloth (MXFP4 layers removed in latest update) > speed: 112 tok/s generation, ~130 tok/s prefill > context: 262K tokens > flags: -ngl 99 -c 262144 -np 1 --cache-type-k q8_0 --cache-type-v q8_0 > engine: llama.cpp > agent: Claude Code talk to localhost:8080 (llama.cpp now has native Anthropic API endpoint. no LiteLLM needed) q8_0 KV cache cuts VRAM usage in half vs f16 at 262K. -np 1 is default but worth noting. parallel slots multiply KV cache and at 262K that's an instant OOM. the prompt was more detailed than this but you get the idea: build a space shooter with parallax backgrounds, particle systems, procedural audio, 4 enemy types, boss fights, power-up system, and ship upgrades. 8 JavaScript modules. no libraries. game's called Octopus Invaders. gameplay footage dropping next.