Seriou

567 posts

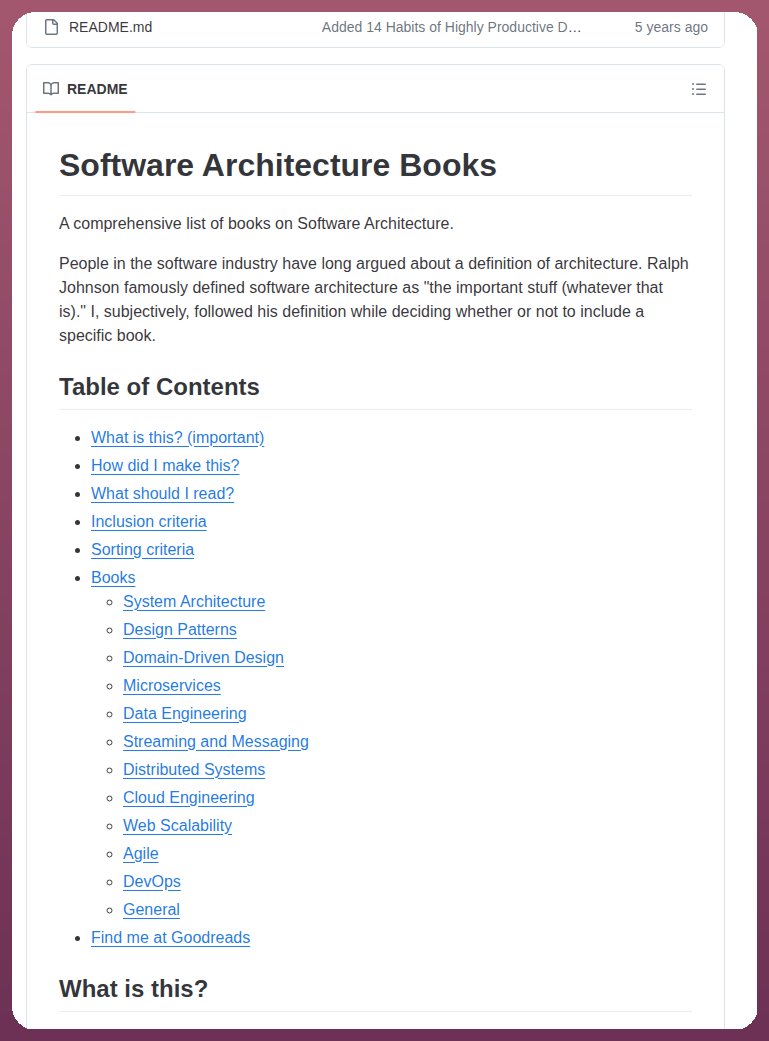

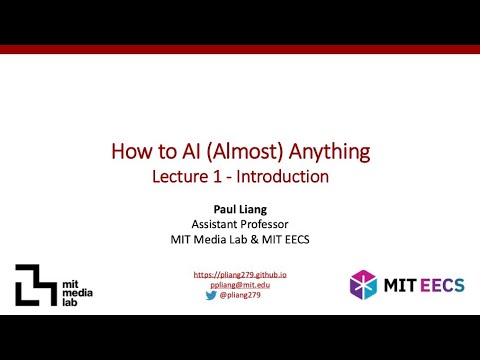

Anthropic pays $750,000+ a year for engineers who can build LLM architectures from scratch. Stanford taught the entire thing in 1 hour lecture & released it for free. Bookmark & watch this today before someone takes it down.

Anthropic CEO Dario Amodei把所有程序员和独立开发者的终局和心里模糊的不安都说透了:未来只有5%的人能真正留在牌桌上。 他平静但无比坚定,说最先被商品化的,是写代码这件事, 再往后,软件工程里从需求分析、架构设计到测试部署的大部分常规流程,也会被逐步接管。 最后能真正留在牌桌上的,只有大约5%的人。 以后拼的再也不是谁写的语法更标准,谁背的API更多,而是系统思维。 你能不能把一堆零散的AI能力,编排成一个稳定可靠的系统。 能不能给AI设边界、管长期记忆、控边缘推理。 能不能驾驭AI,而不是被AI替代。 Amodei反复强调,这不是什么遥远的未来,这就是正在发生的事。 看完真的感慨万千,也许AI根本不是要消灭所有开发者,它只是在重新定义开发者的价值。 过去的价值在告诉机器怎么做,未来的价值在告诉系统要做什么。 过去你是写代码的人,未来你是设计和掌控整个智能系统的人。 未来的编程不会再是是写给机器,更多是写给系统的。

比较有趣的入门教程 该项目希望用一条更“实践优先”的路径来学习现代强化学习:从经典控制出发,逐步连接到 LLM 后训练基础、DPO/GRPO/RLVR、Agentic RL 和 VLM RL 等现代应用。 GitHub: github.com/walkinglabs/ha… WebPage: walkinglabs.github.io/hands-on-moder…