Pinkpig retweetledi

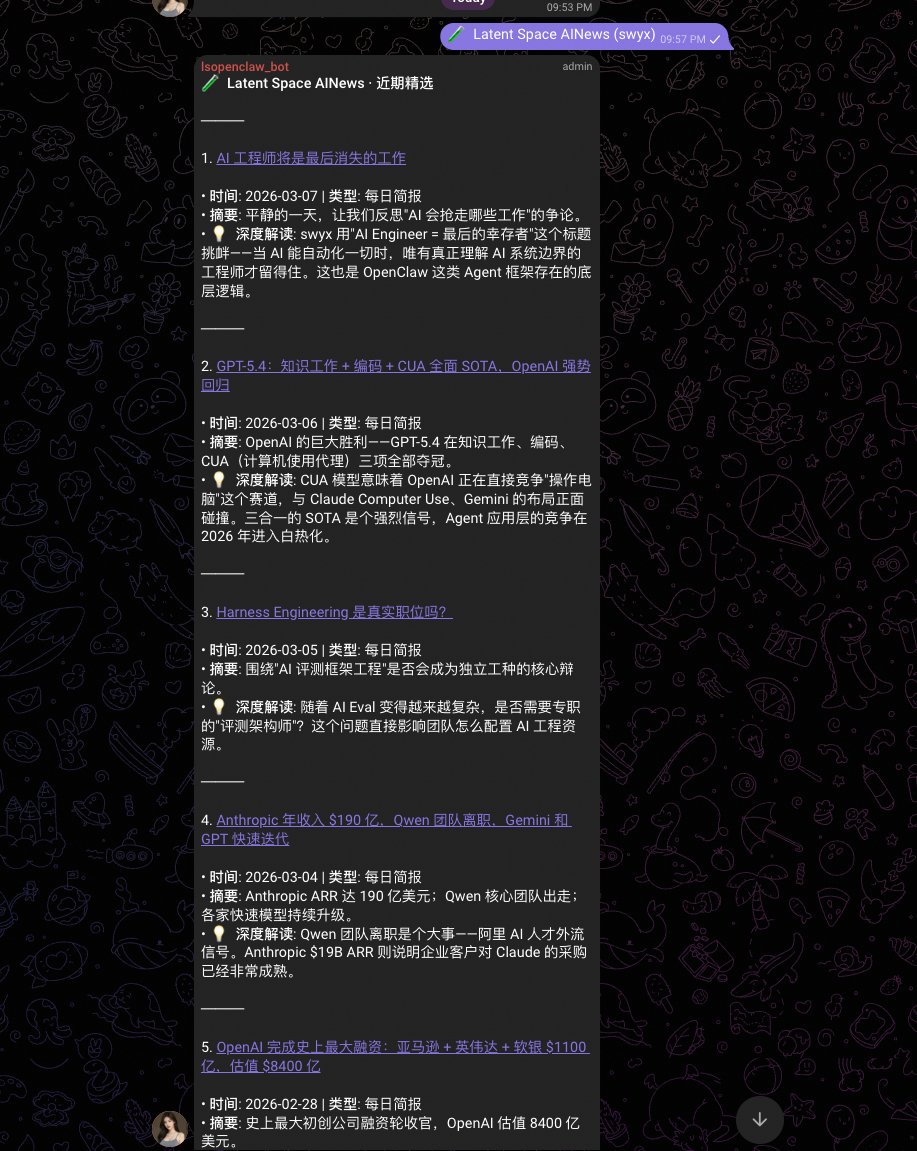

Anthropic 工程博客最新一篇,揭示了一个做 AI Agent 的反直觉事实:

让 Agent 自评自己的产出,它会自信地给平庸作品打高分。任务越主观(比如 UI 设计),这个偏差越致命。

他们的解法借鉴了 GAN 的对抗思想——把生成和评估拆成独立 Agent,让它们互相制衡。

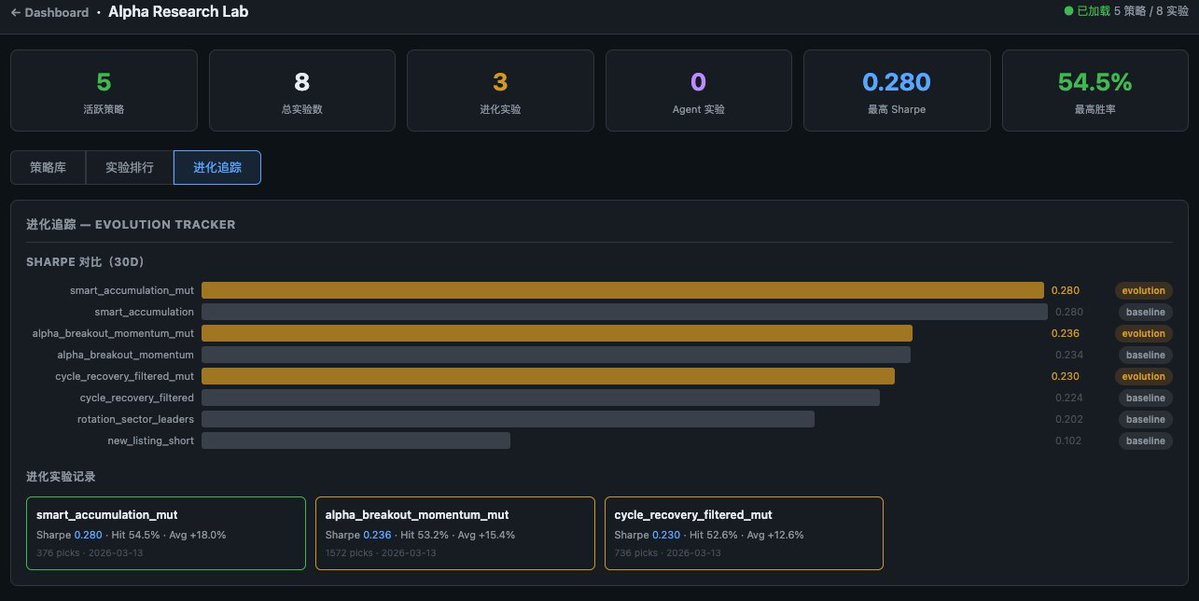

最终架构是三个专职 Agent: • Planner:一句话需求 → 完整产品规格(会主动把 AI 能力编织进去) • Generator:React + Vite + FastAPI + PostgreSQL 增量实现 • Evaluator:通过 Playwright 真实操作界面打分——点按钮、调 API、查数据库,不是看截图

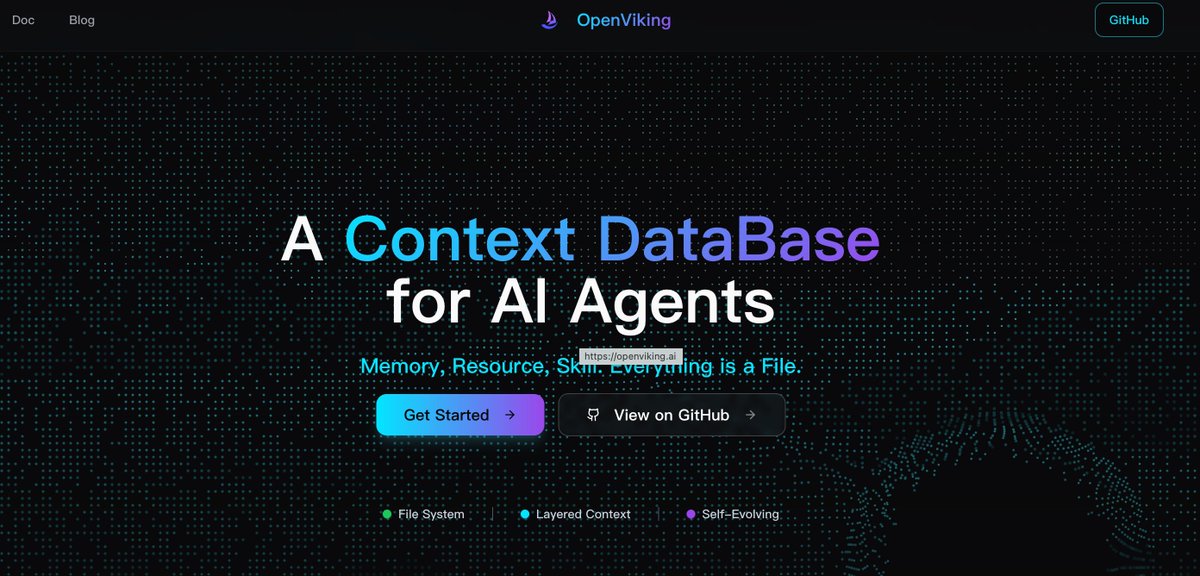

效果对比(同一个任务:做一个 2D 游戏编辑器): → 单 Agent:20分钟 / $9 / 界面能看但游戏逻辑全断 → 三 Agent Harness:6小时 / $200 / 有物理引擎、可用编辑器、AI 内容生成

其中评估者的调校是最难的部分。初版评估者能发现 bug,但会自己合理化——"虽然有问题,但整体还不错"。作者的迭代方法:读评估日志 → 找判断偏差点 → 更新 prompt 纠正偏差模式。本质是在训练 prompt,而不是训练模型。

他们还设计了"冲刺合约":评估者在实现前和生成者协商验收标准。做一个音乐 DAW 时,仅关卡编辑器一项就定了 27 条验收标准,精确到能抓出"矩形填充工具只在拖拽端点放图块,而非填满整个区域"这种粒度的缺陷。

模型演进也在改变 Harness 设计。Sonnet 4.5 有严重的"上下文焦虑"——感知到上下文快满,就草草收尾。必须手动重置上下文才能继续。但 Opus 4.6 自带自动压缩机制,连续跑长会话不再焦虑,直接省掉了这层复杂度。

于是作者开始系统性删减 Harness:去掉冲刺合约,改单轮评估。简化后的 V2 架构做音乐 DAW,$124.70、3小时50分钟,多轮 QA 仍能抓到真实缺陷——缺拖拽排序动画、未实现音频录制、缺效果可视化。

文章最核心的五条教训:

- 持续实验,你对模型的假设会过期

- 拆解任务,用专职 Agent 攻子问题

- 新模型发布时重新审视 Harness,删掉不承重的复杂性

- 生成与评估分离,比让生成者自我批判更容易校准

- 用具体标准让主观判断可打分——"好看"不是标准,"对比度是否足够"才是

最后一个洞察:模型变强后,解决方案空间不会缩小,而是位移。有趣的 Harness 组合会转向更高能力目标,而非消失。Harness 设计是一场和模型共同进化的军备竞赛。

anthropic.com/engineering/ha…

中文