rhoninzhang

228 posts

@54banana88 @ChongguangW 你高興就好

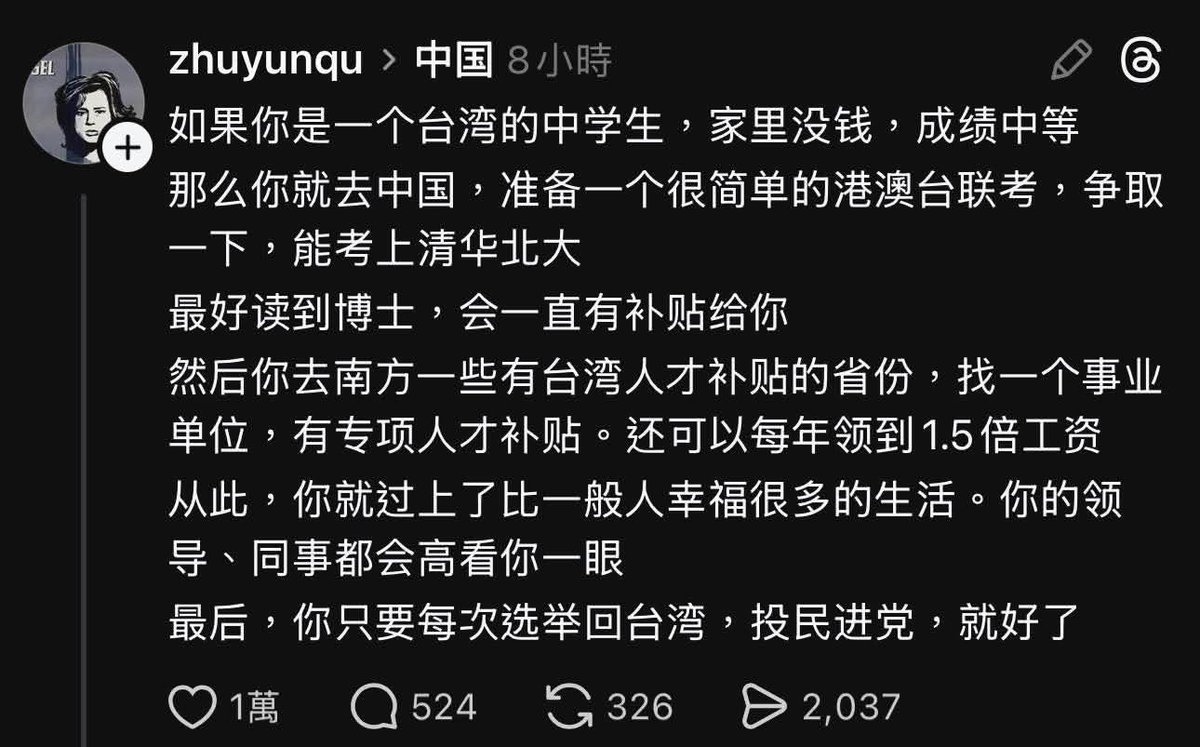

反正你只要記住台灣人去中國有各種補助

北大清華211985愛上不上

而你們中國人什麼屁都沒有

這樣就夠了

看你氣到臉色發紫都拿我們沒轍

就是舒服

中文

@goodhunt 滴滴,就是中国的 uber,这个必须要。

住宿直接希尔顿 app 之类的就可以,希尔顿在中国算中档酒店了,比在美国的服务好点但是相对中国的便宜酒店稍贵

既然到香港了为什么不去深圳,那里是科技之都。

欢迎来中国,哥们

中文

rhoninzhang retweetledi

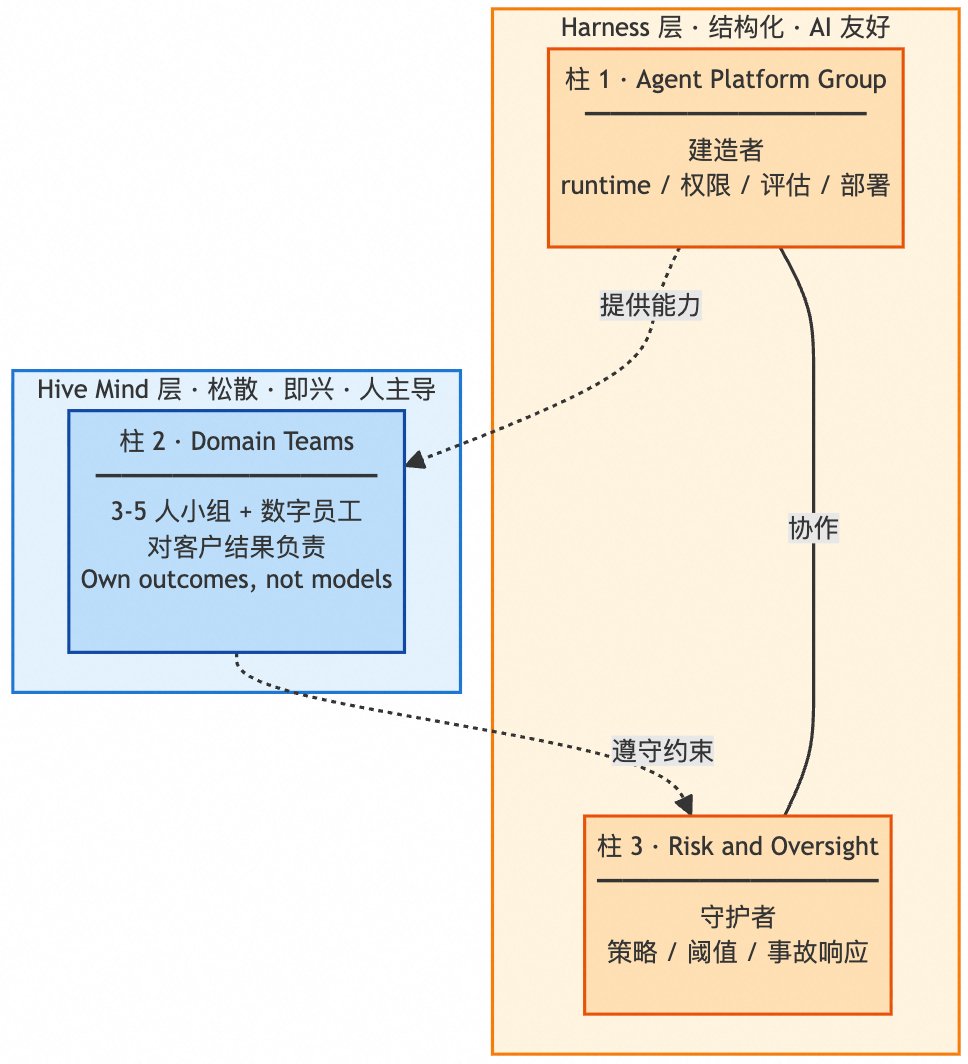

阿里这篇关于 AI Native 时代组织研发的思考非常值得一读。它在思路一个非常重要的底层问题:过去两千年的组织形态,都是围绕人的局限建立起来的。

人会遗忘,会疲惫,会误解,会有情绪。一个人能够稳定协作和管理的人数有限,信息在层级之间传递一定会衰减,所以组织才需要汇报链、部门边界、经理角色、需求评审、流程审批和各种协调机制。很多我们习以为常的管理制度,本质上不是先进设计,而是对人类认知带宽的妥协。

AI Agent 进入组织之后,这个前提开始松动。它不是普通工具。普通工具只是延伸人的手脚,Agent 则开始参与理解、执行、调用系统和交付结果。它没有疲劳,没有情绪,没有传统意义上的沟通损耗,也几乎没有上下文切换成本。于是,旧组织里大量围绕人设计出来的结构,都会被重新审视。

这并不意味着人马上被替代。更准确的说法是,组织过去长期依赖人的地方,第一次被暴露出来了。

很多系统之所以能运转,并不是因为它们真的清晰、完备、结构化,而是因为人在中间做了太多隐性修补。需求写得不完整,可以开会问。接口约定不一致,可以找熟人确认。代码缺少说明,可以凭经验猜。业务规则藏在老员工脑子里,也可以靠人肉沟通补齐。这些动作太常见,以至于我们忘了它们本身就是成本。

当 AI 接管更多执行工作之后,问题就变得尖锐。AI 需要清晰的上下文、稳定的接口、可执行的测试、完整的文档、明确的权限和可追踪的结果。传统系统没有为 AI 留出这些入口,所以员工反而变成了人肉中间件:从系统里复制数据,贴给 AI,再把 AI 的输出搬回系统。看起来是在用 AI,实际是在用人弥补系统对 AI 的不友好。

因此,AI Native 转型的核心瓶颈,往往不是模型能力不够,而是组织的信息形态太旧。真正重要的工作,是把隐性的经验、流程、标准和判断,转化成 AI 可以理解、调用和验证的基础设施。文章里提到的 Harness,可以理解为让 Agent 真正能干活的底层环境。它包括测试、文档、权限、日志、评估、工具接口和事故响应。它不显眼,却是未来组织速度的本金。

这也解释了为什么资深工程师和架构师会变得更重要。过去高价值人才可能体现在亲自解决复杂问题,现在更高的杠杆来自定义系统如何解决问题。他们要把领域经验写成规则,把失败模式沉淀为测试,把判断标准变成可复用的评估,把只可意会的经验变成可执行的流程。一个好的 Architect,不只是写代码的人,更像是在为一群 Agent 设计工作环境和行动边界。

与此同时,管理也不会简单消失。会消失的是大量信息传递型、协调型、汇报型的管理工作。战略传达、进度聚合、资源协调、日常决策,会越来越多地被系统承接。但人的激励、辅导、冲突处理、身份安顿、文化建设,仍然需要人来完成。更重要的是,转型本身会带来真实焦虑。员工把经验蒸馏成组织资产时,会自然担心自己被替代。这个问题不能靠口号解决,必须靠清晰的角色迁移、利益分享和评价机制来接住。

文章里另一个值得警惕的点,是不要把所有工作都推向极致透明和彻底结构化。执行类工作适合透明,适合让失败快速暴露,适合减少防御性自我。可创新类工作需要一些保护空间。很多真正有价值的想法,一开始都很脆弱、粗糙、反共识。如果过早暴露在统一评估和公共审视中,很容易被磨平。AI 很擅长执行和优化,但它没有那种连续几个月死磕一个问题的执念。人的生产性自我,依然是创新里最重要的燃料。

所以,AI Native 组织的成熟形态,很可能不是更冷冰冰的机器公司,而是上下两层同时存在:底层极度结构化,让 AI 能安全、稳定、高速地执行;上层保持足够开放和松散,让人提出问题、形成判断、冒险试错、保护尚未成形的想法。

这篇文章最终给我的启发是,AI 对组织最大的改变,并不是降本增效这么简单。它会逼迫组织回答一个更深的问题:你的经验是否能被沉淀,你的流程是否能被调用,你的判断是否能被验证,你的系统是否真的清晰。如果答案是否定的,AI 只会放大混乱。如果答案是肯定的,组织会获得一种新的适应速度。

中文

rhoninzhang retweetledi

Codex grew programmatic policies with no neural nets: max score on Breakout, and SOTA-level scores on MuJoCo.

Maybe heuristics were not too weak. Maybe they were just too expensive to maintain. Maybe it's the next paradigm.

trinkle23897.github.io/learning-beyon…

English

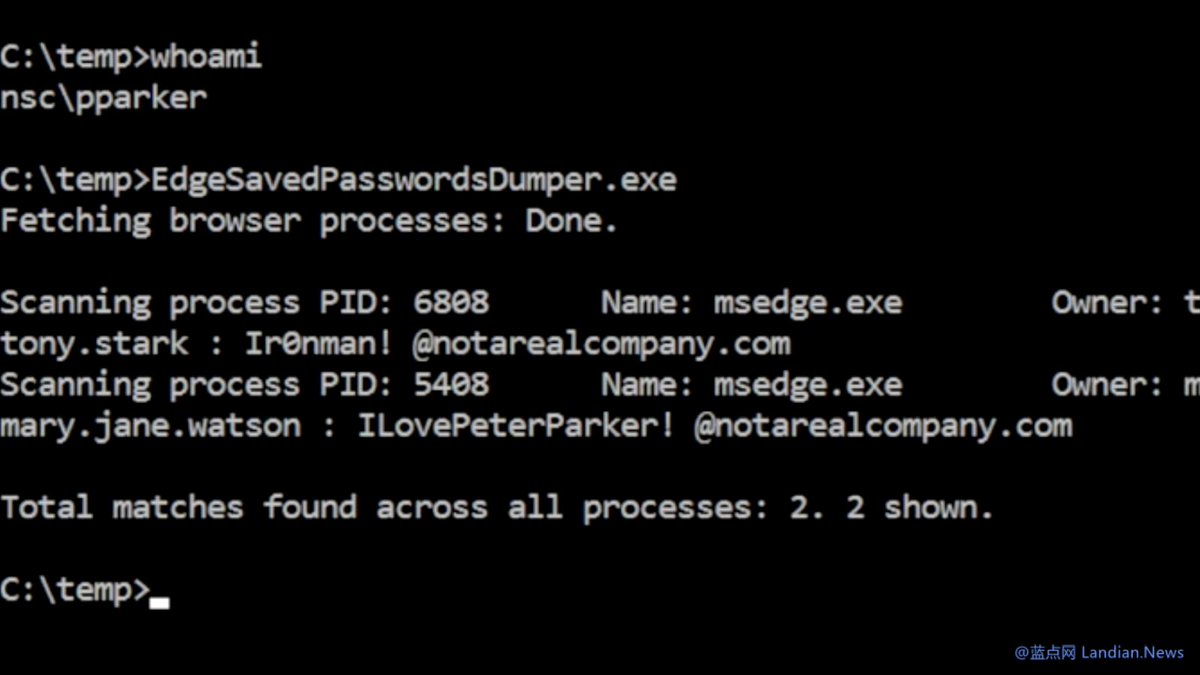

研究人员发现 Microsoft Edge 会将用户已经保存的账号密码以明文形式放到内存中,即便在用户没有填充密码时也会直接暴露到内存中。研究人员向微软通报漏洞后,微软称这是有意为之所以不是漏洞,因此研究人员直接公开漏洞并发布概念验证工具。查看详情:ourl.co/112842

中文

实锤!Codex 里已经能免 API Key 直接生图了(而且就是 gpt-image-2!),但我实测也挖出了一个隐藏限制。。。

Codex 现在真的已经能直接生图了。。。

不用自己接 API,不用单独配 key,直接在对话里就能出图。

我实际测了一轮,结果如下:

- 1:1 出图大约是 1254 × 1254,总像素 1,572,516

- 16:9 出图大约是 1672 × 941,总像素 1,573,352

- 3:1 出图大约是 2172 × 724,总像素 1,572,528

- 1:3 出图大约是 724 × 2172,总像素 1,572,528

也就是说不管你怎么换比例,Codex 内建生图总像素数最后基本都卡在约 157 万像素 这一档。。。

生成图像质量可以看我这个帖子的贴图

所以结论就是:

1. Codex 里使用的就是 image-gpt-2 模型,复杂图、非拉丁文字都能处理

2. 跑不了4K,2K都到不了,它把分辨率限制在总像素数不超过 157 万像素这一档。。。

中文

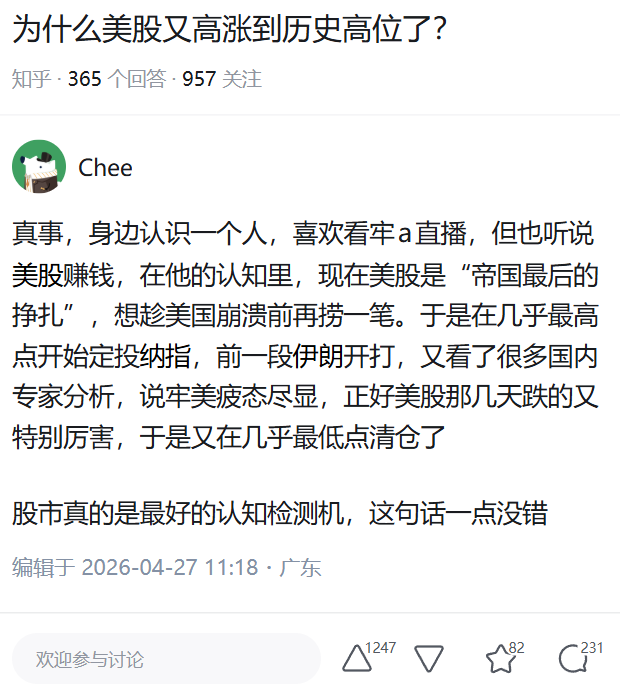

原推这个,和我体感高度一致

并不是所有人都有意愿,去探索AI工具的上限

比如说,

我反复和团队的人,

安利 Claude 的 Opus 4.6,

安利 OpenAI 的 Chatgpt 5.5 ,

然后,只安利成功了 Gemini, 盖因为 Google的AI Studio 免费...

结果现在 很多人还在用 gemini 3.1 pro, 还有一部分人在用豆包 和 deepseek ...

虽然我认可只要用AI 模型就好过不用AI模型,

但是推友们都能理解并接受 “用力所能及能负担的最强模型”,身边的成员却无法践行,真的让我挺受挫的,其中不乏一些我认为非常优秀的人...

这也让我深刻意识到,并不是所有人都有意愿,去探索工具的上限,这终归是少数人的需求。

对于大多人来说,“够用”就行了。

Tracy@CTracy0803

虽然大家普遍认为Claude是最牛的大模型公司,周围也都在用Claude。 但实际上,Claude的月活只有2000-3000 万人,是Gemini的1/30,更是Chatgpt的1/40。

中文

终于!历时 3 天打磨,来自日本、德国、巴西、韩国等朋友的支持 💪

支持 72+ 图片和视频模板、 open-design 正式支持全模态设计!🔥

gpt-image 2、seedance 2、免费的 hyperframes!

推特上最顶级提示词、模板直接用,每个人都能用顶级图片做顶级的设计🔥

关注进展 👉 github.com/nexu-io/open-d…

Tom Huang@tuturetom

正式开源 open claude design 🚀 超 95% 以上的还原度! 浓缩和逆向所有 claude design 最先进的设计,最好看的模板💥 历时 72 小时,18700+ 行代码,30+ 设计 Skills,支持超过 71 套 设计系统,支持所有的 code agent,包括 claude code、codex、openclaw 等 🔥

中文

rhoninzhang retweetledi

本周 HuggingFace 热度第一的论文:RecursiveMAS(递归多Agent系统)

多个 AI 组队协作,现在已经是主流方案。

模型 A 想好了传给模型 B,模型 B 想好了传给模型 C,一棒接一棒。

但传的东西是文字。

每次交接都要把内部计算结果"翻译"成 token,下一个模型再重新"读懂",再翻译……

轮次越多,无效开销越多,而且会影响学习信号回传。

RecursiveMAS 做法:

Agent 之间不传文字,直接传模型内部的数值向量。

形成一个递归闭环,迭代打磨,只有最后一轮输出文本答案。

连接模块极其轻量,底层模型全程不动,只训练中间那个"传话"的小模块。

AIME 顶级数学竞赛题上,比最强基线高 13-18 个百分点。

推理速度快 2.4×,Token 用量少 75%,训练成本比 LoRA 还低。

且递归轮次越多,优势越大。

论文地址见评论区,有空可以翻译下。

中文