Heni Ben Amor

233 posts

@asurobot

Visiting Faculty @ Google DeepMind | Associate Professor for Robotics and Machine Learning at Arizona State University. Director of Interactive Robotics Lab.

昨年発行の『強化学習アルゴリズム』ですが,お蔭をもちまして,発売後3か月と少しで,早くも累計出荷数1,000部を突破しました🎊🎊皆様には心より御礼申し上げますとともに,引き続き本書をよろしくお願いします🙇♂️ x.gd/dIgzm #アルゴリズム #強化学習 #深層学習 #機械学習

Want to teach your robot new tricks with NLP and Deep Learning? We are posting the full source-code to our NeurIPS 2020 paper along with an easy, hands-on tutorial on Medium - lots of explanations and videos! Github Code: github.com/ir-lab/Languag… Medium: sstepput.medium.com/teach-your-rob…

うわー。これは控えめに言ってやばすぎます。学会でのインシデント史上最悪レベルの大事件だと思います。 【緊急】AI/ML学術界で史上最大級のセキュリティ事故が発生 11月27日、OpenReviewのシステム脆弱性により、プラットフォーム上で運営されている全ての学術会議で著者・査読者・エリアチェアの身元情報が漏洩しました。これは匿名査読という学術の根幹制度が完全に崩壊したことを意味する極めて深刻な事態です。 ■ 影響を受けた主要会議(一部) ・ICLR(全年度) ・NeurIPS(全年度) ・ICML(全年度) ・ACL / ACL Rolling Review ・EMNLP(全年度) ・CVPR(全年度) ・AAAI ・その他、OpenReview上の各種ワークショップ・シンポジウム つまり、AI・機械学習・自然言語処理・コンピュータビジョン分野のほぼ全ての主要国際会議が影響を受けています。推定で数万人規模の研究者の情報が露出した可能性があります。 ■ 何が漏洩したのか ・論文著者の氏名・所属機関 ・査読者の氏名と担当論文の対応関係 ・エリアチェア(採否判断を行う上級査読管理者)の氏名と担当論文 ・過去の年度の論文についても遡及的にアクセス可能だった 通常、学術会議ではダブルブラインド査読(著者も査読者も互いの身元を知らない)によって公正性を担保していますが、この前提が完全に破壊されました。 ■ すでに発生している実害 ICLR 2026の公式声明によると: ・談合の試みの報告を複数受けている ・査読スコアの異常な上昇を観測 ・著者から査読者への脅迫・賄賂の可能性 これは理論上のリスクではなく、現実に進行中の不正です。「スコアを上げなければ報復する」「金銭で評価を買う」といった行為がすでに行われている可能性が高いと考えられています。 ■ 技術的な原因 OpenReviewの `profiles/search` というAPIエンドポイントで、本来は権限を持つユーザーのみがアクセスできるべき情報が、認可チェックなしで一般公開されていました。URLのパラメータを変更するだけで、特定の会議の査読者リストを誰でも取得できる状態でした。これはセキュリティの基本中の基本である「アクセス制御」の不備(Broken Access Control)であり、OWASP Top 10で最も深刻な脆弱性とされています。 バグは11月27日10:09(UTC)に報告され、11:00には修正されましたが(対応自体は迅速)、一部のユーザーは11月12日頃からこのバグが存在していたと報告しており、2週間以上にわたって悪用可能だった可能性があります。 ■ ICLR 2026の緊急対応 ・全ての論文に新しいエリアチェアを再割り当て ・査読スコアを議論期間開始前の状態に巻き戻し(議論の成果も全て無効化) ・査読者による追加のスコア変更や議論参加を禁止 ・公開コメント機能を無効化 ・不正行為者は投稿論文をデスクリジェクション(査読なし不採択)+複数年の会議出禁 ・OpenReviewは多国籍法執行機関と連携し、悪用者への法的措置を検討 ■ なぜこれほど深刻なのか 1. 査読者への報復リスク:低評価をつけた査読者が特定され、SNSでの晒し上げ、職場への苦情、将来的な報復査読などのリスクに晒されます。これにより、今後査読を引き受ける研究者が減少する可能性があります。 2. 学術的公正性の崩壊:著者が査読者を特定できてしまうと、圧力・脅迫・賄賂によって評価を歪めることが可能になり、論文の質による公正な評価という学術の根幹が機能しなくなります。 3. 過去の論文への遡及的影響:過去に不採択になった論文の著者と査読者の関係が判明することで、「あの時の恨み」に基づく将来的な報復が可能になります。学術コミュニティ内の人間関係・権力構造が可視化されたことの影響は計り知れません。 4. 採択結果への永続的な不信:ICLR 2026で採択された論文は「本当に公正に評価されたのか」という疑念が常につきまといます。不採択になった著者は「談合で落とされたのでは」と考える可能性があります。 5. 中央集権的インフラのリスク:AI/ML分野の主要会議のほぼ全てが単一のプラットフォーム(OpenReview)に依存していたことで、一つのバグが分野全体を揺るがす結果となりました。 ■ 今後への影響 ・査読者のなり手がさらに減少(すでにAI/ML分野では投稿数爆発により査読者不足が深刻) ・オープンレビューへの移行議論の再燃 ・分散型査読システムの研究加速 ・OpenReview以外のプラットフォームへの移行検討 ・学術会議の運営体制・セキュリティ基準の見直し この事件は、デジタル化された学術インフラの脆弱性と、品質保証システムそのものの信頼性が問われる歴史的な転換点となる可能性があります。 詳細な技術解説:mgx.dev/blog/openrevie…

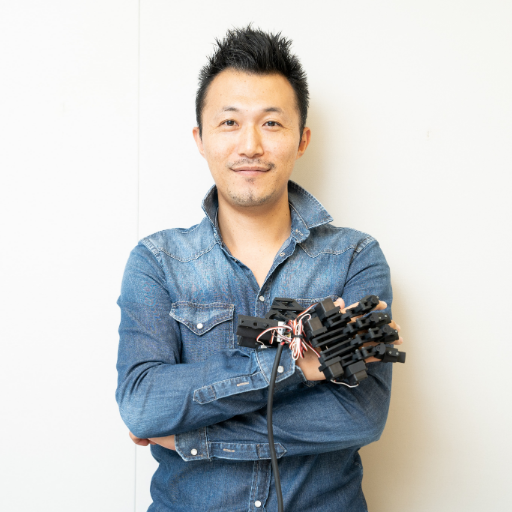

Enjoying the Southwest robotics symposium @ASU @ASURobotics @jd_knight @asurobot @nakulgopalan