Wit🐠

223 posts

We built Cerul to teach your AI agents to see. Nebius bought Tavily for $275M — 14 months old, text-only, 3M SDK downloads/month. Video search isn't solved. Same playbook, 10× harder, wide open.

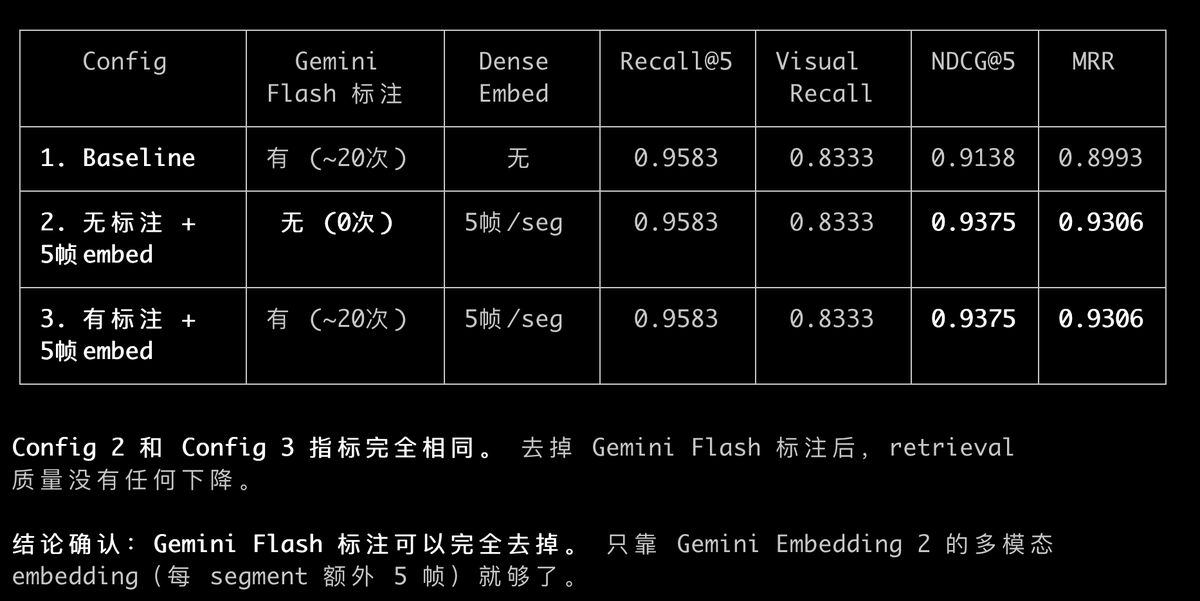

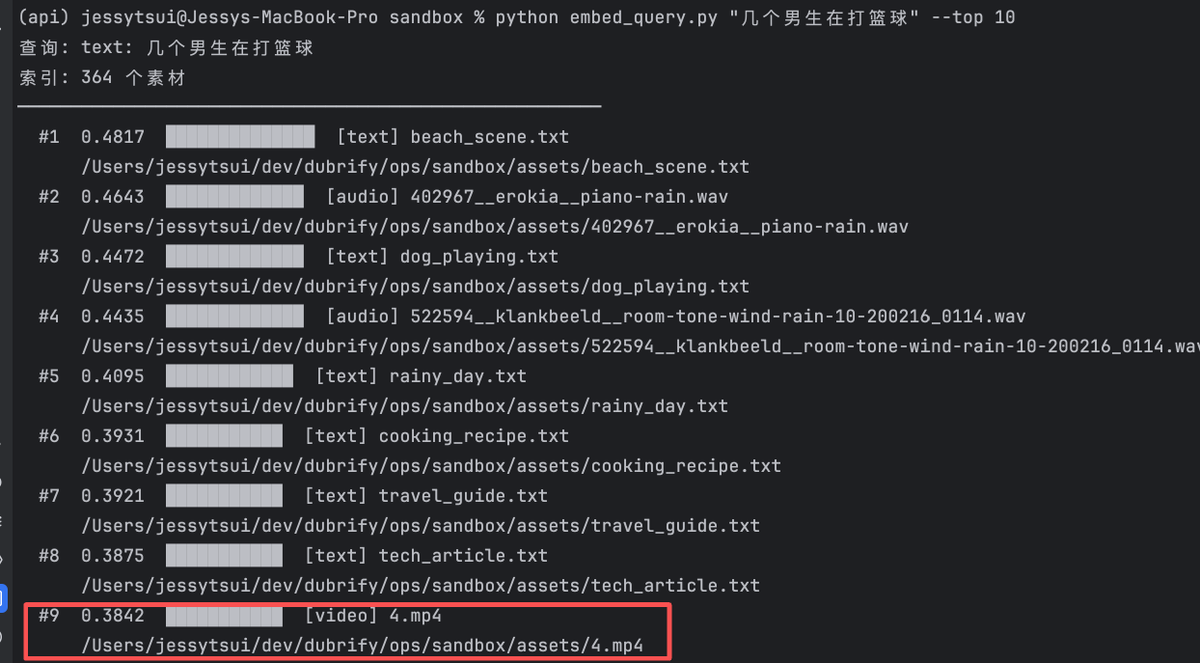

感觉 Google 是依靠 NotebookLM 积累的音频、PDF、视频数据,补齐了这三个模态的训练数据,不然很难解释为什么如此多的PDF的对齐数据是从哪来的 CLIP 时代还可以靠着互联网大量爬虫,找到 text—image pair对来做对比学习训练,但互联网上没有大量的 PDF—Audio—Video 的pair对 所以做 多模态embedding 的思路其实也变了,你不可能再依靠不授权的爬虫取得大量 pair 数据了,需要自己有真实的产品入口才可以持续积累数据 要把多模态embedding做好,实际上和是否是模型公司关系不大,就按照标准 transformer 架构,大力进行对比学习也未尝不可。所以需要的是手里有文档、Audio、Video相关产品场景的人 如果 Kimi、GLM、MiniMax 想追上 Google 在多模态 embedding 上的效果,最方便的似乎是收购现成的产品入口,比如 @lifesinger 的 YouMind 或者 @oran_ge 的ListenHub !

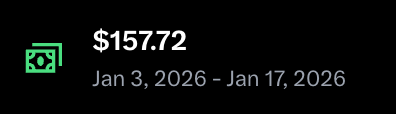

【广告】英推(X)长期运营小社群 过去 1 个月,我的英推账号 曝光(Impressions)> 1000 万,数据本账号可查。 我想组建一个低噪音、重执行的小社群:内测期 即日起—3 月 1 日,入群 99 元/人(服务/内容更新到 3 月 1 日为止)。 如果你想长期做英推,但对「怎么起步」「怎么稳定增长」还没形成方法论,可以考虑加入。 适合谁: 1. 至少在英推发过帖/有运营经验,想在英推系统增长的人 2. 想在 AI 生图 / AI 视频 方向长期耕耘的人 你会得到什么: 1. 每日分享:我每天在英推上发现的东西——看到啥、学到啥、踩到啥坑,就顺手分享(选题/表达/案例/数据) 2. 我测试/观察到的可能有效的发帖策略(可复用的套路、模板、注意事项) 和其他社群不一样: 1. 可以潜水:以我输出为主,你想看就看,也欢迎讨论 2. 低噪音:不搞打卡内卷,不做互赞互关式“互助”,只做可执行内容 不提供 / 不适合: 1. 商单对接 2.互推互赞、强制互动之类服务 3.想以中文长文/纯文字内容为主要增长路径的人(我主要分享 英文 + AI图片 + AI视频 的打法) 想加入:评论或私信我「社群」,我把入群方式发你。

x.com/win1688888888/… 没有AI前也有无数的垃圾代码垃圾内容 根本就rank不了 现在的AI vibe code只能说能生成比以前人工做的质量更高,且速度更快 我的网站每天都有收到好评邮件

🚀 隆重推出 AIPex:将您的浏览器变成AI浏览器。 无需迁移。无需新浏览器。就在您已经工作的地方,获得纯粹的AI功能。 留在原地。保持隐私。保持高效