Val Zudans MD

24.8K posts

Val Zudans MD

@ValZudans

Frugal philosopher-physician mitochondriac EnSurf ZudEye

🚫🇷🇺 Hungarian protesters chanted “Russians go home!” (Ruszkik haza) at PM Orbán during a campaign rally, hours after we revealed his foreign minister conspired behind allies' back and shared EU documents with Sergey Lavrov. The chant echoes the main slogan of the 1956 uprising.

We live in a volatile world, which sometimes feels hopeless, but I'd like to remind us of certain human qualities that bring us back to hope and allow us to imagine a more harmonious world, in which we can all thrive. This sense of hope comes from an unlikely source: Mathematics. Let me explain...

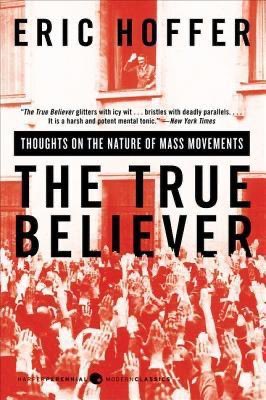

Milton Friedman (prix nobel d'économie) a dit un truc il y a 50 ans qui est encore plus vrai aujourd'hui. Et quasiment personne ne le comprend. 🧵 On lui pose la question : "Sans régulation sur les médicaments, des gens pourraient mourir en prenant des produits dangereux. Vous ne trouvez pas ça grave ?" Sa réponse est un des retournements logiques les plus brillants de l'histoire de l'économie. Oui, dit Friedman. Un médicament non régulé peut tuer des gens. C'est visible. C'est dans les journaux. C'est un scandale. Tout le monde le voit. Mais ce que personne ne voit, c'est les gens qui meurent parce qu'un médicament qui aurait pu les sauver a été bloqué pendant 10 ans par le processus de régulation. Ce mort là, personne ne le compte. Personne ne fait sa une. Personne ne connaît son nom. Parce qu'il est mort de l'absence de quelque chose qui n'a jamais existé. C'est l'asymétrie fondamentale de la régulation. Le régulateur a deux types d'erreurs possibles. Erreur 1 : approuver un médicament dangereux. Résultat : scandale public, procès, le régulateur perd son poste. Erreur 2 : bloquer un médicament qui aurait sauvé des vies. Résultat : rien. Personne ne sait. Personne ne proteste. Les morts silencieux n'ont pas de porte-parole. Du coup, le régulateur rationnel optimise pour éviter l'erreur 1. Toujours. Il rajoute des études. Des phases. Des comités. Des délais. Chaque couche de "sécurité" supplémentaire le protège, lui, au détriment des patients qui attendent. Friedman estimait que la FDA avait probablement tué plus de gens en retardant des bons médicaments qu'elle n'en avait sauvé en bloquant des mauvais. C'est impossible à prouver précisément. Mais la logique est imparable. Un exemple concret. Le bêta-bloquant Propranolol était disponible en Europe des années avant d'être approuvé aux États-Unis. Pendant ces années, des Américains mouraient de crises cardiaques qui auraient pu être évitées. Combien ? On ne le saura jamais. Parce qu'on ne compte pas les morts de l'inaction. C'est le même principe partout. Pas que dans la médecine. En France, les taxis autonomes sont bloqués par la régulation. Chaque année de retard, ce sont des accidents de la route qui auraient pu être évités. Mais personne ne compte ces morts là. On compte uniquement le premier accident d'un taxi autonome, qui fera la une de tous les journaux. L'IA dans la médecine est ralentie par des processus d'approbation qui prennent des années. Des diagnostics qui pourraient être faits en secondes par un algorithme attendent des validations pendant que des patients attendent des mois pour un rendez-vous. Le nucléaire a été bloqué pendant des décennies par la peur. Combien de gens sont morts de la pollution des centrales à charbon qui ont tourné à la place ? Personne ne les compte. Le pattern est toujours le même. On voit le risque de l'action. On ne voit jamais le risque de l'inaction. Et comme le risque de l'inaction est invisible, le régulateur choisit toujours l'inaction. Parce que l'inaction ne produit pas de scandale. Friedman résumait ça en une phrase : "Les gens qui ont été sauvés par la FDA sont visibles. Les gens qui sont morts à cause des retards de la FDA sont invisibles. Et dans une démocratie, le visible gagne toujours contre l'invisible." La prochaine fois que quelqu'un vous dit "il faut plus de régulation pour protéger les gens", posez une seule question : combien de gens meurent en attendant que la régulation les autorise à vivre ? La réponse est toujours plus grande que ce qu'on imagine. Mais personne ne la calcule. Parce que les morts de l'inaction n'ont pas de visage.

Weight loss drugs may increase human longevity but that's because they reduce the mortality of folks at the lower end of the lifespan distribution (i.e., unhealthy individuals), not because they delay the aging process. That's still valuable, but if this is the best intervention we have, it reflects poorly on current aging science. At best, weight loss drugs are targeting aging accelerants, not aging per se. To truly increase longevity, we need interventions that reduce mortality for everyone by targeting aging.

@BiankaB12 It was the USA which landed in Normandy, France during WWII, saving a large part of Europe. What has France done for the USA with its military?

🚨 SAM ALTMAN JUST REVEALED THE BLUEPRINT FOR ASI Sam Altman just went on record with Axios to drop the most accelerationist warning we've ever seen. OpenAI isn't just building towards AGI anymore they have officially updated their messaging to declare a "transition toward superintelligence." Altman is explicitly warning of imminent, world-shaking cyberattacks, social upheaval, and machines humanity can't control. The economic disruption will be so severe that OpenAI is literally begging Washington to wake up and implement a "New Deal" for the AI era. Here are the 6 radical ideas OpenAI just proposed in their official blueprint to keep society functioning: • A Public Wealth Fund: A national sovereign fund seeded by AI companies to distribute AI-generated wealth directly back to citizens. • Robot Taxes: Taxing automated labor and corporate AI earnings to offset the massive, imminent job disruption. • Higher Capital Gains Taxes: Hiking taxes on top earners to fund the transition and redistribute the concentration of AI wealth. • The Four-Day Workweek: Incentivizing a 4-day workweek with no loss of pay to share the massive efficiency gains directly with the workers. • Universal AI Access: Treating basic AI access (Universal Basic Compute) as a fundamental human right, just like electricity or literacy. • A Rapid Social Safety Net: Massively expanding unemployment benefits, Medicaid, and Social Security for the workers permanently displaced by AI. The CEO of the most powerful AI lab in the world is telling the government that the coming disruption will be on the scale of the Great Depression. I think we ought listen.