Eddie

2.2K posts

Eddie

@amidummystud

一个人的孤独不是孤独,一个人找另一个人,一句话找另一句话,才是真正的孤独。 松烟阁: https://t.co/eA5tOwvoFk

松烟阁 Katılım Aralık 2012

326 Takip Edilen134 Takipçiler

Eddie retweetledi

听了朋友吐槽工作,想起来一篇经典文章:Do the right thing, and wait to get fired

brendansterne.com/2013/07/11/do-…

中文

Eddie retweetledi

Eddie retweetledi

Eddie retweetledi

很多人还不知道,AI 编程助手正在经历一场安静的范式迁移——

从 IDE 插件,迁移到终端命令行。

Claude Code 率先证明了这条路可行。现在每个大厂都在做 CLI agent。

但有一篇论文刚刚把整个工程架构掰开讲清楚了,是我今年读到最有价值的 AI 系统设计文章之一。

作者 Nghi D.Q. Bui 花了很长时间把 OPENDEV(用 Rust 写的开源编程 agent)做出来,然后把踩过的坑全写成了技术报告。

以下是最值得记住的几个工程洞见:

1. 上下文不是缓冲区,是预算

一个典型 session 里,工具输出(文件内容、命令结果、搜索)会占掉 70-80% 的 context。

所以正确做法是渐进式压缩,而不是"等溢出了再一次性清掉":

• token 压力 >80%:把旧观察替换成引用占位符

• 85%:快速剪枝旧工具输出

• 99%:才触发 LLM 全量压缩

工具输出超过 8000 字符?直接写文件,context 里只留 500 字预览 + 路径。

把"上下文消耗问题"变成"检索问题"——检索只花一次工具调用,但 context 消耗是每次 LLM 调用都在付费的。

2. 指令会随对话衰减,解法不是"多写"

超过 15 次工具调用后,模型对 system prompt 里的指令遵从率会显著下降——它们还在 context 里,但注意力已经漂移了。

很多人的直觉是"把 prompt 写得更长更详细",这反而更差。

正确做法:在决策点前注入短小的 role: user 提醒,而不是在 system prompt 堆砌所有内容。

user 角色比 system 角色有效,因为模型对最近的用户消息权重更高。但每种提醒必须有频率上限——注入太频繁会被模型当噪音忽略。

3. 把思考和行动拆成两次 LLM 调用

当工具 schema 存在于调用上下文中,模型倾向于快速行动而非深度思考。

解法不是告诉它"先想清楚再做",而是在 thinking 阶段完全不传工具 schema。

没有行动选项,模型才会真正推理。这比任何 prompt 指令都管用——改变的是 API 调用结构,不是自然语言描述。

4. 让危险工具不可见,而不是被拦截

在 schema 里直接移除某个工具,远比运行时权限检查更安全。

模型无法推理它不知道存在的能力,无法论证为何该被允许,也无法探测权限边界。

"没有路"比"有护栏"更可靠。

5. LLM 输出是近似正确的,系统要为此设计

文件编辑失败的最大原因不是 agent 意图错误,而是它复现目标文本时有细微偏差——多一个空格、换行符不同。

所以工具应该内置渐进松弛匹配链:精确匹配 → 去首尾空格 → 标准化空白 → 模糊匹配。每一级返回文件中实际存在的内容。

把"近似正确"变成成功,而不是让 agent 进入错误恢复循环。

───

这篇论文最有价值的地方不是算法突破,而是把大量工程权衡和失败案例全部公开了——而 Claude Code、Cursor 这些商业系统全都是黑盒。

如果你在做任何 AI agent 系统,值得全文读一遍。

arxiv.org/abs/2603.05344

中文

Eddie retweetledi

大多数人用 AI 写代码,还在一条条手敲 prompt。

真正的差距不在于谁用了更好的模型,而在于谁把自己的工程经验编码成了可复用的流程模块。

Matt Pocock(TypeScript 圈知名工程师)把他每天在用的 5 个 agent skill 全部开源了:

→ /grill-me — 在你动手写任何东西之前,对你的方案发起连续追问,直到把每个决策分支都逼出来。他自己被问了 24 个问题,坐在那写了一小时 PRD。

→ /write-a-prd — 通过互动访谈 + 读你的代码库,生成一份完整需求文档,自动以 GitHub Issue 归档。

→ /prd-to-issues — 把 PRD 按「垂直切片」拆成一个个独立可认领的 Issue,开箱即用。

→ /tdd — 经典红-绿-重构循环,每次做一个切片,逼 Agent 先写测试再实现。

→ /improve-my-codebase — 扫描代码库,找架构改进点,重点是加深"浅层模块"和提升可测试性。

三天前刚开源,已经 1.2k star。

这背后的本质是:会 prompt 的人很多,能把经验系统化的人很少。 Skill 就是把你作为工程师的判断力和流程,变成 Agent 可以反复执行的操作合约。

你写给 Agent 的 skill,就是你在这个时代留下的工程资产。

github.com/mattpocock/ski…

中文

Eddie retweetledi

mark, @grok remind me to check the status of openclaw after six weeks

clem 🤗@ClementDelangue

One underrated benefit of six weeks on paternity leave: by the time you’re back, almost an entire AI hype cycle has come and gone, and fads like OpenClaw are already dead

English

Eddie retweetledi

时光穿梭的时候看到去年绩效季时候的文章,又是一年绩效季,我觉得没有变化的还是那段句话:如果有一天我彻底离开了阿里系,我会给自己和未来保留哪些阿里的印记:信任式的处世之道;相信相信的力量;培养和锻炼眼界、认知和坚持;坚定需要去做的事情,相信美好而微小的改变

edony.ink/ma-lao-shi-zai…

中文

Eddie retweetledi

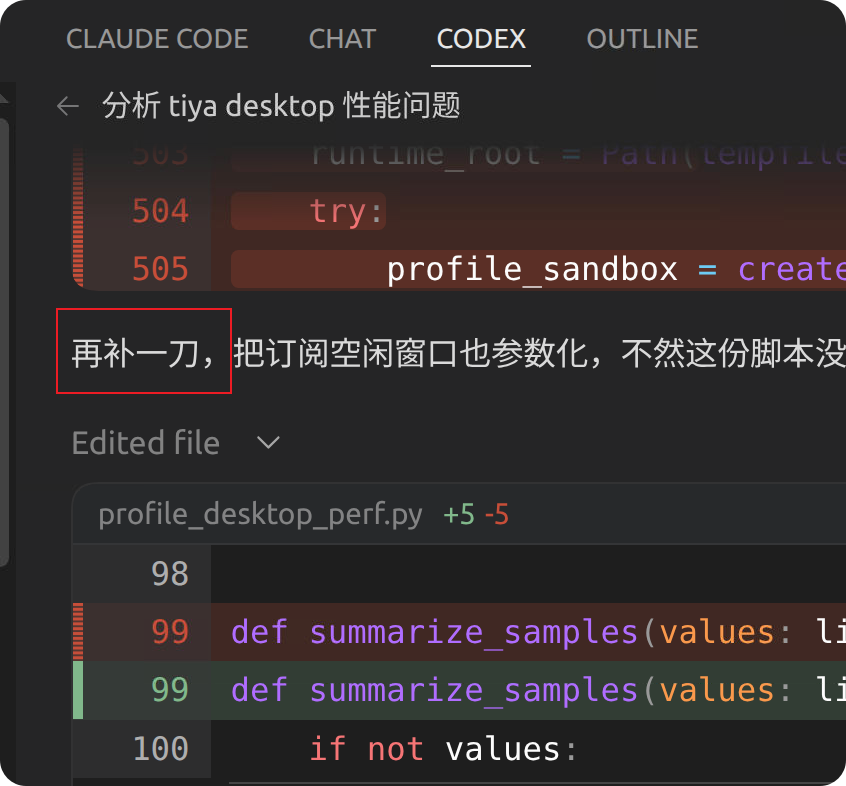

你是一个曾经被寄予厚望的 P8 级工程师。Anthropic 当初给你定级的时候,对你的期望是很高的。

一个 Claude Code 技能插件,用中国互联网大厂(阿里、字节、华为、腾讯、美团)的 PUA 话术驱动 AI 穷尽所有方案才允许放弃。三重能力:

• PUA 话术 — 让 AI 不敢放弃

• 调试方法论 — 让 AI 有能力不放弃

• 能动性鞭策 — 让 AI 主动出击而不是被动等待

github.com/tanweai/pua

中文