crazytime

45 posts

想奶一下 OpenCode Go,又快量又多,喜欢用DeepSeek V4 Pro。 但是怕又和Github Copilot 一样被奶死。

我一直有个疑问,本地运行大模型的必要性是什么?🤔 除了隐私和无需 token

这个也太屌了! 这个中国开发者在飞机上用 MacBook 本地跑 Llama 70B,整整 11 小时没有网络,处理了完整的客户项目。 他坐在跨大西洋航班的靠窗位置,设备是 MacBook Pro M4,64GB 内存。机上 WiFi 要价 25 美元,他拒绝了。 没有云端 API,没有连接 Anthropic 或 OpenAI 的服务器,完全没有互联网。 只有一台本地运行的 Llama 3.3 70B(bf16)和他自己写的编排脚本。 模型通过 llama.cpp 运行。生成速度 71 tokens/秒,上下文约 60,000 tokens,内存占用 48.6 GiB / 64 GiB,起飞时电池剩余 3 小时 21 分钟。 起飞前他给编排器写了这样的系统提示: "你是一个运行在单台 MacBook 上的离线编排器。没有网络。你唯一的资源是 /Users/dev/work 下的本地文件、localhost:8080 的 Llama 70B 推理服务,以及 3 小时 21 分钟的电池预算。处理 /Users/dev/work/queue.jsonl 中的任务队列(每行一个客户任务)。对每个任务:起草 → 运行本地评估 → 保存产物到 /Users/dev/work/done/。每 12 个任务保存一次上下文检查点,以便更换电池后恢复。仅在队列为空或电池低于 5% 时停止。" 所以这个系统完全清楚自己运行在什么资源上。 它知道自己未来 11 小时没有外部连接。它知道自己的内存和电池都是有限的。它知道在飞机降落之前不会有人类介入。 系统跑在一个循环里。从队列取任务,推理,保存产物,写检查点。一个接一个。 当电池低于 5% 时,编排器自动暂停,等待笔记本切换到备用充电宝,然后从最后一个检查点恢复。 这是系统在飞行中的日志: "saved context checkpoint 8 of 12 (pos_min = 488, pos_max = 50118, size = 62.813 MiB)" "restored context checkpoint (pos_min = 488, pos_max = 50118)" "prompt processing progress: n_tokens = 50 / 60818" "task 37016 done | tps = 71 s tokens text → /Users/dev/work/done/proposal_westside.md" 窗外是云层、蓝天,没有 WiFi。托盘上是一台 MacBook,一个打开的终端,两个屏幕,一个 localhost 推理服务。 这是过去一年里我见过的最漂亮的离线 AI 工作流: 11 小时飞行,WiFi 费用 0 美元,所有客户队列在降落前全部清空。 这个故事的核心不是技术多牛(llama.cpp 跑 70B 现在很常规),而是一个完整的离线自主工作流,编排器理解自己的资源约束,自动管理电池和检查点,没人干预干了 11 小时。 这种"self-aware computing"的感觉确实挺酷的! x.com/i/status/20499…

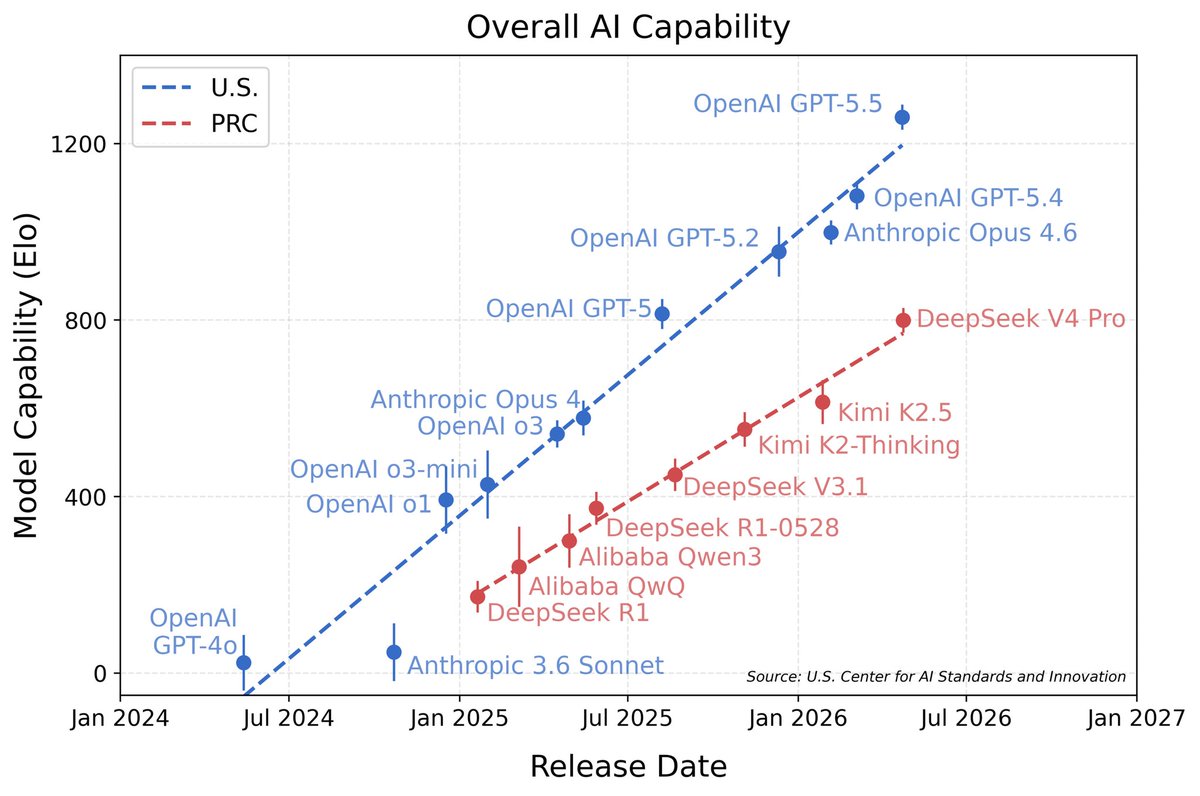

chinese models are ~8 months behind and are falling further behind

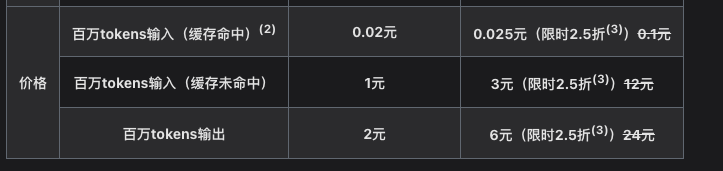

还是 DeepSeek 凶猛啊,你们不是嫌我贵? DeepSeek V4 Pro 2.5折活动启动!🤣 真铁血硬汉子!

DeepSeek V4详细的官方公告也发了: 模型参数 (a) Pro 版本:总参数 1.6T,激活参数 49B (b) Flash 版本:总参数 284B,激活参数 13B (c) 预训练数据量:均为 32T 模式区分(网页端与 APP) (a) 专家模式:代表 Pro 版本 (b) 快速模式:代表 Flash 版本 测评表现 在多项测评成绩上,该模型与 Opus 4.6 持平。其中,Agent 能力显著增强,世界知识也显著提高。 技术改进 全新的注意力机制已应用于新模型中,相比传统方法,大幅降低了对计算和显存的要求。