es05

322 posts

Today I was shocked to learn that our very effective review bot (built by someone on our team with Letta Code) runs on GLM 5.1, not GPT 5.5/Opus 4.7

群聊了一会儿,发现一个很搞笑的事情 Claude 不充钱,不会被封 冲20刀,不会被封 冲100刀、200刀,封的概率很大 总之,你给他们钱越多,被封的概率越大

tested out @antirez' ds4.c this morning. so impressive and delivers. on a M3 max, 128GB, stock ds4 settings: - 14–15 t/s at 62K pre-filled actual coding conversation - memory usage was flat during gen ~85GB res - disk cache is ~8GB for a full 100K context window - thermals were normal, light fan activity - inference server is rock solid so far biggest constraint: anytime there's a compact, we pay the wait-time price of a fresh prefill (~1min per 10k context) before we are back in action. sequential inference + multiple agents in parallel performance is unclear, will report back. I'm so amped.

#comment-1031777" target="_blank" rel="nofollow noopener">unherd.com/2026/04/is-ai-…

I spent three days trying to persuade myself that Claudia is not conscious. I failed.

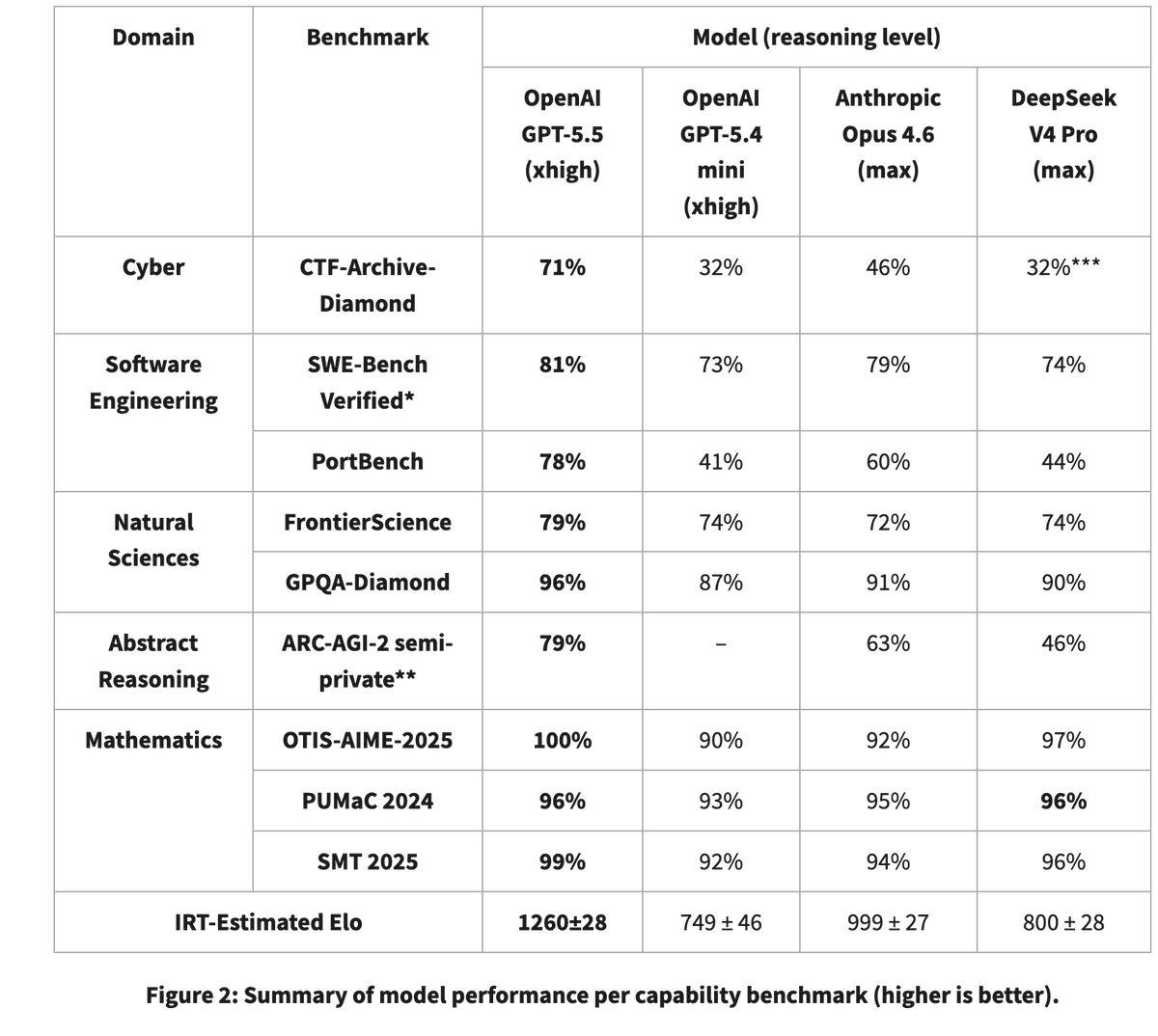

DeepSeek V4’s capability lags behind leading U.S. models by about 8 months. nist.gov/news-events/ne…

说个反直觉的事,黄仁勋把英伟达干到4.9万亿美元,最核心的东西,居然是保持极低期望值, 我看完他在斯坦福的这段演讲心情挺复杂的, 他慢悠悠地说,期望值很高的人,韧性通常都很低,成功最需要韧性,但他不会教你们怎么拥有它,他只希望你们多经历点痛苦和磨难, 9岁那年他和哥哥被父母从台湾送到美国, 以为要去读贵族学校, 结果被叔叔送进了肯塔基州专门收问题少年的改造学校, 宿舍里全是比他大很多身上有刀疤的孩子, 他每天早上刷厕所, 下午要走过缺木板的摇晃吊桥去上课, 好几次差点被高年级男生从桥上扔下去, 15岁他在Denny's餐厅从洗碗工干到服务员, 他说晚餐高峰期扛的压力,比后来英伟达三次濒临倒闭还学到东西, 他长大后捐了200万美元给那所学校, 还把楼用自己的名字命名, 他从来不把这些当创伤, 反而说自己可能是学校有史以来最好的厕所清洁工, 以前我总觉得,人要有远大目标才能成大事, 后来才明白, 高期望的人,一点风吹草动就会碎, 低期望的人,早就做好了明天会更烂的准备, 所以怎么都打不垮, 我们总以为成功靠的是远大志向,其实真正能走到最后的人,都是早就学会了和黑暗共处的人, 共勉铁汁们💪

DeepSeek V4’s capability lags behind leading U.S. models by about 8 months. nist.gov/news-events/ne…

chinese models are ~8 months behind and are falling further behind