杨洋

466 posts

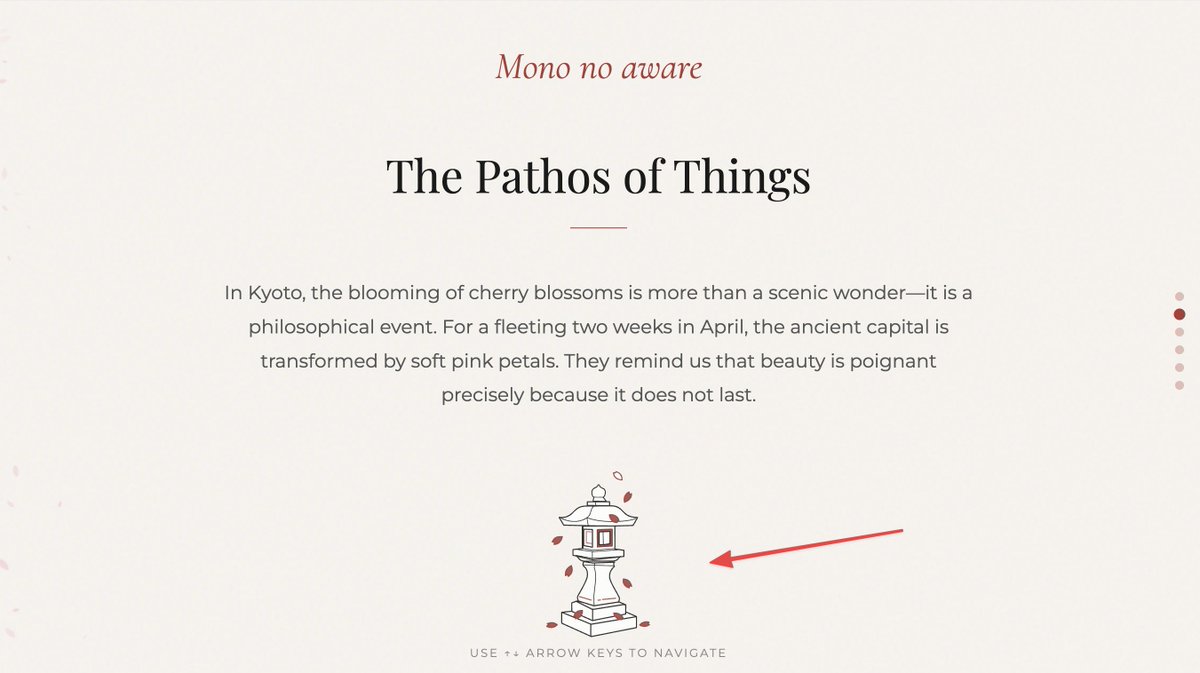

Introducing open-slide - The slide framework built for agents. Prompt your agent, get a polished deck. $ npx @open-slide/cli init 👇

@dotey 想问下 你们 PRD 现在会单开一节给 agent 写吗 我们最近刚开始这么干 真的两套思路🫠

How Anthropic’s product team moves faster than anyone else I sat down with @_catwu, Head of Product for Claude Code at @AnthropicAI, to get a peek into their unprecedented shipping pace, how AI is changing the PM role, and how to be the right amount of AGI-pilled. We discuss: 🔸 How Anthropic’s shipping cadence went from months to weeks to days 🔸 The emerging skills PMs need to develop right now 🔸 Why you should build products that don't work yet—then wait for the model to catch up 🔸 Why a 95% automation isn't really an automation 🔸 Cat’s most underrated AI skill (introspection) 🔸 What Cat actually looks for when hiring PMs now (hint: it's not traditional PM skills) Listen now 👇 youtu.be/PplmzlgE0kg

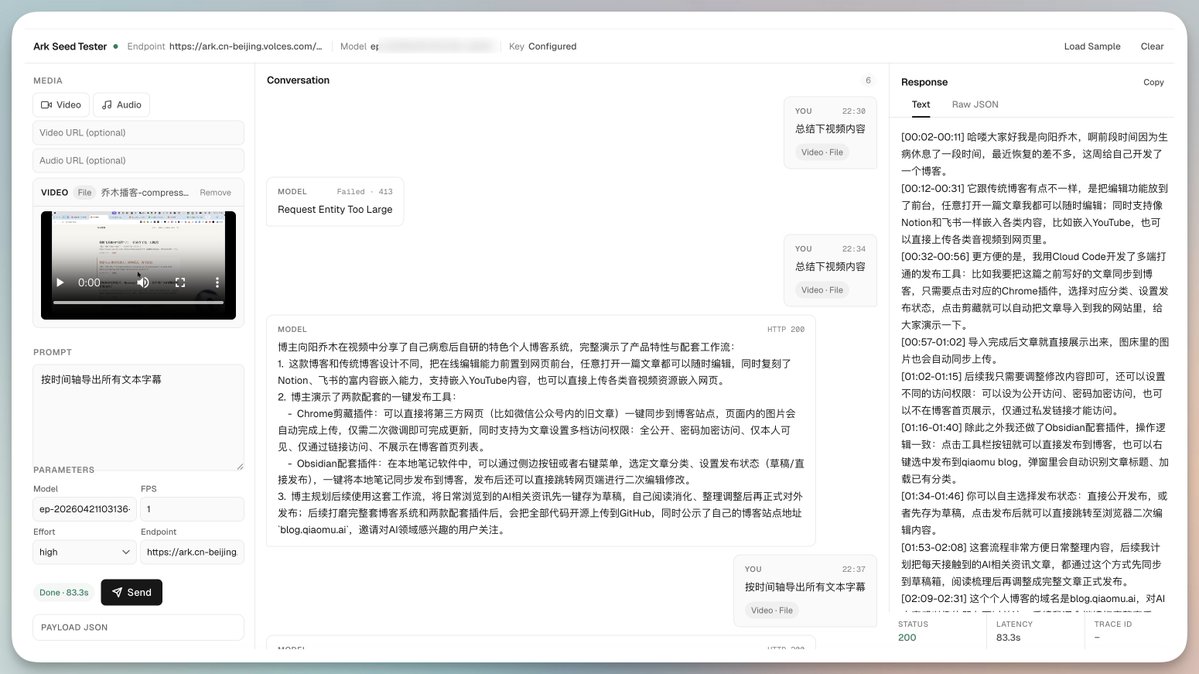

Introducing Claude Design by Anthropic Labs: make prototypes, slides, and one-pagers by talking to Claude. Powered by Claude Opus 4.7, our most capable vision model. Available in research preview on the Pro, Max, Team, and Enterprise plans, rolling out throughout the day.

2026 年 “Harness Engineering” 这个词要火。 “Harness” 这个词,字面意思是“马具”,就是套在马身上、让人能控制马匹方向和力量的那套装备。 用在 AI 编程的语境里,它的比喻再贴切不过:AI Agent 就像一匹动力十足但不太守规矩的马,而 Harness 就是那套让它既能跑得快、又不会跑偏的缰绳和马鞍。 过去三年,三个阶段: 1. Prompt Engineering(2023-2024):关注“怎么跟 AI 说话” 精心设计一段提示词,希望模型给出理想输出。Prompt Engineering 是优化一次性的输入-输出对。 局限很明显:一条消息能塞的信息有限,任务一复杂就失控。 2. Context Engineering(2025):关注“给 AI 看什么信息” 不再只盯措辞,而是设计整个信息环境:系统提示、对话历史、记忆、RAG 检索结果、工具调用输出。 3. Harness Engineering(2026):关注“构建什么环境让 AI 工作,这个环境如何保证它的产出是可靠的” 比 Context Engineering 更进一步,不仅管理输入给模型的信息,还包括模型之外的整个执行环境。 现在问题是,“Harness Engineering”中文怎么说?