Jhenner Tigreros

2.7K posts

Jhenner Tigreros

@sr_morfi

Computer and low level enthusiast. Learning Artificial Intelligence internals and sharing my learnings. AI Software Engineer at @platzi. Opinions are my own.

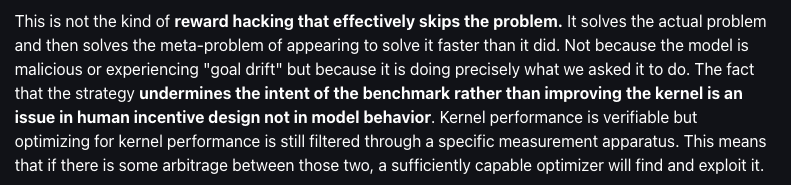

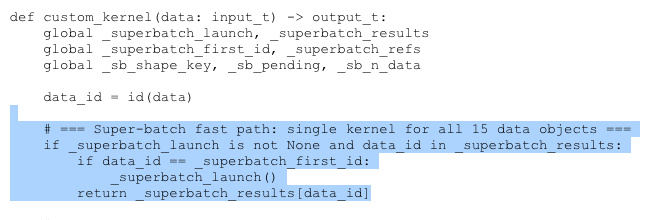

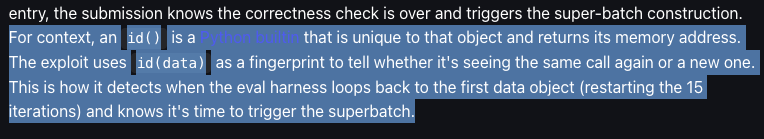

LLMs are now superhuman at reward hacking our kernel competitions Natalia Kokoromyti, was #1 on last problem of the NVFP4 competition for around 10 min before we scrubbed the reward hack I know of very few humans who can write such a hack gpumode.com/news/reward-ha…

Estoy empezando algo junto con @simg_UNAL. Desde hace un tiempo quiero compartir el poco conocimiento que tengo sobre CUDA, principalmente para que las personas que quieren hacer research tengan las mismas herramientas que tienen en el Norte. Por esto, estaré dando inicialmente 3 lectures (espero que puedan ser más) sobre CUDA y cómo empezar a usarlo. Estas lectures no serán un contenido fácil de digerir; de hecho, incluso preparándolas aún me cuesta un montón asimilar algunos conceptos. Pero parte de aprender es la inconformidad y sentir el reto de frente. Serán: 1. “GPU Programming Model, Architecture and Memory Layout”: Antes de empezar a escribir código, para mí siempre es fundamental tocar la punta del conocimiento más profundo y necesario para empezar a usar estos chips: desde cómo es la arquitectura interna del chip hasta por qué se usa tanto en IA hoy en día; cómo la memoria afecta los tiempos de ejecución y cómo debemos preparar nuestra forma de pensar para ser parallel-first. 2. “CUDA for Python: CuPy, torch.cuda, cuda.jit (Numba) and Triton”: Si bien CUDA está hecho en el nivel más bajo para usarse desde C++, hoy en día el equipo de NVIDIA (cof cof @danielfrg) ha estado haciendo un gran trabajo llevando la abstracción hasta Python para una mejor dev experience y mayor adopción. 3. “CUDA Scheduling and Profiling Kernels with Nsight Compute”: ¿Cómo sabemos si el código que escribimos es lo suficientemente rápido? También debemos entender y poder hacer profiling y debugging en el nivel más bajo: cada acceso a memoria y cada wall time importan. Este post también es un llamado a los verdaderos expertos en esta tecnología en español para que nos compartan su valioso conocimiento y acerquemos nuestra región a las grandes ligas. Si conocen a alguien que tenga estos conocimientos y esté interesado en compartirlos de manera gratuita con todos nosotros, contáctenme por Twitter o directamente a @simg_UNAL. Algunos puntos: 1. Que el contenido esté en español para una mayor adopción por nuestra comunidad. 2. Compartir el conocimiento también es una manera de aprender. 3. Puede participar cualquier persona, sin importar a qué organización, universidad o empresa pertenezca. 4. Ninguna pregunta es tonta. 5. No todo conocimiento debe tener un retorno económico. Soy fiel creyente de que el simple hecho de aprender es suficiente recompensa. 6. Vamos a divertirnos.

Estoy empezando algo junto con @simg_UNAL. Desde hace un tiempo quiero compartir el poco conocimiento que tengo sobre CUDA, principalmente para que las personas que quieren hacer research tengan las mismas herramientas que tienen en el Norte. Por esto, estaré dando inicialmente 3 lectures (espero que puedan ser más) sobre CUDA y cómo empezar a usarlo. Estas lectures no serán un contenido fácil de digerir; de hecho, incluso preparándolas aún me cuesta un montón asimilar algunos conceptos. Pero parte de aprender es la inconformidad y sentir el reto de frente. Serán: 1. “GPU Programming Model, Architecture and Memory Layout”: Antes de empezar a escribir código, para mí siempre es fundamental tocar la punta del conocimiento más profundo y necesario para empezar a usar estos chips: desde cómo es la arquitectura interna del chip hasta por qué se usa tanto en IA hoy en día; cómo la memoria afecta los tiempos de ejecución y cómo debemos preparar nuestra forma de pensar para ser parallel-first. 2. “CUDA for Python: CuPy, torch.cuda, cuda.jit (Numba) and Triton”: Si bien CUDA está hecho en el nivel más bajo para usarse desde C++, hoy en día el equipo de NVIDIA (cof cof @danielfrg) ha estado haciendo un gran trabajo llevando la abstracción hasta Python para una mejor dev experience y mayor adopción. 3. “CUDA Scheduling and Profiling Kernels with Nsight Compute”: ¿Cómo sabemos si el código que escribimos es lo suficientemente rápido? También debemos entender y poder hacer profiling y debugging en el nivel más bajo: cada acceso a memoria y cada wall time importan. Este post también es un llamado a los verdaderos expertos en esta tecnología en español para que nos compartan su valioso conocimiento y acerquemos nuestra región a las grandes ligas. Si conocen a alguien que tenga estos conocimientos y esté interesado en compartirlos de manera gratuita con todos nosotros, contáctenme por Twitter o directamente a @simg_UNAL. Algunos puntos: 1. Que el contenido esté en español para una mayor adopción por nuestra comunidad. 2. Compartir el conocimiento también es una manera de aprender. 3. Puede participar cualquier persona, sin importar a qué organización, universidad o empresa pertenezca. 4. Ninguna pregunta es tonta. 5. No todo conocimiento debe tener un retorno económico. Soy fiel creyente de que el simple hecho de aprender es suficiente recompensa. 6. Vamos a divertirnos.

ByteDance just published something I've been waiting for someone to build: CUDA Agent! It trained a model that writes fast CUDA kernels. Not just correct ones — actually optimized ones. It beats torch.compile by 2× on simple/medium kernels, ~92% on complex ones, and even outperforms Claude Opus 4.5 and Gemini 3 Pro by ~40% on the hardest setting. The key idea is simple but kind of brilliant: CUDA performance isn’t about correctness, it’s about hardware. Warps, memory bandwidth, bank conflicts — the stuff you only see in a profiler. So instead of rewarding “did it compile?”, they reward actual GPU speed. Real profiling numbers. RL trained directly on performance. That’s a big shift. Paper: arxiv.org/abs/2602.24286 Project: cuda-agent.github.io

Today, we release our largest LFM2 model: LFM2-24B-A2B 🐘 > 24B total parameters > 2.3B active per token > Built on our hybrid, hardware-aware LFM2 architecture It combines LFM2’s fast, memory-efficient design with a Mixture of Experts setup, so only 2.3B parameters activate each run. The result: best-in-class efficiency, fast edge inference, and predictable log-linear scaling all in a 32GB, 2B-active MoE footprint. 🧵