uv7k

728 posts

deepseek V4 如果有Opus 4.6的水平

大家应该梭哈买入 大内存的 Macmini

呆大人@darren_ter

@lidangzzz 即使放出来也顶多会是 Opus 4.6 等级,很难超越 Mythos 其实对普通人来说,能把 Opus 4.6 等级的模型 API 价格打下来10倍,远比一直追 SOTA 更有意义 至于 V4 为什么还没发布,我的猜测是还在优化推理成本 💰

中文

@lidangzzz 你首先要弄清楚,华为版本的deepseek到底是为什么开发的。在我看来,他们开发这个的目的就是从0到1做一个国产模型,并且达到最大的宣传声量。其他的需求完全可以后续迭代,甚至做第三方开放,也可以摸着老鹰过河(claude code开源了不是)。所以你要从最大宣传声量的角度考虑这个问题。

中文

deepseek最关键问题是,依然拿网页chatbot当一个简单的agent+web fetcher,

其他家网页版一年前就不是chatbot了,全都加上了小sandbox,里面能跑点代码,跑点regression,调用点其他小工具了,

deepseek一边浪费太多人力拧华为ascend训练模型,一边不愿意雇个懂agent的人把网页版chatbot重写一下。

行业内以为在憋大招,结果普通老百姓已经失去兴趣,不愿意用网页版deepseek chatbot了。

OpenAI的成功告诉大家,给普通老百姓提供一个免费网页版chatbot,把这个chatbot做得尽量舒服一点,让老百姓测试一下模型能力,尽可能展现一点好的效果,让普通老百姓对你网页版的chatbot产生一点粘性,这是尤为珍贵的公关宣传能力。

1000个人每天低强度用你的网页chatbot,就会有10个人掏钱买你的API,帮你把前面1000个人的inference成本cover掉。

这个事情并不难,可是deepseek在这个战略上依然佛系。

高级分析师@techeconomyana

做大模型的发不出新模型来,这本身就是最大的问题。 Deepseek网页版频繁内测,让我想到了当初的谷歌Gemini Kingfall。毕竟不对外正式发布,做不了系统化评测,粉丝可以吹上天,反正也验证不了。 网页版新模型要是真好用,用户会持续下跌?

中文

我个人的观点:

梁文锋可能是一个情怀和理想主义压倒商业决策和商业风险、纯粹且任性的人,

能够力排众议和风险,让deepseek掉转车头,拿华为ascend 910c重新搭infra,重新训练,冒着跟不上模型迭代、被甩开、agent等等布局全面缺失的风险,

也要帮助国产半导体和华为把一线LLM training跑通。

所以我前几天讲过这件事,

如果deepseek v4训练成功了,

deepseek不仅帮助华为ascend 910c跑通training,救了华为,也救了寒武纪,更救了中芯国际、整个neo cloud,同时让国产小龙小虎、阿里、字节、小米、快手也对华为ascend 910c重燃希望,继续下订单做training,

国务院到时候顺水推舟,继续出台政策半强制半鼓励要求国产GPGPU替换,华为挣钱,寒武纪也要认真做training,其他家也跟进,

梁文锋就是下一个钱学森,新质生产力的三四个产业,被梁文锋一个人盘活了;

但是如果deepseek v4效果差了一大截,跟deepseek v3.2系列齐平,

那就不好意思了,梁文峰和幻方就要自己承担财务损失。

呆大人@darren_ter

好奇 Deepseek 帮忙适配的奖励是什么?免费华为芯片?

中文

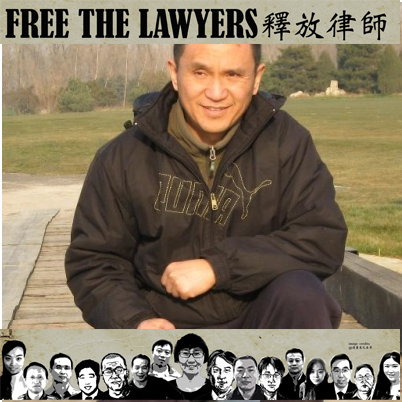

我对周恩来持着一份尊敬。他是众多共产党领袖人物中为数不多的几个正面形象。那时候称他为“周总理”。更有人内心充满着对他的亲近感,连那个生分的“周”字也不要了。直呼“总理”。

不幸的是,到美国之后,周总理这尊在我心目中的正人君子形像也破碎了。这次破碎得让人心痛。就像你精心收藏的一枚金币, 忽然发现它只是一片镀金铅块。一时间损失了价值的懊恼,上当受骗的气愤,有眼无珠的自责——复杂情感会一起在心里搅动。

一个来自上海的留学生小张突然问我:“你对周恩来怎么评价?”我简单陈述了自己的看法。

不料小张冷冷地说:“我过去和你一样,但是一件事就颠覆了周恩来在我心里的形象。”

我感到诧异,愿闻其详。

小张告诉我,他在哈佛大学图书馆读过一份资料。1943年抗日战争艰难时期,共产党著名特工潘汉年被毛泽东派到上海和汪精卫秘密接触并与日本占领军谈判,达成了秘密停火协议,内容是新四军停止对津浦线铁路桥梁的破坏,让日军运输线畅通,而日军停止对新四军的“清乡”、“围剿”,给新四军活动空间——日寇投降后,潘汉年与日、汪秘密接触的事情由在押的前汪精卫政权官员揭发。潘汉年却又把这段秘史曝露给不该知情的陈毅,毛泽东闻讯大怒,当天下令秘密逮捕潘汉年,并给法院“不判死刑”的指示。潘汉年被监禁7年后以汉奸罪接受审判,判刑15年。实际上潘汉年在秦城监狱被囚20年,然后改名换姓转移到湖南第三劳改农场继续监禁2年至死,妻子董慧也受牵连陪监终生。

潘汉年案到1982年才得以平反,此时潘氏夫妇早已双双离世多年了。支持潘汉年无罪的证据在审判时就已经确切掌握。最高法院院长谢觉哉说:“谁能救得了岳飞?”意指既然宋高宗要治岳飞以死罪,大理寺也只好以“莫须有”定案。在高等法院内部,谢高哉则明确对两位审判官说:“潘汉年案是中央交办的案子,我们只是办理法律手续。”

周恩来在二次国共合作时期主要活动在重庆,远离核心领导。对于潘汉年怀揣毛泽东的锦囊妙计与日寇勾结的阴谋毫不知情。只是对属下重要官员上海副市长突然被捕感到蹊跷,就派人调查。中联部部长罗青长还找到了当时潘汉年与中央来往电报收发记录,证明潘汉年是奉命行事;薄一波认为总理应该出面纠正这起冤案。可是周恩来却指示薄一波、罗青长等闭口,从此再也不要向任何人谈起潘汉年这个名字。后来周恩来签字批准了高等法院对潘汉年的判决。

“为了掩盖毛泽东勾结日寇的丑闻,潘汉年做了替罪羊,不许公开申辩。周恩来明知冤枉,却装聋作哑,不敢秉公向毛泽东进言。一个在大是大非面前不敢伸张正义的总理,有什么可尊敬的?”小张愤愤不平地说。

我说:“我不清楚这段历史,真是这样,那共产党内部也太黑暗了。如果联日反蒋是一件功勋,那毛泽东应居首功,潘汉年功在其后;如果是一件罪恶,毛泽东就是首恶,潘汉年就是胁从。现在看来,这件拯救共产党的功劳,却是危害民族的罪恶。毛泽东没有勇气公布于众,所以给潘汉年安一个罪名,让他老死狱中,达到封口目的。法院、检察院还奉命配合制造冤案;政府总理明哲保身,这个国家的公平正义在哪里?就凭这些,也会颠覆了周恩来在我心中的形象。”

我后来发现,周恩来在毛泽东面前放弃原则、卑躬屈节、甚至为虎作伥是一个常态。潘汉年案绝不是一个孤立的例子。

---说说从志士变成懦夫的周恩来

作者: 歪脖子树

中文

有人说,deepseek坚持用国产芯片训练LLM,长期来看,对国产半导体、GPGPU、国产AI infra、国产neocloud整个产业链都是长远巨大收益。

而我的看法是,

如果deepseek这次浪费一年时间折腾ascend 910c训练模型失败了,华为自己也失败了,

那么LLM几小虎、字节、阿里、小米就更不会用华为ascend系列了。

以前他们的中层高层还半信半疑,不知道华为ascend 910c到底能不能训练LLM,

现在好了,deepseek深陷ascend 910c搭建training infra的泥潭,华为自己也失败了,直接帮其他五六家试错了,

其他家估计要乐出声来了,原来你们真自己掏钱买完给全行业做实验——现在实验结果出来了,幸亏我们没买。

中文