Deeper

1.5K posts

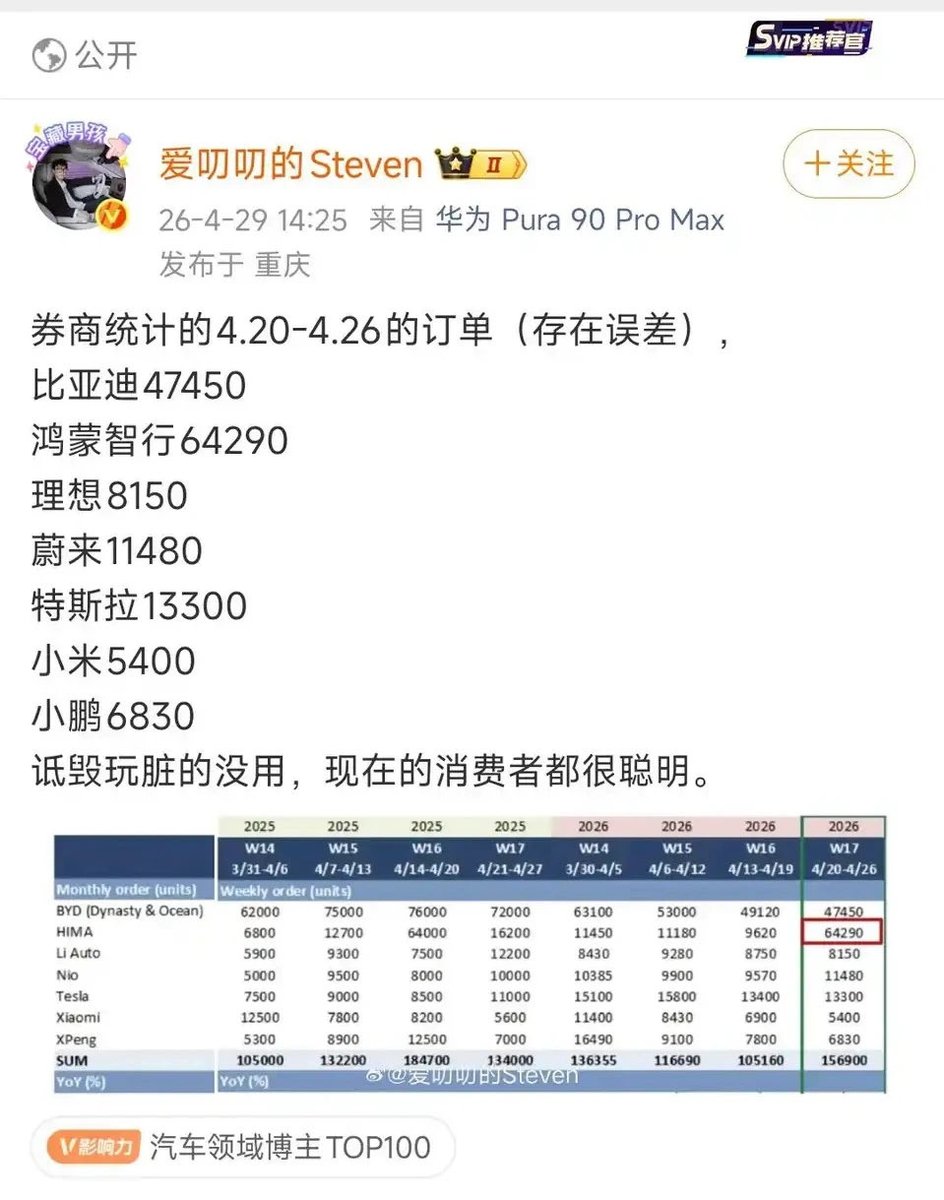

这个研究最大的方法论错误是忽略开源的巨大成本优势。在Deepseek V4 Pro差距SOTA模型并不多,但价格几十倍下降的情况下,你觉得用户会担心这所谓8个月的赛马差距吗?用户不是每个任务都是黑进华尔街和破解p=Np难题。用户需要能打、便宜、稳定、能控制的模型。

今天DeepSeek-V4 全新系列模型的预览版本正式上线并同步开源。看看这个版本强在哪里? 结论先行,这次更新这次几个关键维度同时跃迁,尤其是长上下文 + Agent 能力 + 成本结构三件事一起打通。 (一)超长上下文——1M上下文 通过新注意力机制 + DSA稀疏注意力来压缩token维度计算量,使得长上下文成本显著下降、显存需求降低,可以实际部署和商业化。 相信和我一样常用AI的朋友都饱受“聊着聊着忘了”或者“越聊越傻”。这些都与上下文限制有很大关系。大部分主流模型多轮对话里,表现是持续下滑的。 1M上下文如果真的能做到,那可以带来什么改变呢? 🌟能明显改善的: 1️⃣不会那么快物理截断前文,长项目/长文档的一致性会好很多; 2️⃣可以把更多约束、代码库、文档一次性塞进去,减少你人工分批说明的成本。 ❌但暂时解决不了的: 1️⃣对“中间关键段落”天然不敏感的问题。 2️⃣多轮对话的“过早成见 + 答案膨胀 + 不稳定性上升”问题 (二)Agent能力明显对标Claude体系 DeepSeek这次很明显在打“Agent-first”路线: Agentic Coding 达到开源第一梯队 实际反馈: 体验 > Claude Sonnet 4.5,接近 Opus 4.6(非思考模式)但仍落后 Opus思考模式 专门优化适配: Claude Code OpenCode / CodeBuddy 等 (三)推理能力进入跳跃,从“顶级开源→逼近闭源” 在开源模型中,DeepSeek-V4 在这里属于:已经站在开源金字塔尖,不是“中等开源”。 和闭源旗舰(GPT-5.x / Claude 4.x / Gemini 3.1 Pro 等)对比,DeepSeek-V4也在多维度逼近: 简单概括就是“分数差距压缩到个位数百分比”,有些问题笨一点但是API 成本大约是对方的 1/10–1/50。 还有一些其他更新,诸如: API和生态兼容(降低迁移成本); 思考模式(Reasoning Control)可调,来动态控制推理成本

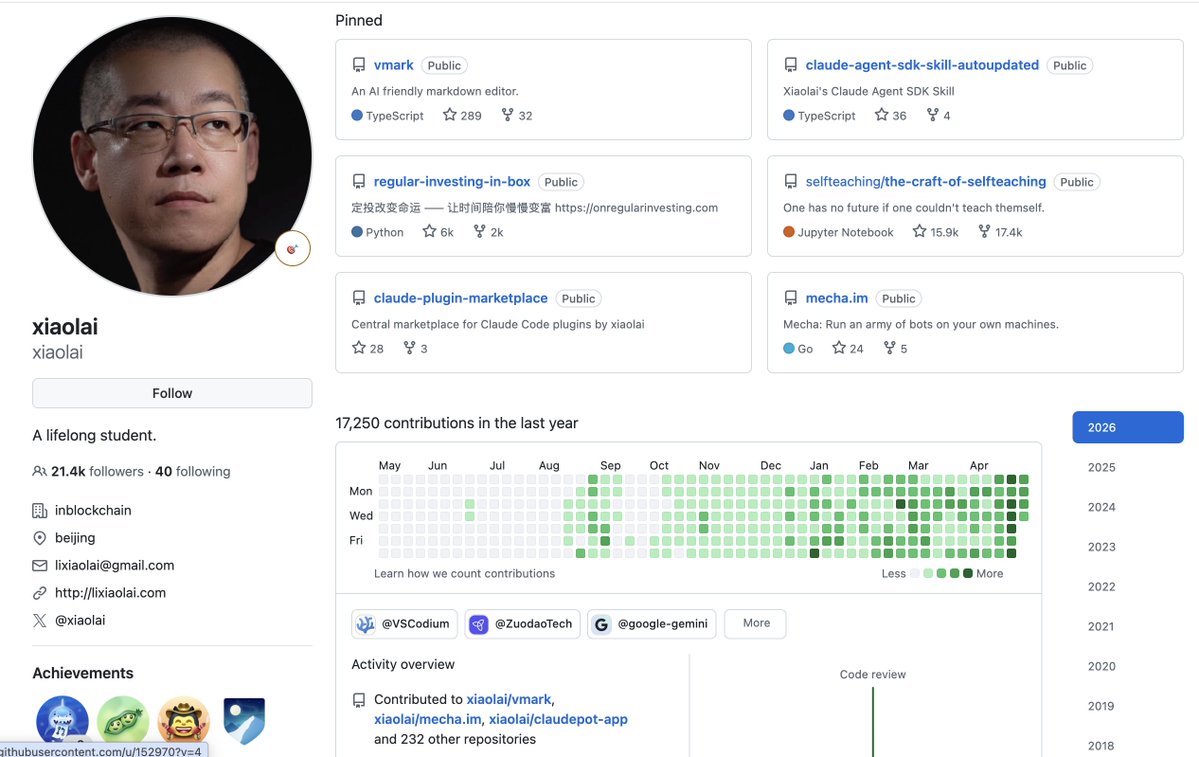

李笑来给我的 dbskill 提了两个 PR😂

Scam Altman and Greg Stockman stole a charity. Full stop. Greg got tens of billions of stock for himself and Scam got dozens of OpenAI side deals with a piece of the action for himself, Y Combinator style. After this lawsuit, Scam will also be awarded tens of billions in stock directly. The fundamental question is simply this: Do you want to set legal precedent in the United States that it is ok to loot a charity? If so, you undermine all charitable giving in the United States forever. I could have started OpenAI as a for-profit corporation. Instead, I started it, funded it, recruited critical talent and taught them everything I know about how to make a startup successful FOR THE PUBLIC GOOD. Then they stole the charity.